La carrera por la inteligencia artificial ya no se juega solo en el entrenamiento de grandes modelos. La inferencia —la fase en la que esos modelos responden, razonan, ejecutan tareas y alimentan agentes de IA— se ha convertido en el nuevo frente estratégico para fabricantes de chips, fundiciones y proveedores de memoria. En ese tablero, Samsung intenta aprovechar una oportunidad poco habitual: volver a ganar peso en la cadena de suministro de Nvidia.

El detonante es la tecnología LPU de Groq, especializada en inferencia de baja latencia. Aunque algunos análisis del sector hablan de una adquisición encubierta o estratégica, el acuerdo anunciado oficialmente por Groq se presentó como una licencia no exclusiva de su tecnología de inferencia para Nvidia, acompañada por la incorporación de Jonathan Ross, fundador de Groq, Sunny Madra y otros miembros del equipo a Nvidia. Groq, según su propio comunicado, continúa operando como empresa independiente con Simon Edwards como consejero delegado.

Samsung gana visibilidad con Groq 3 y la IA de inferencia

El interés de Samsung no está solo en fabricar un chip concreto. La compañía surcoreana quiere demostrar que puede volver a ser relevante para Nvidia más allá de la memoria HBM. En GTC 2026, Samsung destacó su papel como socio de Nvidia en memoria, fundición y empaquetado avanzado, y señaló que Jensen Huang mencionó a Samsung como socio clave en la fabricación de la nueva LPU de Groq.

El movimiento es importante porque Nvidia ha dependido durante años de TSMC para la fabricación de sus GPU más avanzadas. Que una pieza vinculada a la futura plataforma de inferencia de Nvidia pase por Samsung Foundry no cambia de golpe el equilibrio del sector, pero sí abre una brecha en una relación históricamente dominada por la fundición taiwanesa.

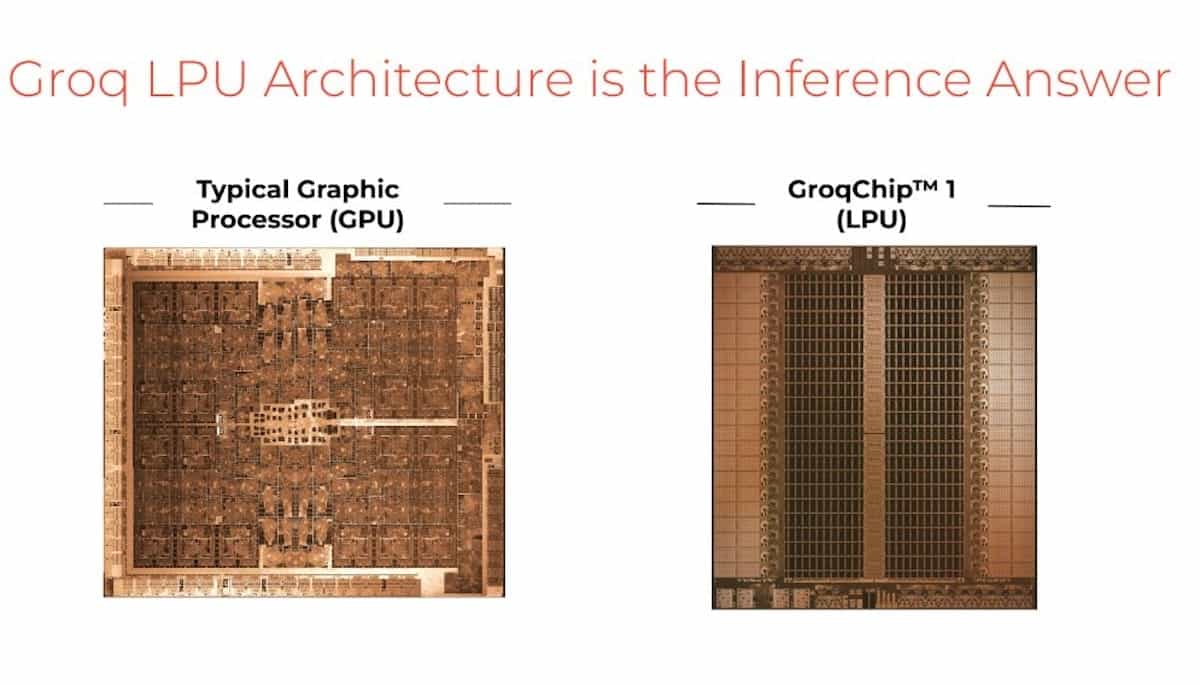

Según informaciones sectoriales, Groq 3 será fabricado por Samsung Foundry con un proceso de 4 nm. A diferencia de muchas GPU de IA, este chip está orientado a cargas de inferencia y se apoya en una arquitectura basada en SRAM, no en grandes pilas de memoria HBM. Esa diferencia técnica explica parte del interés de Nvidia: las GPU siguen siendo esenciales para entrenamiento y muchas cargas generales, pero los modelos de IA generativa y los agentes necesitan cada vez más aceleradores capaces de responder con baja latencia y alto rendimiento en la fase de ejecución.

La paradoja es que Samsung intenta reforzar su posición en Nvidia apoyándose tanto en su papel en HBM como en una LPU que, precisamente, no depende de HBM de la misma forma que una GPU de entrenamiento. Su argumento industrial es más amplio: ofrecer memoria avanzada, fabricación lógica y empaquetado como una solución integrada para la infraestructura de IA.

La baza de Samsung: HBM, fundición y empaquetado

Samsung sabe que la memoria de alto ancho de banda se ha convertido en una pieza crítica para la IA. En su presencia en GTC 2026, la compañía mostró HBM4E y habló de su futura arquitectura HBM5. También destacó tecnologías de empaquetado como Hybrid Copper Bonding, orientadas a mejorar la gestión térmica en entornos de alto rendimiento.

Esa combinación es clave. Los grandes sistemas de IA ya no dependen únicamente de diseñar el mejor chip, sino de integrar GPU, aceleradores especializados, memoria, interconexión, almacenamiento, red y refrigeración en plataformas cada vez más densas. En ese contexto, Samsung aspira a vender una propuesta más completa: no solo obleas, no solo memoria, sino una cadena tecnológica más integrada.

Para Nvidia, contar con un segundo socio de fabricación en determinadas líneas también tendría sentido estratégico. TSMC sigue siendo el proveedor dominante para los chips más avanzados de la compañía, pero la demanda de IA ha tensado la capacidad de producción, el empaquetado avanzado y la disponibilidad de memoria. Diversificar proveedores puede ayudar a negociar mejor, reducir riesgos y acelerar la disponibilidad de productos concretos.

Sin embargo, Samsung aún debe demostrar consistencia. Ganar una orden vinculada a Groq 3 no equivale a desplazar a TSMC en las GPU de mayor volumen y valor. La confianza en procesos avanzados, rendimiento por oblea, eficiencia energética, empaquetado y capacidad de entrega sigue siendo decisiva. Y en ese terreno TSMC mantiene una posición muy fuerte.

TSMC no se queda quieta

El titular de la pugna es sencillo: Samsung quiere convertir la LPU de Groq en una puerta de entrada a más negocio con Nvidia, mientras TSMC intenta proteger su papel central en la cadena de suministro del gigante estadounidense. DigiTimes ha apuntado que TSMC estaría presionando para disputar futuras generaciones de LPU, lo que alimenta la idea de que la ventaja inicial de Samsung podría no estar garantizada a largo plazo.

El interés de TSMC tiene lógica. Si la inferencia y los agentes de IA crecen como esperan los grandes proveedores cloud, las LPU y otros aceleradores especializados podrían convertirse en una nueva categoría relevante dentro del centro de datos. No sustituirían a las GPU, pero sí complementarían su trabajo en tareas donde la latencia, el coste por token y la eficiencia energética sean críticos.

Para Nvidia, la integración de la tecnología de Groq tiene una lectura defensiva y ofensiva. Defensiva, porque evita que un competidor especializado en inferencia gane demasiado terreno en un mercado que empieza a diversificarse. Ofensiva, porque permite a Nvidia ampliar su plataforma más allá de la GPU tradicional y adaptar su oferta a un escenario donde los clientes no solo entrenan modelos, sino que ejecutan millones de consultas, agentes y flujos automatizados en tiempo real.

El resultado puede ser una arquitectura más heterogénea. En lugar de una infraestructura centrada casi exclusivamente en GPU, los centros de datos de IA podrían combinar GPU, CPU, DPU, aceleradores de inferencia, memoria HBM, SRAM integrada y redes de muy baja latencia. La ventaja competitiva ya no estará solo en el chip más potente, sino en la plataforma que mejor combine todos esos elementos.

Una batalla industrial que va más allá de Nvidia

La disputa entre Samsung y TSMC por las LPU de Nvidia refleja una tendencia más amplia. La IA está reordenando la industria de semiconductores en torno a tres cuellos de botella: capacidad de fabricación avanzada, memoria de alto rendimiento y empaquetado. Quien controle esas piezas tendrá una posición privilegiada en la próxima década de infraestructura digital.

Samsung necesita recuperar credibilidad en fundición avanzada y aprovechar su fortaleza histórica en memoria. TSMC quiere evitar que sus clientes estratégicos diversifiquen demasiado pedidos hacia competidores. Nvidia, mientras tanto, juega con una posición de enorme poder: puede repartir cargas entre proveedores, integrar tecnologías externas y usar su volumen como palanca de negociación.

Conviene, aun así, evitar conclusiones precipitadas. La información disponible apunta a una colaboración relevante entre Nvidia, Groq y Samsung, pero no confirma que Samsung vaya a arrebatar a TSMC una parte estructural del negocio principal de Nvidia. Por ahora, lo prudente es hablar de una oportunidad abierta, no de un cambio definitivo de liderazgo.

Lo que sí parece claro es que la inferencia se ha convertido en el nuevo campo de batalla. Si durante los últimos años la conversación giró alrededor del entrenamiento de modelos cada vez más grandes, el negocio empieza a moverse hacia el despliegue masivo de IA en aplicaciones reales. Ahí importan la velocidad de respuesta, el coste operativo, la eficiencia energética y la capacidad de escalar millones de peticiones.

Samsung ha visto una oportunidad para regresar al centro de la conversación. TSMC no tiene intención de ceder terreno. Y Nvidia, como gran árbitro de esta nueva fase de la IA, puede ser la principal beneficiada de una competencia que abarate, diversifique y acelere su propia hoja de ruta.

Preguntas frecuentes

¿Qué es una LPU y por qué interesa a Nvidia?

Una LPU, o Language Processing Unit, es un acelerador especializado en tareas de inferencia para modelos de lenguaje. Su interés está en ejecutar respuestas y cargas secuenciales con baja latencia, un punto cada vez más importante para chatbots, asistentes y agentes de IA.

¿Nvidia ha comprado Groq?

Oficialmente, Groq anunció un acuerdo de licencia no exclusiva de su tecnología de inferencia con Nvidia. También comunicó que su fundador, Jonathan Ross, su presidente, Sunny Madra, y otros miembros del equipo se incorporarían a Nvidia. Groq mantiene su actividad como empresa independiente.

¿Por qué Samsung es importante en los chips de IA de Nvidia?

Samsung quiere reforzar su papel como proveedor de memoria HBM, fundición y empaquetado avanzado. Su participación en la fabricación de la LPU de Groq para Nvidia puede ayudarle a ganar visibilidad como alternativa o complemento a TSMC en determinadas áreas de la cadena de suministro.

¿Puede Samsung sustituir a TSMC como principal fabricante de Nvidia?

No hay datos que apunten a un reemplazo general de TSMC. La oportunidad de Samsung parece centrarse, por ahora, en chips concretos y en su capacidad de ofrecer memoria, fundición y empaquetado. TSMC sigue siendo un socio clave para los productos más avanzados de Nvidia.