Samsung y TSMC se reparten los chips de inferencia de Nvidia

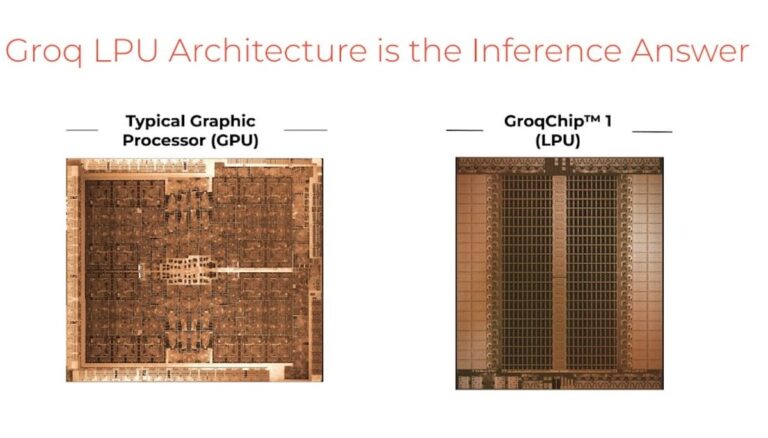

La carrera por la inteligencia artificial ya no se decide solo en el entrenamiento de modelos grandes. La inferencia, esa fase en la que los modelos responden, razonan y ejecutan tareas para alimentar agentes de IA, se ha convertido en un nuevo frente para fabricantes de chips, fundiciones y proveedores de memoria. Sobre ese tablero, Samsung tiene una oportunidad poco habitual: recuperar peso dentro de la cadena de suministro de Nvidia. El detonante es la tecnología LPU de Groq, diseñada para inferencia de baja latencia. Algunos análisis del sector hablan incluso de adquisición encubierta, aunque el comunicado oficial de Groq describe el movimiento como una licencia no exclusiva de su tecnología de inferencia para Nvidia, acompañada por la incorporación de