Google Cloud y NVIDIA han ampliado su colaboración para llevar la próxima generación de GPUs Vera Rubin a la infraestructura AI Hypercomputer de Google. El anuncio gira en torno a A5X, una nueva familia de instancias bare metal diseñada para cargas de inteligencia artificial agéntica y física, con una promesa de escala difícil de ignorar: hasta 80.000 GPUs NVIDIA Rubin dentro de un único centro de datos y hasta 960.000 GPUs en clústeres distribuidos entre varias ubicaciones.

La cifra no significa que cualquier cliente vaya a pulsar un botón y reservar casi un millón de GPUs de una vez. Sí muestra, en cambio, hacia dónde se dirige la infraestructura de IA de los grandes proveedores cloud: sistemas capaces de unir chips, red, almacenamiento y software de orquestación para que modelos cada vez más complejos puedan entrenarse, ajustarse y ejecutarse con menos cuellos de botella. Google lo presenta como una extensión de su AI Hypercomputer, la misma base tecnológica que usa para Gemini y sus servicios de IA empresariales y de consumo.

A5X: la apuesta de Google por Rubin dentro de su AI Hypercomputer

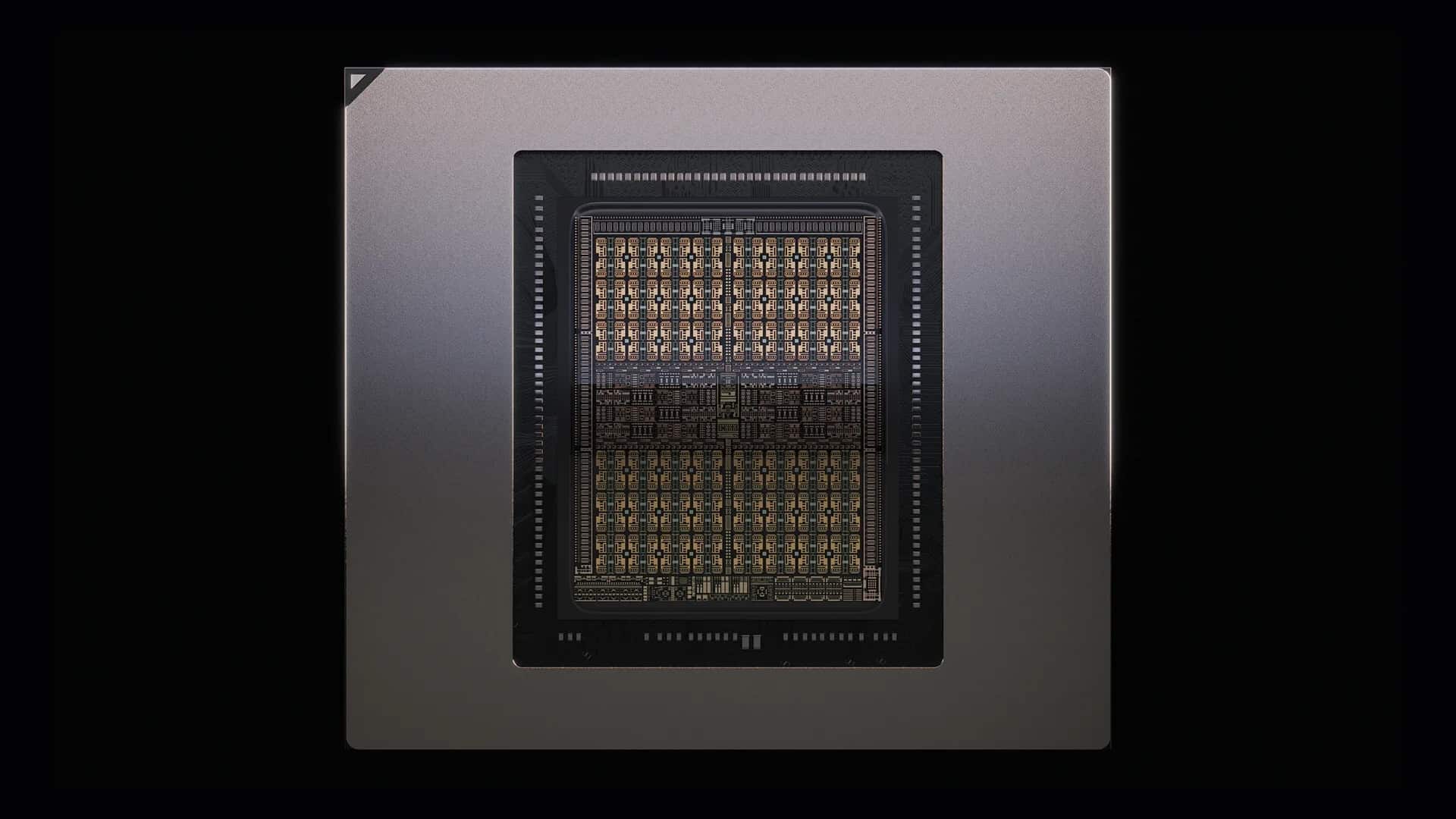

A5X estará basada en la plataforma NVIDIA Vera Rubin NVL72, la arquitectura de nueva generación de NVIDIA para sistemas de IA a escala de rack. Google afirma que será uno de los primeros proveedores en ofrecer instancias basadas en Vera Rubin cuando la plataforma esté disponible más adelante en 2026. La precisión importa: no hablamos de una instancia ya desplegada de forma general, sino de una infraestructura anunciada para la siguiente fase de expansión de Google Cloud.

El enfoque de A5X encaja con una realidad cada vez más visible en el mercado. Las cargas de IA ya no se limitan al entrenamiento de grandes modelos. La inferencia a gran escala, los agentes que ejecutan tareas, los flujos de razonamiento, el ajuste de modelos y la IA física para robótica o gemelos digitales exigen arquitecturas más flexibles. No basta con tener muchas GPUs. Hay que conectarlas con baja latencia, alimentarlas con datos, reiniciar tareas cuando fallan nodos y mantener una utilización alta para que la inversión tenga sentido.

NVIDIA asegura que A5X, mediante la combinación de Vera Rubin NVL72, ConnectX-9 SuperNICs y la red Virgo de Google, podrá ofrecer hasta 10 veces menos coste de inferencia por token y hasta 10 veces más rendimiento de tokens por megavatio frente a la generación anterior. Son cifras de proveedor y deben leerse como estimaciones de rendimiento en escenarios concretos, pero apuntan a un problema real: la IA ya no compite solo por precisión, sino por coste operativo y eficiencia energética.

Google también está integrando conceptos del protocolo de red Falcon, desarrollado junto a NVIDIA a través del Open Compute Project. El objetivo es mejorar la fiabilidad del transporte de datos en redes pensadas para clústeres de IA, donde una pequeña pérdida de eficiencia puede multiplicarse cuando participan decenas de miles de aceleradores.

Virgo y ConnectX-9: la red como pieza central

El dato de las 960.000 GPUs llama la atención, pero la clave técnica está en la red. Google Virgo Network es el tejido de interconexión que la compañía está usando para escalar cargas de IA a nivel de centro de datos y entre varias sedes. Con sus TPUs de octava generación, Google afirma que Virgo puede conectar 134.000 TPUs en un solo centro de datos y más de un millón de TPUs entre múltiples ubicaciones. En el caso de A5X, la misma tecnología se extiende a NVIDIA Vera Rubin NVL72, con los límites anunciados de 80.000 GPUs en una sede y 960.000 en despliegues multisite.

Ese tipo de escala cambia la naturaleza del problema. En clústeres pequeños, la discusión suele centrarse en el rendimiento de cada GPU. En clústeres gigantes, el cuello de botella puede estar en la comunicación entre nodos, la sincronización de entrenamiento, el acceso al almacenamiento, la recuperación ante fallos o la capacidad de repartir cargas sin desperdiciar recursos. Por eso NVIDIA y Google insisten tanto en la combinación entre GPU, NIC, red, software y servicios gestionados.

ConnectX-9 SuperNIC es la pieza de NVIDIA para acelerar comunicaciones de red en infraestructuras cloud sobre Ethernet. Su papel es reducir la penalización que aparece cuando las cargas de IA se reparten entre muchos servidores. Virgo, por su parte, aporta la capa de Google para conectar esa capacidad dentro de su AI Hypercomputer. El resultado busca que los clientes no tengan que ver cada centro de datos como una isla, sino como parte de una superestructura más amplia.

La estrategia también muestra que Google no quiere escoger entre TPUs propias y GPUs de NVIDIA. La compañía está reforzando sus chips internos, como TPU 8t para entrenamiento y TPU 8i para inferencia y aprendizaje por refuerzo, pero al mismo tiempo amplía su oferta basada en NVIDIA. Para los clientes, esa mezcla puede ser útil: algunos modelos y frameworks encajarán mejor en TPU, otros en GPU, y muchas empresas preferirán mantener compatibilidad con CUDA, librerías de NVIDIA y ecosistemas ya probados.

La IA agéntica necesita algo más que aceleradores

Google Cloud presentó estas novedades dentro de un paquete más amplio de infraestructura para la llamada empresa agéntica. Junto a A5X y Virgo, la compañía anunció nuevas máquinas con CPUs Axion basadas en Arm, soporte nativo de PyTorch para TPUs, mejoras en Google Kubernetes Engine, nuevos servicios de almacenamiento de alto rendimiento y capacidades para acelerar el arranque de nodos y pods.

La lectura técnica es clara: los agentes de IA no viven solo dentro del modelo. Necesitan ejecutar llamadas a herramientas, consultar bases de datos, coordinar tareas, guardar contexto, evaluar respuestas, procesar código, recuperar documentos y responder con baja latencia. Las GPUs o TPUs son esenciales para el núcleo del modelo, pero a su alrededor hay una capa de CPU, red, almacenamiento y orquestación que puede marcar la diferencia entre una demo vistosa y un servicio en producción.

Google lo reconoce al destacar sus instancias Axion N4A para runtimes de agentes, cálculos de recompensa, orquestación y tareas de apoyo. También ha mejorado GKE para acelerar el arranque de nodos y pods, y ha introducido un Inference Gateway con enrutamiento predictivo para reducir la latencia hasta el primer token. En una aplicación de IA conversacional, esa latencia puede afectar directamente a la experiencia del usuario.

El almacenamiento es otra parte menos llamativa, pero crítica. Google Cloud Managed Lustre eleva su ancho de banda hasta 10 TB/s y su capacidad hasta 80 petabytes, según la compañía. Además, Rapid Buckets en Google Cloud Storage apunta a checkpoints y recuperaciones de entrenamiento con latencia muy baja. Si los datos no llegan a tiempo, los aceleradores caros se quedan esperando.

Google y NVIDIA se necesitan más de lo que compiten

El anuncio llega en un momento en el que Google está reforzando con fuerza sus TPUs y NVIDIA sigue dominando gran parte del mercado de aceleradores para IA. Vista de forma superficial, la relación podría parecer contradictoria. Google compite con NVIDIA en chips especializados, pero también necesita ofrecer GPUs NVIDIA porque sus clientes las piden y porque buena parte del software de IA empresarial está construido alrededor del ecosistema CUDA.

NVIDIA, por su lado, se beneficia de estar presente dentro de una de las mayores nubes del mundo. Google Cloud aporta clientes, centros de datos, red, servicios gestionados, seguridad, Kubernetes, almacenamiento y una capa empresarial que facilita llevar modelos a producción. Para NVIDIA, vender hardware ya no es suficiente; cada vez importa más que sus plataformas entren dentro de arquitecturas completas de IA.

La colaboración también se extiende a Gemini en Google Distributed Cloud sobre GPUs Blackwell y Blackwell Ultra, máquinas confidenciales con NVIDIA Blackwell y el uso de modelos Nemotron y el framework NeMo dentro de plataformas de agentes. Esto coloca a NVIDIA no solo como proveedor de chips, sino como parte del software stack que las empresas usan para construir agentes, simulaciones, robótica y aplicaciones industriales.

La promesa de clústeres cercanos al millón de GPUs suena descomunal, pero el fondo del anuncio es más práctico. La siguiente fase de la IA no dependerá únicamente de quién tenga el chip más potente, sino de quién pueda combinar aceleradores, red, almacenamiento, software y energía de forma eficiente. Google y NVIDIA están intentando demostrar que esa escala se puede empaquetar como servicio cloud.

Para los clientes, A5X puede convertirse en una opción relevante si necesitan entrenar modelos muy grandes, servir inferencia a gran escala o desplegar agentes complejos con requisitos de rendimiento exigentes. Para el mercado, es otra señal de que la IA entra en una etapa de infraestructura extrema, donde las cifras se acercan al millón de aceleradores y donde cada token generado tiene detrás una arquitectura industrial cada vez más sofisticada.

Preguntas frecuentes

¿Qué es Google Cloud A5X?

A5X es una nueva familia de instancias bare metal de Google Cloud basada en NVIDIA Vera Rubin NVL72, diseñada para cargas de IA agéntica, inferencia masiva, entrenamiento y aplicaciones de IA física.

¿Cuántas GPUs podrá escalar A5X?

Google y NVIDIA hablan de hasta 80.000 GPUs NVIDIA Rubin en un único centro de datos y hasta 960.000 GPUs en clústeres distribuidos entre varias ubicaciones.

¿A5X ya está disponible?

Google indica que A5X estará basada en NVIDIA Vera Rubin NVL72 cuando esta plataforma esté disponible más adelante en 2026. Por tanto, se trata de una capacidad anunciada para la siguiente generación de infraestructura.

¿Por qué Google usa NVIDIA si también tiene TPUs propias?

Porque muchos clientes necesitan GPUs NVIDIA por compatibilidad, rendimiento y ecosistema de software. Google combina sus TPUs con GPUs NVIDIA para ofrecer más opciones según el tipo de carga de IA.