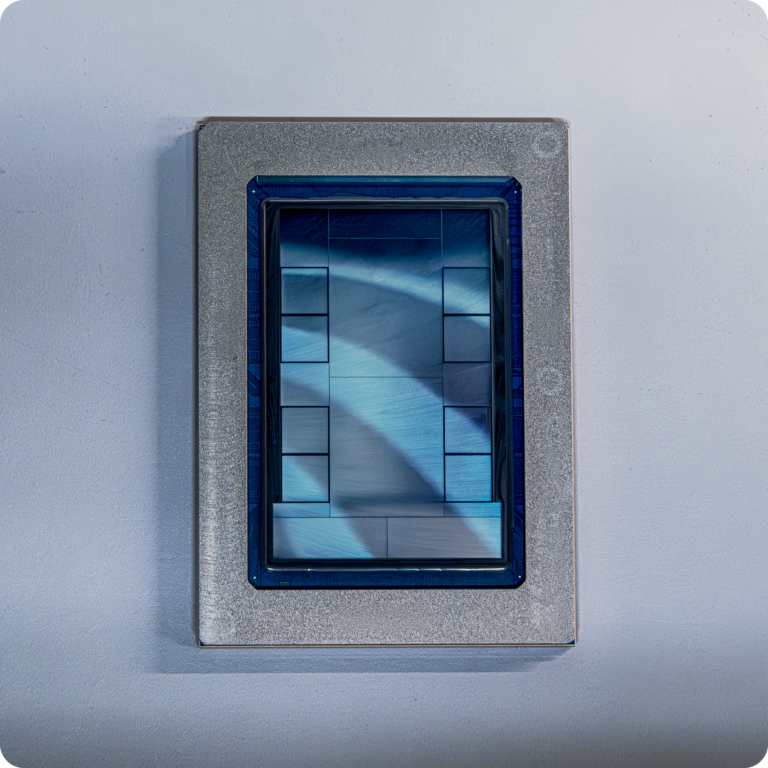

Meta acelera MTIA y se suma a la carrera por chips propios para inferencia

Meta ha decidido pisar el acelerador con su familia de aceleradores propios MTIA y, con ello, reforzar una tendencia que ya se ve con claridad entre los grandes hiperescalares: depender menos de una sola arquitectura GPU para la inferencia de IA. En una entrada técnica publicada por la compañía, Meta detalla cuatro nuevas generaciones de su línea Meta Training and Inference Accelerator —MTIA 300, 400, 450 y 500— con despliegues ya iniciados o previstos entre 2026 y 2027, y con un mensaje central muy claro: la inferencia de IA necesita chips optimizados de forma distinta a los diseñados principalmente para el entrenamiento. La tesis de Meta encaja con un movimiento más amplio del sector. Google ya presentó Ironwood como su