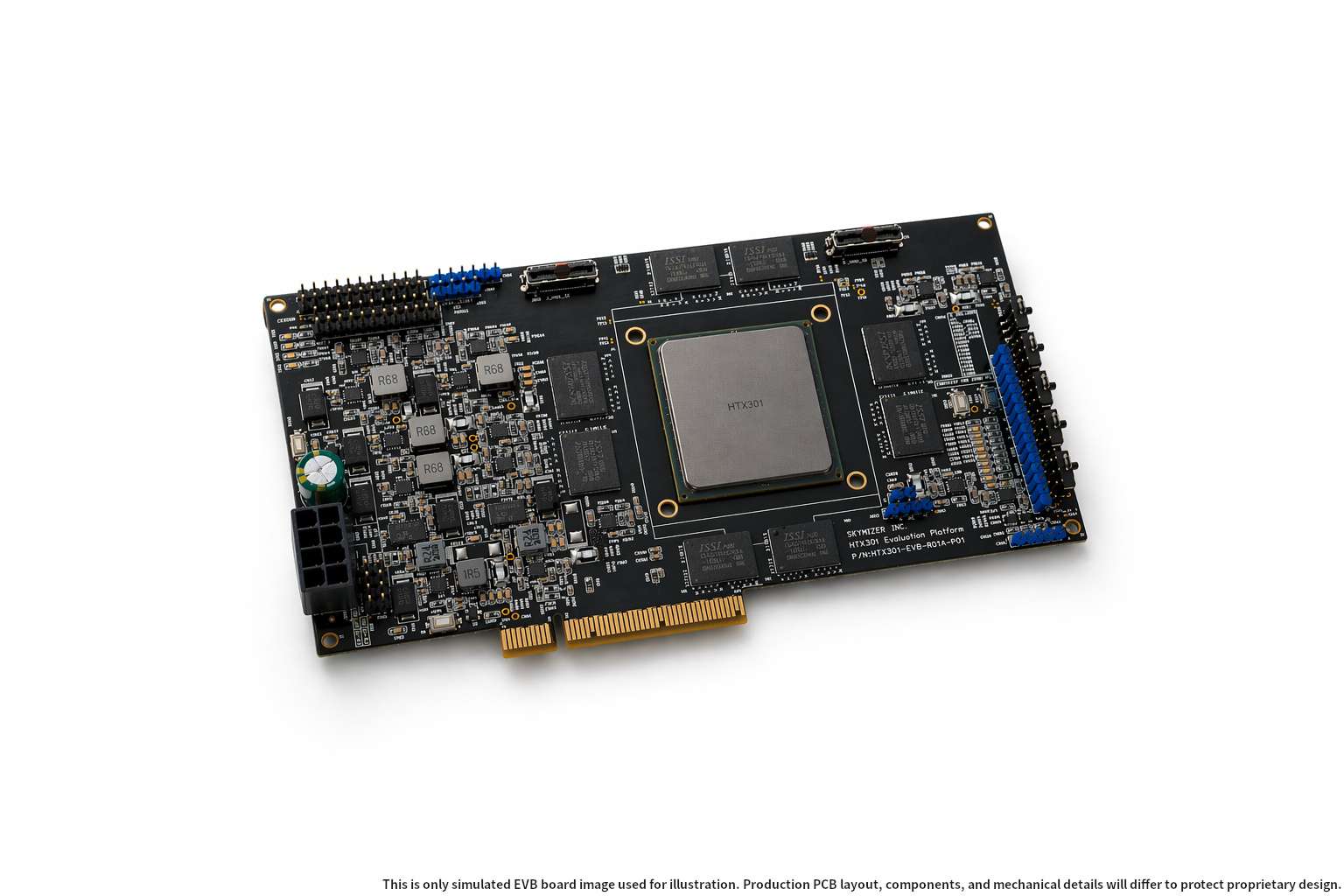

Skymizer ha presentado HTX301, su primer chip de referencia basado en la plataforma HyperThought, con una promesa muy llamativa para el mercado de inferencia de Inteligencia Artificial: ejecutar modelos de lenguaje de hasta 700.000 millones de parámetros en local, sobre una única tarjeta PCIe con seis chips HTX301, 384 GB de memoria y un consumo aproximado de 240 W por tarjeta.

La propuesta apunta directamente a uno de los grandes problemas de la IA empresarial. Muchas compañías quieren usar modelos grandes sin enviar datos sensibles a servicios externos, pero desplegar inferencia avanzada en local suele exigir clústeres de GPU, interconexiones caras, refrigeración compleja y equipos especializados. Skymizer asegura que su arquitectura puede simplificar ese modelo al separar mejor las fases de inferencia y llevar parte del trabajo a silicio diseñado específicamente para generación de tokens.

Conviene leer el anuncio con prudencia. La compañía habla de un avance importante y ofrece acceso anticipado, pero todavía no hay pruebas independientes amplias, datos públicos detallados de rendimiento por modelo, precisión, cuantización, latencia real, coste comercial o disponibilidad masiva. Aun así, el planteamiento es interesante porque encaja con una tendencia clara: la inferencia empieza a pesar más que el entrenamiento en el gasto operativo de la IA.

Un chip pensado para la fase de generación

Skymizer plantea HTX301 como una respuesta al cambio de uso de los grandes modelos. Durante la fase inicial de la IA generativa, buena parte de la atención se centró en entrenar modelos cada vez mayores. Ahora, muchas empresas tienen otro problema: cómo ejecutar esos modelos de forma constante, segura y predecible en aplicaciones reales, agentes, copilotos internos, sistemas de búsqueda, atención al cliente, análisis documental o herramientas de programación.

La clave técnica de HyperThought está en separar dos fases de la inferencia de los modelos de lenguaje. La primera es el “prefill”, cuando el sistema procesa el prompt de entrada. Es una fase más intensiva en cálculo. La segunda es el “decode”, cuando el modelo genera tokens uno a uno. Esta parte suele estar más limitada por ancho de banda de memoria y latencia que por capacidad bruta de cómputo.

Las GPU actuales pueden hacer ambas tareas, pero no siempre son la opción más eficiente para cada una. Skymizer defiende que su arquitectura “decode-first” permite usar chips especializados para la parte de generación, mientras las GPU existentes pueden seguir encargándose de cargas más intensivas en cálculo. De hecho, la propia compañía indica que HTX301 complementa la infraestructura GPU, en lugar de reemplazarla por completo.

Este matiz es importante. El mensaje más llamativo del anuncio habla de acabar con la necesidad de grandes clústeres GPU para ejecutar modelos enormes en local. Pero, en la práctica, la estrategia técnica presentada por Skymizer parece más matizada: usar hardware especializado para mejorar la eficiencia de la inferencia y liberar GPU en determinados escenarios.

Soberanía del dato y costes más previsibles

El argumento empresarial es tan relevante como el técnico. Skymizer apunta a compañías que no quieren depender de inferencia por token en la nube pública. En sectores como banca, salud, legal, administración, defensa, industria o diseño de chips, enviar datos a plataformas externas puede ser problemático por privacidad, regulación, propiedad intelectual o control operativo.

Una tarjeta capaz de ejecutar modelos grandes en local, si cumple lo prometido, podría cambiar el coste y la arquitectura de algunos despliegues. En lugar de pagar por uso en servicios cloud o montar clústeres complejos, una empresa podría instalar capacidad propia para cargas concretas y mantener datos, modelos y respuestas dentro de su infraestructura.

La compañía también menciona casos como copilotos privados de código, asistentes para diseño RTL, revisión de contratos, análisis clínico, detección de fraude o agentes empresariales. Son escenarios donde la latencia, la privacidad y el coste predecible importan mucho. No obstante, cada caso dependerá del modelo elegido, del volumen de consultas, de los requisitos de seguridad y de la calidad del ecosistema de software.

HTX301 se apoya en LISA, la Language Instruction Set Architecture de Skymizer, una arquitectura propia orientada a inferencia de transformadores. La empresa ya había presentado HyperThought como una IP para aceleración de IA generativa y multimodal, con una visión que va desde dispositivos edge hasta despliegues on-premise. Synopsys explicó en 2025 que Skymizer había usado su plataforma HAPS para validar HyperThought en hardware antes de disponer de silicio definitivo, lo que apunta a un desarrollo apoyado en prototipado y co-diseño hardware/software.

Una promesa potente, pero pendiente de validación

La afirmación más ambiciosa del anuncio es que una sola tarjeta PCIe con seis chips HTX301 y 384 GB de memoria puede ejecutar inferencia de modelos de 700B parámetros con unos 240 W. La cifra es muy atractiva si se compara con el despliegue habitual de modelos grandes sobre múltiples GPU de gama alta. Pero faltan detalles esenciales para evaluar el alcance real: formato exacto del modelo, tipo de cuantización, tokens por segundo, número de usuarios concurrentes, tamaño de contexto, calidad de salida, rendimiento sostenido y comparación frente a GPUs actuales en condiciones equivalentes.

En IA, la memoria disponible no cuenta toda la historia. Un modelo de 700B parámetros puede ocupar cantidades muy distintas según precisión y cuantización. También hay que considerar la memoria para KV cache, contexto, batch, runtime y orquestación. Por eso el anuncio abre una posibilidad interesante, pero todavía necesita benchmarks independientes y pruebas con modelos conocidos para medir su impacto real.

La dirección del mercado, sin embargo, favorece este tipo de propuestas. A medida que las empresas pasan de experimentar con chatbots a desplegar agentes y automatizaciones, la inferencia deja de ser una prueba ocasional y se convierte en una carga continua. Cada consulta, cada agente, cada tarea encadenada y cada workflow consume tokens. Si ese consumo se dispara, el coste de inferencia en la nube puede convertirse en una barrera.

Ahí es donde entran arquitecturas alternativas a la GPU generalista. No solo Skymizer. Todo el sector está buscando chips especializados, NPUs, LPUs, aceleradores para edge, ASICs de inferencia, memoria más cercana al cómputo y nuevas formas de separar cargas. El objetivo no es siempre ganar en potencia máxima, sino mejorar coste por token, consumo, latencia y facilidad de despliegue.

Skymizer intenta diferenciarse con una propuesta de pila completa: chip, tarjeta, memoria, ISA y software de orquestación para separar prefill y decode. Si consigue convertir esa visión en producto estable, podría encontrar espacio en empresas que buscan IA privada y controlada sin montar una infraestructura de hiperescala.

La pregunta ahora es si HTX301 será una alternativa real o una promesa más en un mercado lleno de anuncios ambiciosos. El hardware de IA es difícil: no basta con tener un buen chip. Hace falta software, compiladores, soporte de modelos, integración con frameworks, actualizaciones, herramientas de monitorización, disponibilidad comercial y confianza del cliente. Las GPU no dominan solo por rendimiento, sino por ecosistema.

HTX301 merece atención porque apunta a una necesidad real: hacer que la inferencia local de modelos grandes sea más sencilla, eficiente y asequible. Pero su impacto dependerá de pruebas en producción, no de titulares. Si Skymizer demuestra rendimiento sostenido y compatibilidad práctica con modelos empresariales, puede abrir una vía interesante para llevar IA avanzada fuera de los grandes centros de datos cloud.

Preguntas frecuentes

¿Qué es Skymizer HTX301?

HTX301 es el primer chip de referencia de Skymizer basado en la plataforma HyperThought, diseñado para inferencia de modelos de lenguaje y cargas de IA en entornos locales.

¿Puede ejecutar modelos de 700B parámetros en una sola tarjeta?

Skymizer afirma que una tarjeta PCIe con seis chips HTX301 y 384 GB de memoria puede ejecutar inferencia local de modelos de hasta 700B parámetros con un consumo aproximado de 240 W. Faltan pruebas independientes amplias para validar rendimiento real, precisión y condiciones exactas.

¿HTX301 sustituye a las GPU?

No necesariamente. Skymizer presenta HTX301 como una arquitectura complementaria que puede descargar la fase de decode de la inferencia, mientras las GPU pueden seguir encargándose de tareas más intensivas en cálculo.

¿Para qué empresas puede ser útil?

Puede resultar interesante para organizaciones que quieren ejecutar IA en local por privacidad, soberanía del dato, latencia o coste predecible, especialmente en banca, salud, legal, administración, industria, defensa o desarrollo de software.

vía: skymizer.ai