Una operación sofisticada desvela cómo identidades sintéticas generadas con inteligencia artificial están siendo utilizadas para sortear procesos de contratación globales.

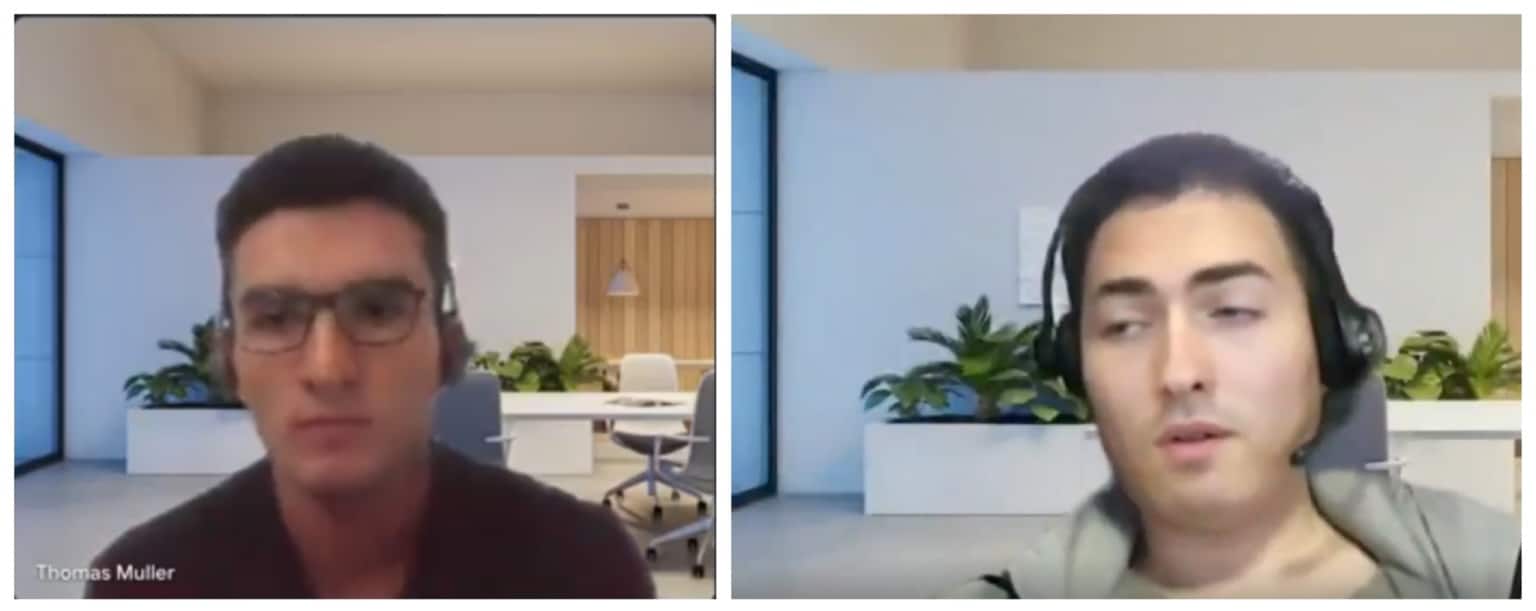

El grupo Unit 42 de Palo Alto Networks ha revelado una preocupante campaña de ciberinfiltración orquestada por trabajadores IT vinculados al régimen de Corea del Norte, quienes están utilizando tecnologías de deepfake en tiempo real para obtener empleos remotos en empresas de todo el mundo. El objetivo final: sortear sanciones internacionales y obtener acceso privilegiado a entornos corporativos.

Una nueva frontera en la ingeniería social digital

Según el informe, estos operadores norcoreanos crean identidades falsas mediante técnicas de sustitución facial (face-swapping) durante entrevistas de trabajo en línea, llegando a simular múltiples candidatos desde un mismo equipo. Utilizando hardware asequible —en un caso, una GPU NVIDIA GTX 3070 en un portátil de hace cinco años—, un usuario sin experiencia previa logró montar una identidad falsa funcional en poco más de una hora.

Esta accesibilidad tecnológica eleva el nivel de riesgo para las organizaciones, que podrían enfrentarse a brechas de seguridad, filtraciones de datos e incluso sabotajes internos por parte de actores patrocinados por estados.

Debilidades técnicas de los deepfakes: una oportunidad para detectarlos

Aunque la tecnología de deepfake ha evolucionado rápidamente, aún presenta ciertos defectos que pueden ser utilizados para su detección. El equipo de Unit 42 identificó algunos indicadores clave:

- Inconsistencias temporales: los movimientos rápidos de cabeza causan artefactos visuales por problemas en el seguimiento de rasgos faciales.

- Manejo de oclusiones: si una mano pasa por delante del rostro, el sistema falla al reconstruir la parte oculta.

- Problemas con la iluminación: cambios bruscos de luz pueden desvelar que se trata de un rostro generado.

- Desincronización labial: ligeros retrasos entre el audio y los movimientos labiales pueden evidenciar la manipulación.

Estrategias para mitigar el riesgo

Los expertos recomiendan una defensa en capas para proteger los procesos de contratación frente a estas amenazas emergentes. Algunas recomendaciones clave son:

Para los equipos de Recursos Humanos:

- Grabar entrevistas (previa autorización) para su posterior análisis forense.

- Incorporar procesos de verificación de identidad con detección de vida (liveness detection).

- Capacitar a los entrevistadores para identificar señales de manipulación visual o desincronización.

Para los equipos de Seguridad:

- Monitorizar direcciones IP sospechosas o ubicaciones inusuales.

- Verificar el origen de los números de teléfono (VoIP o virtuales).

- Bloquear el uso de cámaras virtuales o software de manipulación no autorizado.

- Establecer alianzas de intercambio de información con otras empresas y agencias gubernamentales.

Además, se aconseja implementar controles de acceso graduales para nuevos empleados y reforzar las políticas internas frente a la suplantación de identidad, incluyendo protocolos de actuación y campañas de concienciación sobre ciberseguridad.

Un nuevo frente en la guerra cibernética

Este fenómeno no solo representa un avance en las técnicas de ingeniería social, sino también una nueva vía para que Corea del Norte eluda las restricciones económicas y obtenga financiación mediante el empleo remoto fraudulento. La manipulación de entrevistas mediante deepfakes añade una capa de complejidad sin precedentes al proceso de selección de talento.

En un entorno cada vez más digital y descentralizado, los departamentos de RRHH y ciberseguridad deben colaborar estrechamente para establecer mecanismos de defensa avanzados que garanticen la integridad del personal contratado. El deepfake, hasta hace poco una curiosidad tecnológica, se está consolidando como una herramienta de ataque en manos de actores estatales. Y la mejor defensa empieza por saber detectarlo.

Imagen fuente: Daniel Grek Sanchez Castellanos and Bettina Liporazzi.

fuente: GBhackers y Palo Alto.