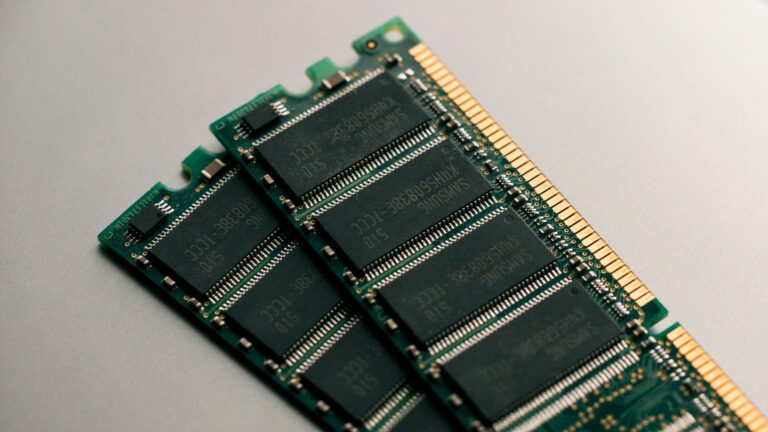

La fiebre de la Inteligencia Artificial dispara el precio de la DRAM: ingresos récord y subidas aún mayores en 2026

La expansión de la Inteligencia Artificial desde el entrenamiento de grandes modelos de lenguaje (LLM) hacia la fase de inferencia —donde esos modelos se ejecutan en producción— está reconfigurando silenciosamente la economía de los centros de datos. Y, con ella, un componente que parecía “de fondo” vuelve al primer plano: la memoria. Según el último análisis de TrendForce, los grandes proveedores de servicios en la nube (CSP) están ampliando sus despliegues más allá de los servidores de IA para incluir también más servidores de propósito general. Este cambio está extendiendo la compra de memoria: ya no se trata solo de HBM3e, LPDDR5X o RDIMM de gran capacidad, sino de RDIMM en múltiples densidades para abastecer un parque de servidores más