China ha vuelto a mover ficha en la carrera global por la inteligencia artificial. El Instituto de Automatización de la Academia China de Ciencias (CASIA) acaba de presentar SpikingBrain-1.0, un modelo que no solo supone un avance técnico relevante, sino también un golpe geopolítico: por primera vez, un modelo de frontera ha sido entrenado sin recurrir a chips de NVIDIA ni al ecosistema CUDA, y además utilizando una arquitectura distinta a la que domina el sector.

El proyecto introduce dos rupturas claras con el statu quo:

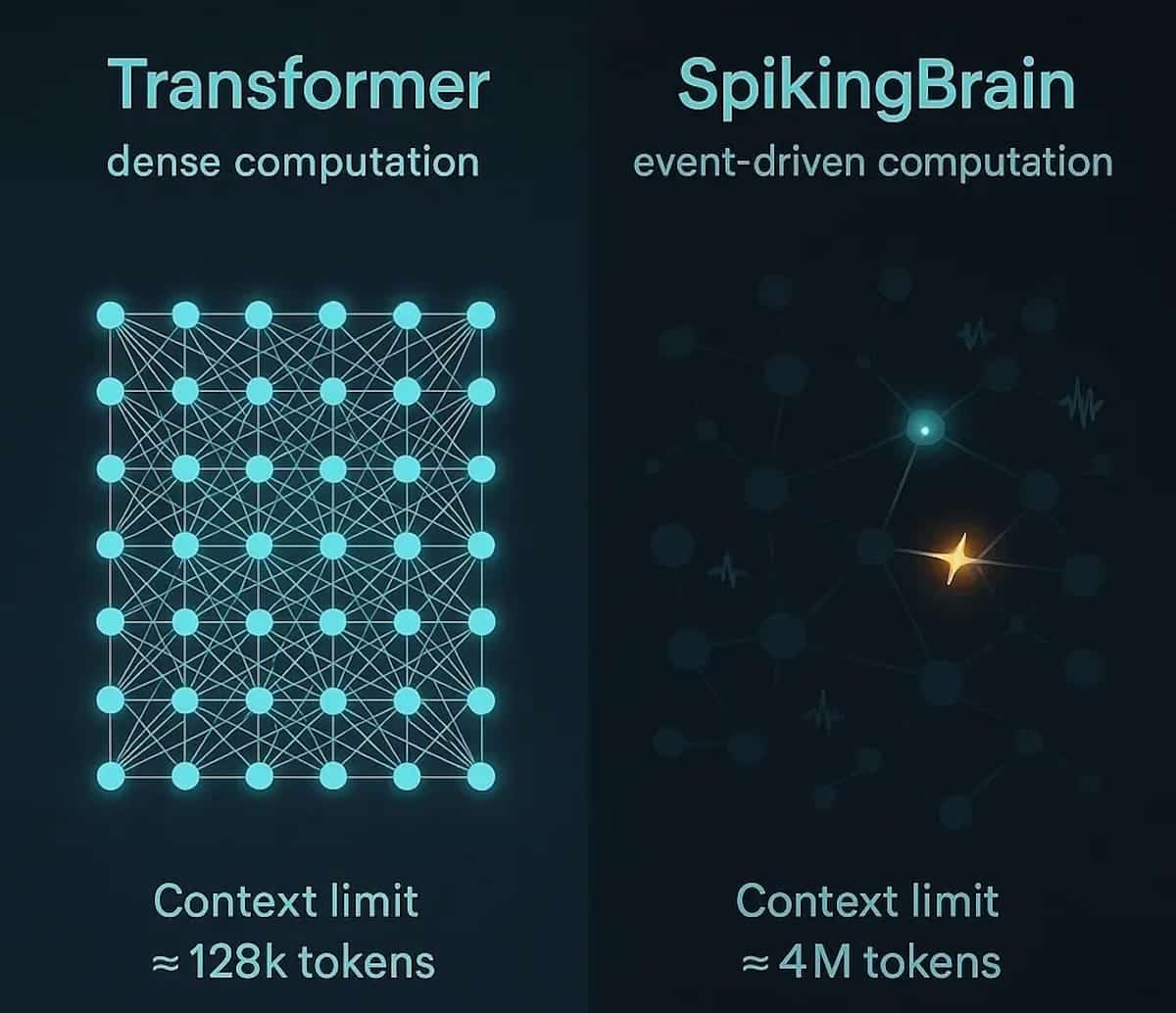

- Arquitectura innovadora: en lugar de transformers, utiliza redes neuronales de picos (SNNs) inspiradas en el cerebro humano.

- Independencia tecnológica: el entrenamiento se realizó exclusivamente en GPUs MetaX C550, fabricadas en China.

Redes neuronales de picos: eficiencia inspirada en el cerebro

Las SNNs funcionan de forma distinta a los transformers. En lugar de activaciones continuas, las neuronas disparan pulsos discretos cuando alcanzan un umbral, de forma similar al sistema nervioso biológico. Este modelo de computación orientado a eventos y altamente disperso reduce el consumo energético y mejora la velocidad de procesamiento en contextos largos.

Según su informe técnico, SpikingBrain-1.0 puede procesar secuencias de hasta 4 millones de tokens, un salto frente al rango de 128.000 a 1 millón que ofrecen los LLM convencionales. Además, la versión de 7.000 millones de parámetros consigue:

- 26 veces más velocidad en inferencia a 1 millón de tokens.

- 100 veces más rápido en inferencia a 4 millones de tokens.

Entrenamiento sin NVIDIA: la apuesta por MetaX C550

El segundo pilar de este avance es el hardware. China ha logrado entrenar SpikingBrain-1.0 en cientos de GPUs MetaX C550, aceleradores diseñados como alternativa nacional a las NVIDIA A100/H100.

Esto representa un desacoplamiento estratégico de la infraestructura tecnológica dominada por EE. UU. y muestra que Pekín puede avanzar en modelos de frontera pese a las restricciones de exportación. No solo es un logro técnico: es un mensaje político que apunta a la creación de un stack de IA soberano, con hardware y software independientes.

Comparativa: SpikingBrain-1.0 frente a los líderes actuales

Para entender mejor el alcance de este modelo, conviene compararlo con los principales LLM del mercado:

| Modelo | Arquitectura | Hardware de entrenamiento | Tokens de contexto máximo | Velocidad en contexto largo | Dependencia de NVIDIA |

|---|---|---|---|---|---|

| SpikingBrain-1.0 | Redes de picos (SNN) | GPUs MetaX C550 (China) | 4.000.000 | 26× más rápido (1M), 100× más rápido (4M) | No |

| GPT-4.1 | Transformer | GPUs NVIDIA H100 + CUDA | 200.000 – 1.000.000 | Alta, pero con gran coste energético | Sí |

| Claude Sonnet (Anthropic) | Transformer | GPUs NVIDIA A100/H100 | 200.000 – 1.000.000 | Eficiente en razonamiento, pero limitado en secuencias largas | Sí |

| Gemini 1.5 (Google DeepMind) | Transformer | TPUv5 + GPUs NVIDIA | 1.000.000 | Optimizado para multimodalidad, no para ultra-contextos | Parcial |

| Llama 3.1 (Meta) | Transformer (open source) | GPUs NVIDIA A100/H100 | 128.000 – 256.000 | Correcto en inferencia estándar, no diseñado para contextos extendidos | Sí |

Un avance con implicaciones globales

El lanzamiento de SpikingBrain-1.0 trasciende lo puramente técnico. Marca el inicio de un camino alternativo al modelo Silicon Valley, caracterizado por:

- Diversificación arquitectónica: demuestra que la IA no depende únicamente de transformers.

- Eficiencia energética: SNNs podrían reducir de manera drástica el consumo en centros de datos.

- Soberanía tecnológica: China prueba que puede entrenar modelos de frontera sin depender de EE. UU.

- Geopolítica de la IA: se refuerza la idea de un “mundo bifurcado” en inteligencia artificial.

Un primer paso hacia la IA neuromórfica

Aunque SpikingBrain-1.0 aún no iguala en capacidades generales a los gigantes como GPT-4.1, su valor radica en mostrar una dirección distinta. La computación neuromórfica, inspirada en el cerebro, promete superar los límites actuales de escalabilidad y sostenibilidad, lo que podría redefinir la próxima generación de IA.

Hoy es una prueba de concepto ambiciosa. Mañana podría ser el nuevo estándar.

Conclusión

El debut de SpikingBrain-1.0 es mucho más que un experimento académico: es un aviso al mundo. China no solo quiere competir en IA, quiere hacerlo con su propio modelo tecnológico y político. Y aunque todavía queda camino para que alcance a los LLM líderes, la apuesta por arquitecturas neuromórficas y hardware nacional podría situar al país en una posición de ventaja en la próxima década.

En resumen: menos transformers, más neuronas inteligentes, y sin NVIDIA en el horizonte.

Preguntas frecuentes

¿Qué ventajas tiene SpikingBrain-1.0 frente a modelos como GPT-4?

Ofrece contextos mucho más largos (hasta 4 millones de tokens) y un rendimiento hasta 100 veces más rápido en inferencias largas, con menor consumo energético.

¿En qué hardware se entrenó el modelo?

Se entrenó en GPUs MetaX C550, fabricadas en China, sin depender de NVIDIA ni de CUDA.

¿SpikingBrain-1.0 es ya un rival para GPT-4 o Claude?

No todavía. Aunque no alcanza su rendimiento global, sí marca un camino alternativo y prometedor hacia arquitecturas más eficientes y sostenibles.

¿Qué significa este avance en términos geopolíticos?

Demuestra que China puede desarrollar modelos de frontera sin hardware estadounidense, lo que refuerza su soberanía tecnológica y acelera el desacoplamiento entre los ecosistemas de IA de Oriente y Occidente.

vía: ArViX