OpenAI podría estar preparando uno de los movimientos de infraestructura más ambiciosos vistos hasta ahora en la carrera por la Inteligencia Artificial. Según una información publicada por The Information y recogida posteriormente por otros medios financieros, la compañía habría acordado destinar más de 20.000 millones de dólares en tres años a servidores basados en chips de Cerebras, en una operación que además incluiría warrants o participación accionarial y apoyo adicional para centros de datos adaptados a este hardware. Ni OpenAI ni Cerebras han confirmado públicamente esos detalles por ahora.

Lo que sí está confirmado es que ambas empresas ya anunciaron en enero una alianza plurianual para desplegar 750 MW de cómputo de inferencia de muy baja latencia con sistemas wafer-scale de Cerebras, un despliegue que comenzará por fases desde 2026. OpenAI explicó entonces que esa capacidad se orientaría a acelerar la respuesta de sus servicios en escenarios donde la latencia importa especialmente, como programación, búsquedas complejas, imágenes y agentes.

Ese matiz es importante porque deja claro que OpenAI no estaría intentando sustituir todo su parque de hardware con Cerebras, sino diversificar su infraestructura según el tipo de carga. El mercado de la IA ya no gira solo en torno al entrenamiento de modelos gigantes, sino cada vez más en torno a la inferencia: servir respuestas a millones de usuarios con rapidez, interactividad y costes sostenibles. Ahí es donde Cerebras intenta hacerse fuerte.

Una apuesta que va más allá de comprar chips

Si la operación termina cerrándose en los términos publicados, no se trataría de una compra puntual de aceleradores, sino de una alianza de infraestructura bastante más profunda. La información que circula en medios anglosajones apunta a una combinación de capacidad de cómputo, financiación para centros de datos y posible acceso de OpenAI al capital de Cerebras mediante warrants, con la opción de elevar su peso accionarial si el gasto total siguiera creciendo. Pero, a día de hoy, esos elementos deben tratarse como no confirmados oficialmente.

Lo confirmado hasta ahora es el interés estratégico de OpenAI por ampliar su base de cómputo. La compañía anunció en marzo el cierre de una ronda de financiación de 122.000 millones de dólares en capital comprometido, con una valoración post-money de 852.000 millones. OpenAI dijo explícitamente que ese dinero serviría para acelerar “la siguiente fase” de su infraestructura de IA.

Visto en ese contexto, Cerebras encaja como una pieza especializada dentro de una cartera de hardware cada vez más heterogénea. No parece una jugada pensada para reemplazar de forma universal a otros fabricantes, sino para reforzar una capa concreta: la inferencia rápida y de baja latencia.

Por qué Cerebras se ha convertido en una pieza interesante

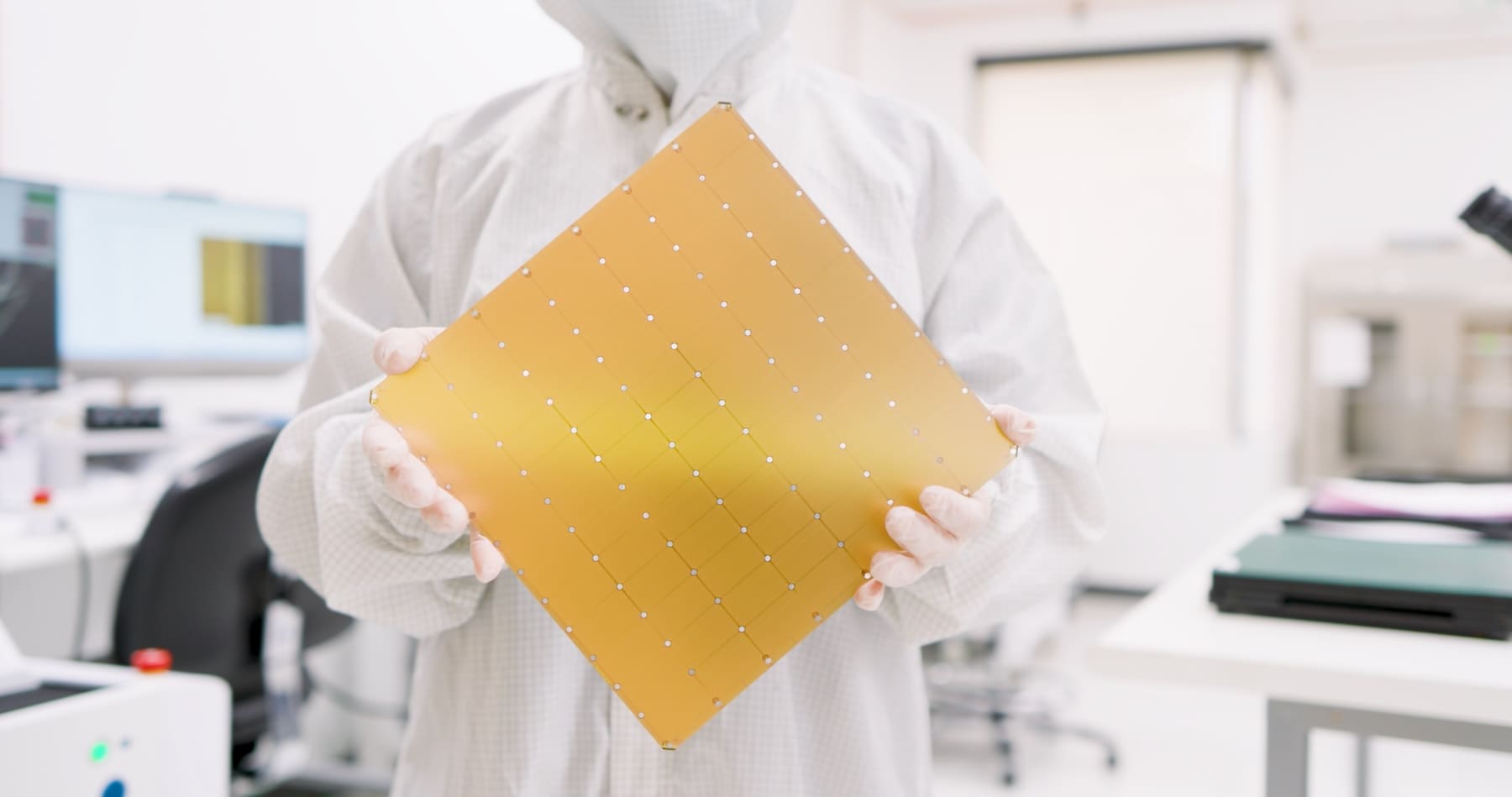

Cerebras se hizo conocida por desafiar una de las convenciones más establecidas de la industria: en lugar de construir chips pequeños y escalar con grandes clústeres, apostó por procesadores a escala de oblea completa. Su WSE-3, según la propia compañía, mide 46.225 mm², integra 4 billones de transistores y ofrece 125 petaflops de cómputo de IA mediante 900.000 núcleos optimizados para este tipo de cargas. Cerebras lo presenta como el chip de IA más grande jamás fabricado.

Más allá del impacto visual de esas cifras, la clave es su enfoque sobre inferencia. La empresa insiste en que su arquitectura reduce cuellos de botella habituales en sistemas GPU y favorece respuestas muy rápidas en tiempo real. Esa promesa la ha convertido en una opción atractiva para proveedores que buscan acelerar experiencias conversacionales, generación de código y otras cargas donde cada milisegundo cuenta.

No es casualidad que AWS también haya querido subirse a esa idea. En marzo, Amazon y Cerebras anunciaron una colaboración para llevar sistemas CS-3 a centros de datos de AWS y exponerlos a través de Amazon Bedrock. La arquitectura combinada repartirá el trabajo entre AWS Trainium para la fase de prefill y Cerebras CS-3 para la fase de decode, precisamente el mismo tipo de separación funcional que se está imponiendo en la inferencia moderna.

La guerra de la IA cambia de foco

Durante los dos últimos años, buena parte del relato del sector ha estado dominado por el entrenamiento de modelos fundacionales y la acumulación masiva de GPUs. Sin embargo, la siguiente batalla parece estar desplazándose hacia otro terreno: quién puede servir esos modelos más rápido, con menor latencia, mejor coste y a mayor escala.

Ese cambio de foco beneficia a actores como Cerebras, que no compiten tanto por ser el estándar universal del entrenamiento, sino por ofrecer ventajas muy específicas en inferencia. OpenAI lo dejó entrever en enero al justificar su acuerdo con la empresa: no hablaba solo de más potencia, sino de tiempos de respuesta y experiencia interactiva para usuarios finales.

Si finalmente OpenAI amplía su relación con Cerebras en la magnitud que se está publicando, el mensaje sería claro: la infraestructura de IA del futuro no dependerá de una sola familia de chips ni de una única arquitectura. Se parecerá más a una mezcla de piezas especializadas según la tarea: entrenamiento, inferencia masiva, inferencia de baja latencia, agentes, multimodalidad o servicios empresariales.

Un movimiento con efectos también para Cerebras

Para Cerebras, la operación tendría una importancia enorme. La compañía ha reactivado su salida a bolsa en Estados Unidos y la existencia de un cliente como OpenAI, con compromisos multimillonarios ligados a despliegues reales, mejora claramente su posición de cara al mercado. La prensa financiera ya relaciona esta alianza con el renovado intento de la empresa por salir a cotizar.

También refuerza una percepción que hasta hace poco parecía lejana: que ya no basta con ser “la alternativa a NVIDIA”. Ahora empieza a importar ser la alternativa correcta para una parte muy concreta del stack de IA. Cerebras está intentando ocupar precisamente ese hueco.

Preguntas frecuentes

¿OpenAI ha confirmado oficialmente una inversión superior a 20.000 millones de dólares en Cerebras?

No. Lo confirmado oficialmente es la alianza anunciada en enero para desplegar 750 MW de cómputo de inferencia. Los detalles sobre una operación superior a 20.000 millones, participación accionarial y apoyo adicional a centros de datos proceden de informaciones publicadas por The Information y recogidas por otros medios, pero no han sido confirmados por OpenAI ni por Cerebras.

¿Qué hace diferente a Cerebras frente a otros fabricantes de hardware para IA?

Su rasgo más distintivo es la arquitectura wafer-scale. El WSE-3 ocupa una oblea completa y ofrece 900.000 núcleos optimizados para IA, 4 billones de transistores y 125 petaflops, según la propia compañía.

¿Por qué OpenAI estaría interesada en este hardware?

Porque Cerebras está orientando su propuesta a inferencia rápida y de muy baja latencia, un aspecto clave para productos conversacionales, agentes, generación de código e imágenes en tiempo real. Eso complementa otras capas de infraestructura más enfocadas al entrenamiento.

¿Qué relación tiene todo esto con la financiación reciente de OpenAI?

OpenAI anunció en marzo una ronda de 122.000 millones de dólares en capital comprometido para acelerar su siguiente fase de infraestructura de IA. Esa capacidad financiera da contexto a acuerdos de infraestructura a gran escala como el que se atribuye a Cerebras.