OpenAI ha presentado Privacy Filter, un nuevo modelo de pesos abiertos pensado para detectar y enmascarar información personal identificable en texto antes de que ese contenido se indexe, se registre o alimente otros sistemas de IA. La compañía lo publica bajo licencia Apache 2.0 y lo orienta a flujos de saneamiento de datos de alto rendimiento, con una idea central muy clara: que las empresas puedan ejecutar el filtrado en local, sin necesidad de enviar el texto sensible a servicios externos.

La novedad tiene bastante recorrido para un medio tecnológico porque llega en un momento en que muchas organizaciones están construyendo asistentes internos, pipelines de observabilidad, sistemas RAG y bases vectoriales que consumen grandes volúmenes de texto. En todos esos casos aparece el mismo riesgo: si no se filtran antes los datos sensibles, nombres privados, correos, teléfonos, números de cuenta o secretos como claves API pueden acabar indexados o reutilizados donde no deben. OpenAI plantea Privacy Filter como una capa previa de protección para reducir ese problema desde la base.

Un modelo pequeño, rápido y pensado para producción

A diferencia de un LLM generativo clásico, Privacy Filter no redacta texto ni responde preguntas. Es un modelo de clasificación bidireccional de tokens con decodificación de spans, lo que le permite analizar una secuencia completa en una sola pasada y etiquetar qué fragmentos deben ocultarse. OpenAI sostiene que ese diseño mejora la velocidad y el rendimiento operativo frente a enfoques más pesados basados en generación token a token.

En tamaño también juega otra liga. Según la documentación publicada por OpenAI en Hugging Face y GitHub, el modelo tiene 1.500 millones de parámetros totales y 50 millones de parámetros activos, una arquitectura suficientemente contenida como para ejecutarse “en un navegador web o en un portátil”. Además, soporta una ventana de contexto de 128.000 tokens, lo que permite procesar documentos largos sin tener que trocearlos continuamente. Para entornos corporativos donde la latencia y el coste importan tanto como la privacidad, ese equilibrio entre tamaño y capacidad puede ser más útil que recurrir a un modelo mucho mayor para una tarea más concreta. En la cobertura del lanzamiento desde el ángulo de IA y modelo abierto se profundiza, además, en cómo encaja Privacy Filter en la estrategia de pesos abiertos de OpenAI, una pieza más para entender el movimiento dentro del mapa actual de modelos especializados.

Otra de las ventajas prácticas es que el modelo no se limita a una coincidencia por patrones rígidos. OpenAI explica que está pensado para trabajar con texto desestructurado y con decisiones dependientes del contexto, algo importante cuando una misma cadena puede ser inocua en un caso y muy sensible en otro. Esa ambición lo sitúa un escalón por encima de muchas herramientas tradicionales de detección de PII basadas solo en expresiones regulares o reglas de formato.

Qué detecta y por qué puede ser útil antes de un sistema RAG

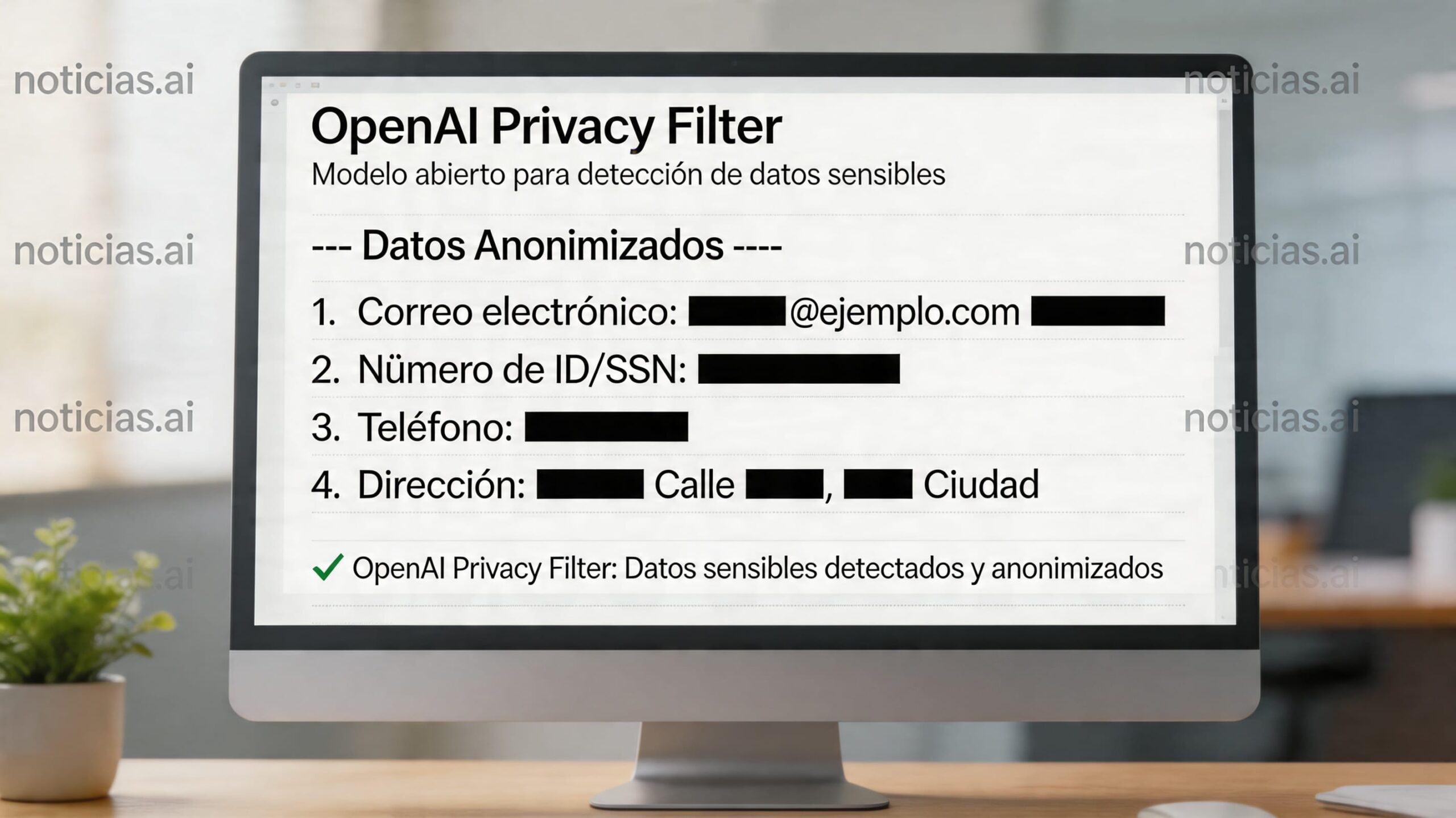

Privacy Filter trabaja con una taxonomía cerrada de ocho categorías: account_number, private_address, private_email, private_person, private_phone, private_url, private_date y secret. En términos prácticos, eso cubre desde nombres privados, direcciones o correos hasta números de cuenta, tarjetas, contraseñas o claves API. Además, la salida usa un esquema BIOES, lo que ayuda a marcar con precisión el principio y el final de cada fragmento sensible en lugar de devolver solo coincidencias sueltas.

Ese detalle es especialmente interesante para despliegues reales. En un sistema RAG, por ejemplo, el mayor valor de una herramienta así no está solo en “tapar” texto, sino en funcionar como gatekeeper antes de la ingesta: si detecta un secret o un account_number, la organización puede bloquear el documento o redirigirlo a revisión humana antes de que acabe indexado en una base vectorial. OpenAI no lo vende con ese término concreto, pero sí dice de forma expresa que el modelo está pensado para training, indexing, logging and review pipelines, es decir, para capas previas donde el control de datos importa mucho.

En rendimiento, OpenAI afirma que Privacy Filter alcanza un 96 % de F1 en el benchmark PII-Masking-300k, con 94,04 % de precisión y 98,04 % de recall. La compañía añade que, al corregir problemas de anotación detectados en ese conjunto de datos durante su evaluación, la puntuación sube a 97,43 % de F1, y sostiene además que el ajuste fino con pequeñas cantidades de datos puede mejorar mucho el comportamiento en dominios específicos. Son cifras sólidas, aunque, como siempre en este tipo de anuncios, conviene recordar que proceden de la propia evaluación del fabricante y que el rendimiento real depende del dataset, del idioma y del contexto de despliegue.

El matiz que no conviene perder: no es anonimización total

Aquí está probablemente la parte más importante del lanzamiento. Tanto en su página oficial como en la ficha de Hugging Face, OpenAI insiste en que Privacy Filter es una herramienta de redacción y minimización de datos, pero no una solución de anonimización completa, no una certificación de cumplimiento y no una garantía de seguridad por sí sola. La compañía recomienda usarlo como una capa más dentro de una estrategia de privacy by design, no como una coartada para asumir que todo riesgo ha desaparecido.

Ese aviso importa porque anonimizar no consiste solo en borrar campos obvios. En muchos conjuntos de datos, una persona puede reidentificarse combinando fechas, ubicaciones, contexto laboral o referencias cruzadas aunque el nombre y el correo ya no estén visibles. OpenAI no entra en el detalle jurídico de esa reidentificación, pero sí deja claro que el modelo solo detecta lo que entra dentro de su taxonomía entrenada y que distintas organizaciones pueden necesitar políticas más estrictas, más amplias o diferentes de las predeterminadas.

También conviene rebajar una idea que se ha repetido mucho desde su lanzamiento: Privacy Filter no está presentado oficialmente como un modelo “nativo en español”. La ficha oficial de Hugging Face y el repositorio de GitHub indican que el idioma principal es inglés, aunque se haya realizado cierta evaluación de robustez multilingüe. OpenAI avisa además de que el rendimiento puede bajar en textos no ingleses, en escrituras no latinas o en dominios alejados de la distribución de entrenamiento. Puede ser útil en español, sí, pero venderlo como si estuviera optimizado específicamente para ese idioma sería ir más allá de lo que dice la documentación oficial.

En cualquier caso, el lanzamiento marca una dirección interesante: modelos pequeños, especializados, auditables y ejecutables en local para problemas muy concretos de producción. No sustituyen a una política de privacidad, ni a una revisión legal, ni a una arquitectura segura. Pero en un ecosistema que cada vez mueve más texto entre agentes, vectores, logs y flujos automáticos, disponer de un filtro ligero y ajustable antes de indexar ya no parece un lujo, sino una pieza bastante lógica del stack.

Preguntas frecuentes

¿Qué es OpenAI Privacy Filter y para qué sirve?

Es un modelo abierto de clasificación de tokens que detecta y enmascara información personal identificable en texto. Está pensado para usarse en pipelines de saneamiento de datos, revisión, indexación, logs y otros flujos donde conviene bloquear o redactar PII antes de que el texto siga avanzando.

¿Puede ejecutarse sin sacar los datos del equipo?

Sí. OpenAI lo presenta como un modelo que puede funcionar en local y que, por su tamaño, puede correr incluso en un navegador o en un portátil, de modo que el texto sensible no tenga que salir del dispositivo para ser filtrado.

¿Qué categorías de datos sensibles detecta?

Detecta ocho tipos de spans: account_number, private_address, private_email, private_person, private_phone, private_url, private_date y secret.

¿Sirve como anonimización completa o garantía de cumplimiento normativo?

No. OpenAI advierte expresamente que Privacy Filter no es una herramienta de anonimización, ni una certificación de cumplimiento, ni una garantía de seguridad. Debe usarse como una capa más dentro de una estrategia más amplia de privacidad y revisión.