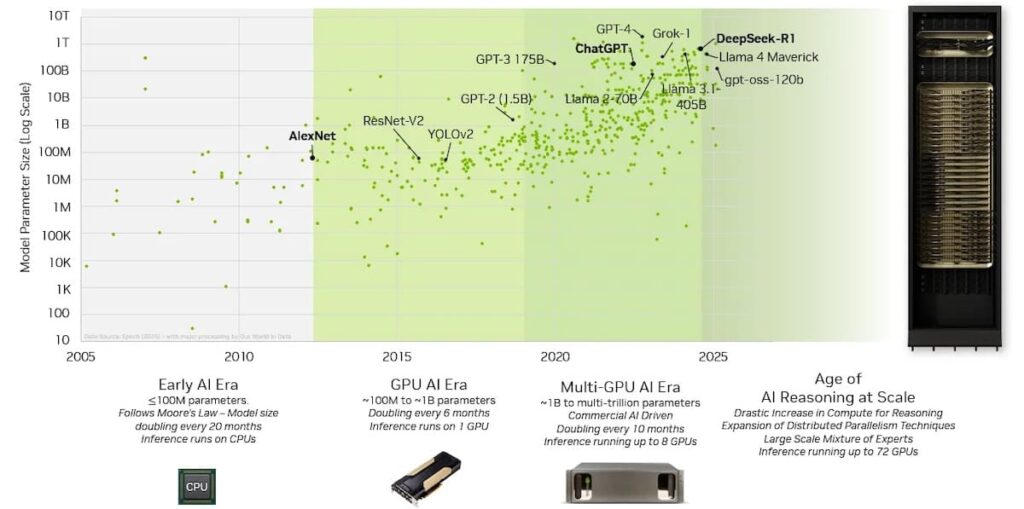

En menos de una década, el mundo de la inteligencia artificial ha pasado de entrenar modelos con decenas de millones de parámetros a trabajar con trillones. Esta escalada —alimentada por LLMs como GPT-4, Llama 3.1 o Claude Sonnet— no solo ha supuesto un reto algorítmico, sino también un desafío sin precedentes para la infraestructura. Los chips ya no son suficientes por sí solos: lo determinante es cómo se interconectan entre sí.

En este contexto, NVIDIA NVLink ha evolucionado hasta convertirse en la columna vertebral de las AI factories. Y con el lanzamiento de NVLink Fusion, la compañía da un paso más: abre el acceso a su tecnología de interconexión para que hiperescaladores, gobiernos y grandes corporaciones puedan construir superclústeres personalizados, con CPUs y XPUs integradas en el mismo tejido de comunicación que hoy potencia los racks NVL72 y NVL300.

De PCIe a NVLink: una década de revolución silenciosa

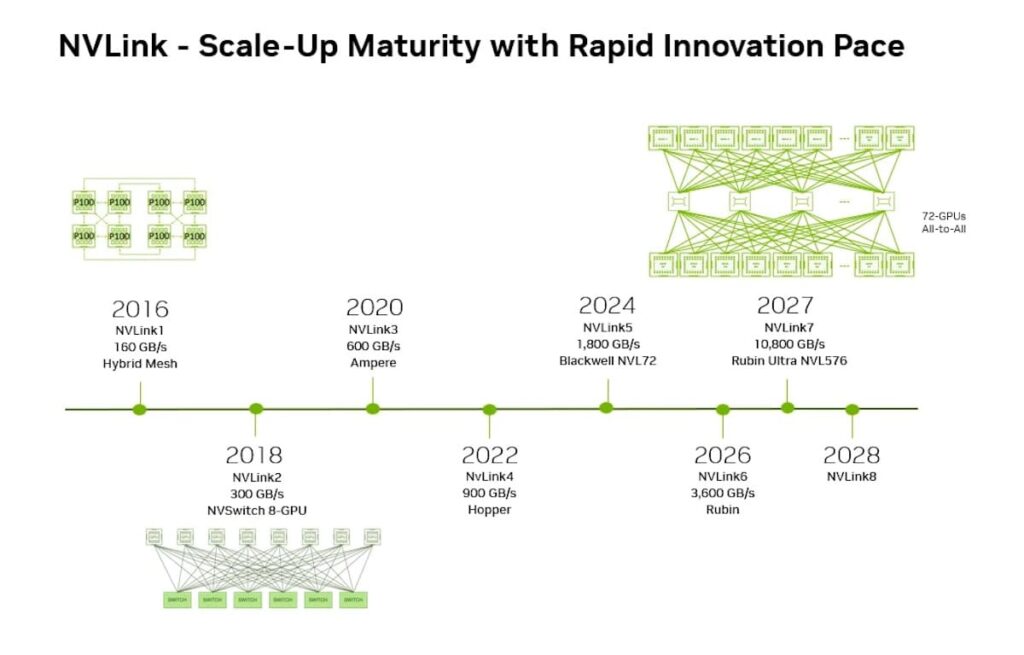

Cuando en 2016 NVIDIA presentó la primera generación de NVLink, el objetivo era superar las limitaciones de PCIe Gen3, que ya resultaba insuficiente para cargas de HPC y deep learning. Desde entonces, la evolución ha sido meteórica:

- NVLink 1 (2016): comunicación GPU-GPU más rápida que PCIe, con memoria unificada.

- NVLink Switch (2018): 300 GB/s en topologías de 8 GPUs, primer tejido de escala media.

- NVLink 3 y 4 (2020-2023): introducción del protocolo SHARP para operaciones colectivas, reducción de latencia en clústeres masivos.

- NVLink 5 (2024): soporte para 72 GPUs all-to-all con 1,8 TB/s por GPU y un ancho de banda agregado de 130 TB/s, casi 800 veces más que la primera generación.

Hoy, los racks NVL72 —base de los sistemas Blackwell GB200— marcan el estándar de facto en las fábricas de IA de exaescala.

El cuello de botella real: la inferencia

Aunque los titulares suelen centrarse en el coste del entrenamiento, los analistas coinciden en que el verdadero desafío económico está en la inferencia: servir resultados en tiempo real a millones de usuarios de ChatGPT, Gemini, Claude o Copilot.

Aquí la interconexión es crítica:

- Tiempo hasta el primer token (latencia).

- Tokens por segundo por usuario (throughput).

- Tokens por segundo por megavatio (eficiencia energética).

Los estudios internos de NVIDIA demuestran que:

- En un mesh de 4 GPUs, el rendimiento cae por la división de ancho de banda.

- En un 8-GPU con NVLink Switch, se logra all-to-all y el salto de eficiencia es notable.

- En un 72-GPU domain, el resultado es exponencial: throughput máximo y latencias mínimas, con un impacto directo en costes por inferencia y márgenes de rentabilidad.

En la práctica, cada microsegundo ahorrado en softmax o en transferencia de memoria se traduce en millones de dólares al año en ahorro energético o capacidad adicional de servicio.

NVLink Fusion: la apertura controlada de NVIDIA

Hasta ahora, estas capacidades estaban limitadas a la infraestructura diseñada por NVIDIA. Con NVLink Fusion, la compañía ofrece acceso a todo el stack de interconexión para integrarlo en sistemas semipersonalizados:

- Chiplets NVLink y SERDES.

- Switches y topologías rack-scale (NLV72 y NLV300).

- Ecosistema de refrigeración líquida y gestión energética.

- Soporte completo en software (CUDA, NCCL, Triton, TensorRT-LLM).

¿Qué cambia?

Los hiperescaladores podrán:

- Integrar CPUs personalizadas con GPUs NVIDIA usando NVLink-C2C, accediendo al ecosistema CUDA-X completo.

- Diseñar XPUs híbridas (aceleradores de propósito específico) con conectividad NVLink vía UCIe.

- Construir AI factories a medida, con racks modulares que mezclen GPUs, DPUs y procesadores diseñados internamente.

Esto supone un cambio profundo: no depender de un único diseño cerrado, sino poder co-diseñar infraestructura directamente con la tecnología de interconexión de NVIDIA.

Comparativa: NVLink vs PCIe vs alternativas

| Tecnología | Ancho de banda por GPU | Latencia | Escalabilidad | Uso típico |

|---|---|---|---|---|

| PCIe Gen6 | 256 GB/s | Alta | Limitada (host-device) | HPC, servidores estándar |

| NVLink 5 | 1,8 TB/s | Muy baja | Hasta 576 GPUs coherentes | AI factories, racks NVL72 |

| Infinity Fabric (AMD) | ~800 GB/s | Media | Limitada a clústeres MI | GPUs Instinct MI300 |

| CXL 3.0 | 512 GB/s | Media | Gran potencial (memoria compartida) | Memoria expandida, I/O |

La ventaja de NVLink no solo está en el ancho de banda, sino en su coherencia de memoria, que permite tratar un dominio de 72 GPUs como si fueran una sola entidad, reduciendo la complejidad de la programación.

Soberanía digital y geopolítica

La apertura parcial de NVLink con Fusion también tiene implicaciones geopolíticas. Europa, India y Oriente Medio llevan meses trabajando en proyectos de soberanía de IA, buscando alternativas a depender exclusivamente de infraestructura estadounidense.

Con NVLink Fusion, NVIDIA se asegura de:

- Mantener el control del ecosistema CUDA.

- Permitir personalizaciones soberanas (CPUs propias, racks integrados) sin perder la compatibilidad con sus librerías.

- Asegurar que los grandes contratos de IA soberana (como el de Indonesia con NVIDIA + Cisco + Indosat) se ejecuten con NVLink como estándar de facto.

El futuro: NVLink más allá de 72 GPUs

La hoja de ruta de NVIDIA es clara:

- NVLink 6, 7 y 8 ya están planificados, con lanzamientos anuales.

- Se espera superar el umbral de 1.000 GPUs en dominios coherentes antes de 2028.

- Se proyecta alcanzar ancho de banda de 3-5 TB/s por GPU, con interconexiones fotónicas en desarrollo.

- A largo plazo, la visión es que varias fábricas de IA distribuidas puedan operar como un único superclúster global, interconectado por NVLink y redes ópticas de baja latencia.

Conclusión

Con NVLink Fusion, NVIDIA no solo refuerza su dominio en interconexión GPU-GPU, sino que abre la puerta a un ecosistema más flexible, donde los grandes actores de la nube y los gobiernos pueden construir infraestructuras de IA personalizadas sin renunciar al estándar CUDA.

En la era donde la latencia por token define los ingresos de una aplicación de IA generativa, NVLink Fusion no es un lujo, es la llave maestra para mantener la competitividad en el negocio de la superinteligencia.

Preguntas frecuentes (FAQ)

¿Qué es NVIDIA NVLink Fusion?

Es un programa que abre la tecnología NVLink (chiplets, switches, racks, SERDES) para integrarla en CPUs y XPUs personalizadas, permitiendo construir infraestructuras de IA a medida.

¿Qué diferencia a NVLink de PCIe?

NVLink ofrece hasta 1,8 TB/s por GPU, coherencia de memoria y escalabilidad hasta 576 GPUs. PCIe Gen6 se limita a 256 GB/s y mayores latencias.

¿Por qué es clave para la inferencia de IA?

Porque permite clústeres con baja latencia y mayor throughput por vatio, reduciendo costes y mejorando tiempos de respuesta en servicios masivos como ChatGPT o Copilot.

¿Qué papel juega en la soberanía digital?

NVLink Fusion facilita que países y regiones construyan sus propias AI factories personalizadas, con CPUs nacionales o XPUs híbridas, manteniendo compatibilidad con CUDA.