La carrera por ejecutar modelos de Inteligencia Artificial cada vez más grandes ya no se libra solo en centros de datos. En el CES 2026, NVIDIA ha puesto el foco en un nuevo escenario: el escritorio del desarrollador. La compañía ha presentado NVIDIA DGX Spark y NVIDIA DGX Station, dos sistemas “deskside” concebidos para que equipos de ingeniería, investigación y ciencia de datos puedan probar, ajustar y ejecutar modelos avanzados de forma local, con la posibilidad de escalar después a la nube.

El movimiento responde a una realidad que se ha instalado en el sector: el software abierto acelera la innovación, pero los flujos de trabajo modernos —desde RAG (búsqueda y generación aumentada) hasta agentes y razonamiento multietapa— exigen memoria unificada, rendimiento sostenido y herramientas optimizadas. En ese contexto, NVIDIA plantea que DGX Spark y DGX Station actúen como una especie de “puente” entre el laboratorio personal y la infraestructura corporativa, reduciendo la fricción para trabajar con modelos cada vez más pesados sin depender siempre de racks remotos.

Dos máquinas, dos ligas: de los modelos abiertos al “frontier” local

La propuesta se divide en dos escalones muy claros. DGX Spark está orientado a un uso amplio: un sistema compacto, de enfoque “enchufar y listo”, preparado para ejecutar y afinar modelos de última hornada en el propio escritorio. DGX Station, en cambio, apunta a entornos donde se trabaja con cargas de frontera: laboratorios de investigación, grupos de ingeniería de rendimiento o empresas que necesitan experimentar con modelos a gran escala sin convertir cada iteración en una reserva de GPU en la nube.

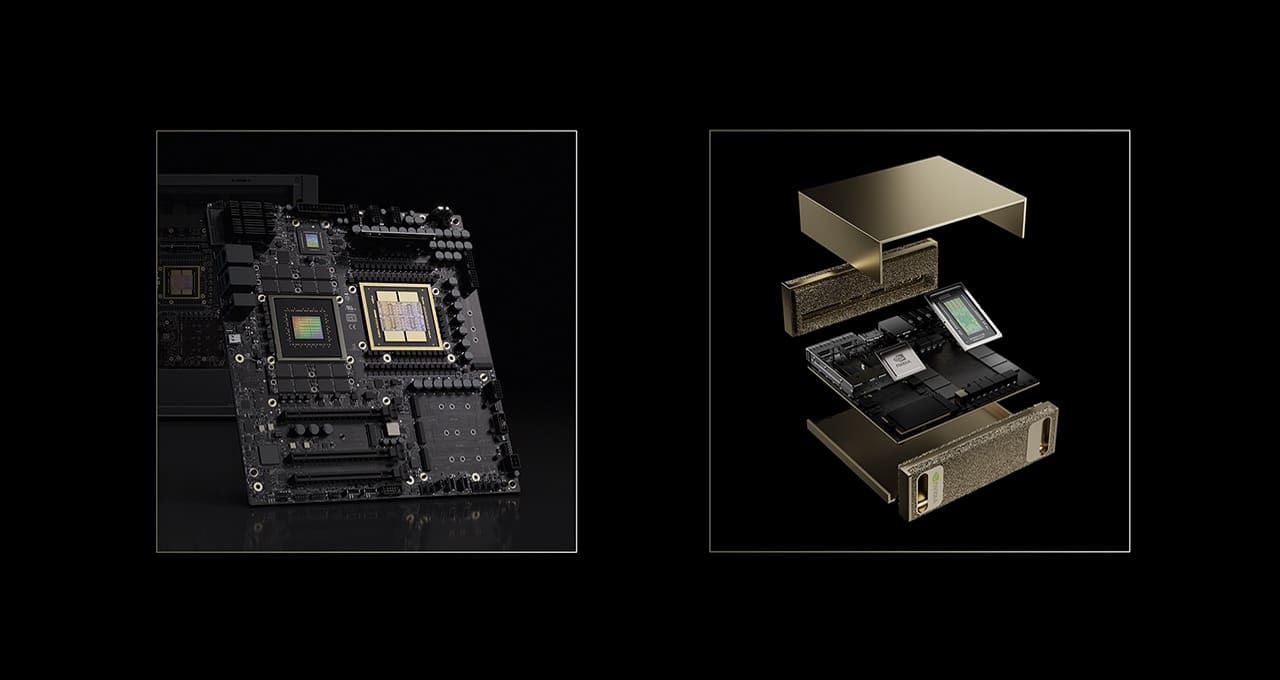

NVIDIA resume esa diferencia con un mensaje directo: DGX Spark permite trabajar con modelos del orden de los 100.000 millones de parámetros, mientras que DGX Station lleva el listón hasta modelos de 1 billón de parámetros en un sistema de formato deskside. La clave, según la compañía, es que ambos equipos se apoyan en Grace Blackwell, combinando memoria coherente y rendimiento en niveles pensados para la etapa actual de la IA: mucho contexto, más razonamiento y más presión por eficiencia.

DGX Spark: optimización “plug-and-play” y modelos grandes en un equipo de escritorio

DGX Spark se presenta como una máquina diseñada para que el desarrollador no tenga que empezar “desde cero”. Viene preconfigurada con el stack de software de NVIDIA y bibliotecas CUDA-X para acelerar tareas típicas de un flujo de IA: desde prototipado y ajuste fino, hasta inferencia y validación.

Un punto técnico que NVIDIA destaca es el papel del formato NVFP4, asociado a la arquitectura Blackwell. Según la compañía, este formato permite comprimir modelos hasta un 70 % y mejorar el rendimiento sin perder capacidad del modelo, un argumento especialmente relevante cuando el límite práctico en escritorio suele ser la memoria disponible y el coste de mover datos.

También hay un guiño claro a la comunidad: NVIDIA subraya su trabajo con proyectos como llama.cpp, que habría logrado una mejora media del 35 % en rendimiento al ejecutar modelos punteros en DGX Spark, además de mejoras de “calidad de vida” como acelerar los tiempos de carga de los LLM. La narrativa es significativa: no se trata solo de tener hardware rápido, sino de una combinación de optimización, formatos numéricos y ecosistema open source para acercar modelos que antes pedían un centro de datos a un equipo de sobremesa.

En paralelo, la propia plataforma de producto de NVIDIA sitúa a DGX Spark en un rango aún más ambicioso: habla de hasta 128 GB de memoria unificada y capacidad para trabajar localmente con modelos de hasta 200.000 millones de parámetros, con escenarios como ajuste fino y pruebas de inferencia orientados a desarrollo y validación.

DGX Station: el “GB300” sale del rack y aterriza en el despacho

Si DGX Spark intenta democratizar el acceso a modelos grandes, DGX Station busca cambiar el día a día de quienes desarrollan infraestructura y frameworks. NVIDIA afirma que DGX Station está construido con el GB300 Grace Blackwell Ultra y cuenta con 775 GB de memoria coherente, un detalle que explica por qué la compañía lo posiciona como capaz de mover modelos del orden del billón de parámetros en un sistema local.

Más allá de la cifra, el valor está en el uso: desarrolladores de runtimes y motores de inferencia suelen vivir en un ciclo de iteración lento, condicionado por la disponibilidad de hardware. En el anuncio aparecen voces de referencia en el ecosistema: desde el mantenimiento de vLLM, que apunta a lo difícil que es probar y optimizar directamente para GB300 cuando ese chip se despliega normalmente en entornos rack-scale, hasta contribuciones de SGLang que describen la ventaja de poder trabajar localmente con modelos muy grandes y configuraciones exigentes sin depender de “racks en la nube”.

NVIDIA enumera ejemplos de modelos que encajan con este enfoque —incluyendo nombres recientes de la escena “frontier” y open-weight— y sitúa DGX Station como una herramienta para acortar el bucle: probar cambios, ajustar kernels CUDA, validar rendimiento y volver a iterar, todo sin salir del laboratorio.

Demostraciones: velocidad, visualización masiva y agentes “con cuerpo”

En el CES, NVIDIA ha mostrado DGX Station en directo con demostraciones pensadas para impresionar tanto por volumen como por ritmo. Entre ellas, la compañía cita un preentrenamiento que alcanzaría 250.000 tokens por segundo, además de flujos de visualización con millones de puntos y la creación/visualización de grandes bases de conocimiento mediante “Text to Knowledge Graph”. No son casos de uso casuales: están diseñados para transmitir una idea concreta, la de un escritorio capaz de sostener cargas que hasta hace poco se asociaban a un CPD.

DGX Spark, por su parte, se presenta como una pieza práctica para producción creativa y prototipado. NVIDIA señala que modelos de difusión y generación de vídeo —incluyendo propuestas de Black Forest Labs o Alibaba— ya soportan NVFP4, reduciendo el consumo de memoria y acelerando su ejecución. En esa misma línea, la compañía afirma que DGX Spark puede descargar cargas de generación de vídeo que saturan portátiles de creadores y que, en una demo, habría logrado una aceleración de 8 veces frente a un MacBook Pro con M4 Max en un escenario de vídeo generativo.

Hay también una apuesta por mantener datos y código “en casa”: NVIDIA enseña un asistente local para programación CUDA apoyado en NVIDIA Nsight ejecutándose en DGX Spark, buscando atraer a empresas que quieren productividad sin sacar su repositorio a servicios externos.

La parte más “CES” del anuncio llega con una demostración junto a Hugging Face: la combinación de DGX Spark con el robot Reachy Mini para construir un agente interactivo —con visión, voz y respuesta motora—, acompañada de una guía paso a paso publicada por Hugging Face. Es una imagen potente: el agente deja de ser una pestaña del navegador para convertirse en algo tangible sobre la mesa.

Ecosistema, disponibilidad y el mensaje de fondo: IA local, sin renunciar a escalar

La lista de socios que comercializarán estos sistemas refuerza la intención de NVIDIA de convertirlos en categoría. Según la compañía, DGX Spark y sistemas asociados están disponibles a través de fabricantes y partners como Acer, Amazon, ASUS, Dell, GIGABYTE, HP, Lenovo, Micro Center, MSI y PNY. En cuanto a DGX Station, NVIDIA indica disponibilidad a partir de primavera de 2026 con socios como ASUS, Boxx, Dell, GIGABYTE, HP, MSI y Supermicro.

A nivel de software, NVIDIA añade una pieza comercial clave: NVIDIA AI Enterprise amplía soporte para DGX Spark y sistemas GB10 de partners, y las licencias se esperan para finales de enero, apuntalando el argumento corporativo de soporte, drivers, operadores y despliegue fiable.

El mensaje de fondo es claro: la IA se ha vuelto demasiado importante —y demasiado costosa— como para depender de un único modo de consumo. NVIDIA está empujando una visión híbrida: desarrollo local y seguro cuando importa el control, la iteración y la IP; y escalado al centro de datos o a la nube cuando llega el momento de entrenar, servir o producir a gran escala.

Preguntas frecuentes

¿Qué diferencia hay entre NVIDIA DGX Spark y DGX Station para ejecutar modelos de lenguaje en local?

DGX Spark se orienta a desarrollo y pruebas con modelos grandes en formato compacto y “plug-and-play”, mientras que DGX Station se posiciona para cargas de frontera y modelos de hasta 1 billón de parámetros, con un enfoque más cercano a laboratorio y empresa.

¿Qué significa que DGX Spark use NVFP4 y por qué importa en la IA de escritorio?

NVFP4 es un formato que NVIDIA utiliza para reducir el tamaño efectivo de los modelos y aumentar el rendimiento. La compañía asegura que puede comprimir modelos hasta un 70 %, lo que ayuda a ejecutar modelos más grandes con menos huella de memoria.

¿DGX Station puede sustituir a un cluster de GPU para investigación de modelos de frontera?

No pretende reemplazar un gran cluster, pero sí cubrir una necesidad crítica: acortar el ciclo de iteración y validar optimizaciones localmente con hardware de clase centro de datos, antes de escalar a infraestructura masiva.

¿Qué casos de uso reales habilitan DGX Spark y DGX Station en empresas que quieren mantener datos y código en local?

La propuesta se centra en inferencia local, flujos RAG, ajuste fino, prototipado de agentes y herramientas de desarrollo (por ejemplo, asistentes de programación CUDA), con la ventaja de mantener datos e IP bajo control y escalar después a cloud si hace falta.

vía: blogs.nvidia