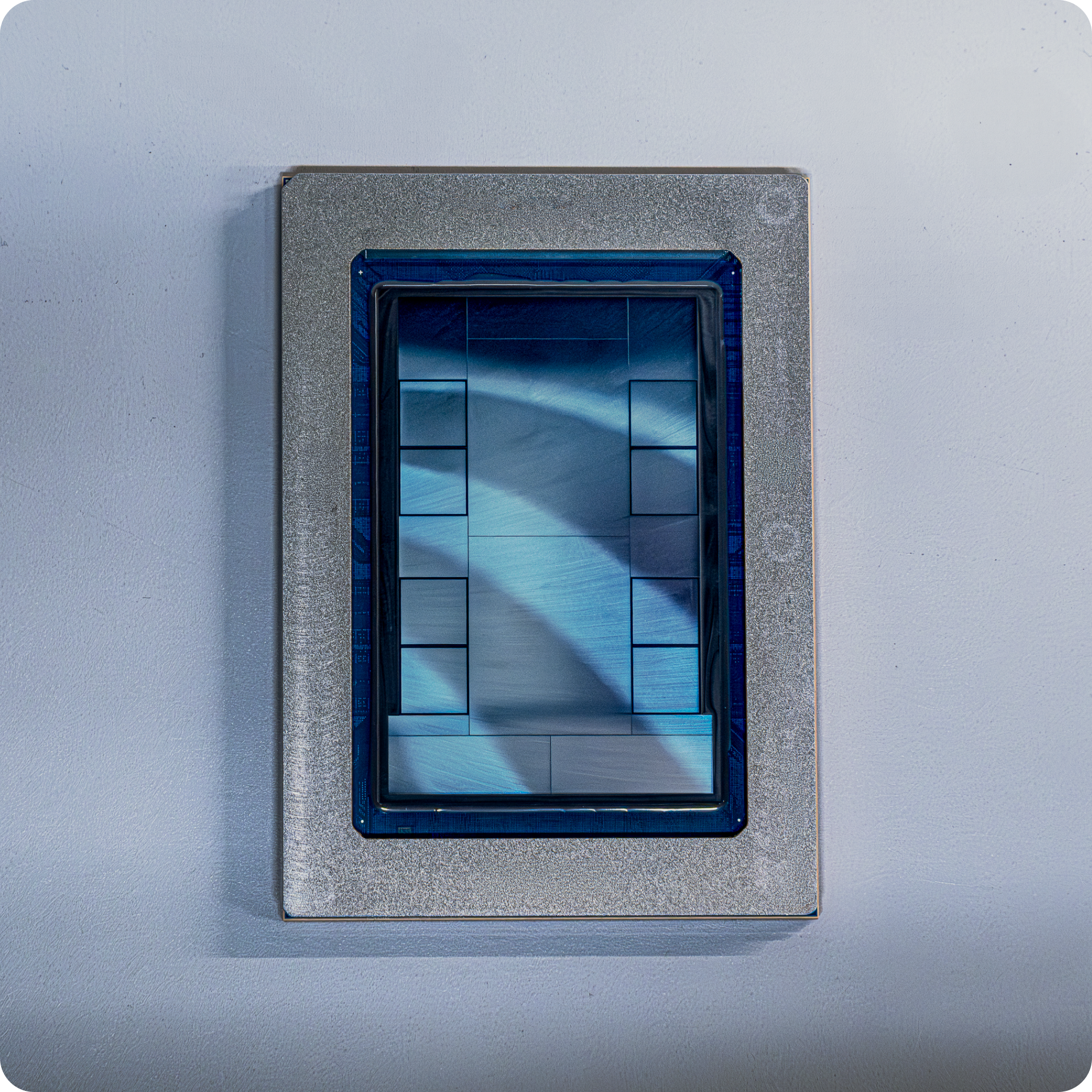

Meta ha decidido pisar el acelerador con su familia de aceleradores propios MTIA y, con ello, reforzar una tendencia que ya se ve con claridad entre los grandes hiperescalares: depender menos de una sola arquitectura GPU para la inferencia de IA. En una entrada técnica publicada por la compañía, Meta detalla cuatro nuevas generaciones de su línea Meta Training and Inference Accelerator —MTIA 300, 400, 450 y 500— con despliegues ya iniciados o previstos entre 2026 y 2027, y con un mensaje central muy claro: la inferencia de IA necesita chips optimizados de forma distinta a los diseñados principalmente para el entrenamiento.

La tesis de Meta encaja con un movimiento más amplio del sector. Google ya presentó Ironwood como su primera TPU diseñada específicamente para la “era de la inferencia”, AWS sigue empujando sus familias Trainium e Inferentia, y Microsoft ha situado Maia 200 como su nuevo acelerador propio para cargas de inferencia. No se trata todavía de un relevo total de Nvidia, pero sí de una diversificación cada vez más visible en la capa de silicio donde los costes por token y la eficiencia energética empiezan a importar tanto como la potencia bruta.

Meta explica que su familia MTIA, desarrollada “en estrecha colaboración con Broadcom”, seguirá siendo una pieza importante de su estrategia de infraestructura de IA, junto a otras soluciones internas y externas. La compañía asegura haber desplegado ya cientos de miles de chips MTIA en producción y haber validado estos aceleradores con modelos internos y con LLMs como Llama. Esa base es la que ahora le permite avanzar hacia una hoja de ruta más agresiva y con un ritmo de iteración mucho más corto que el habitual en la industria.

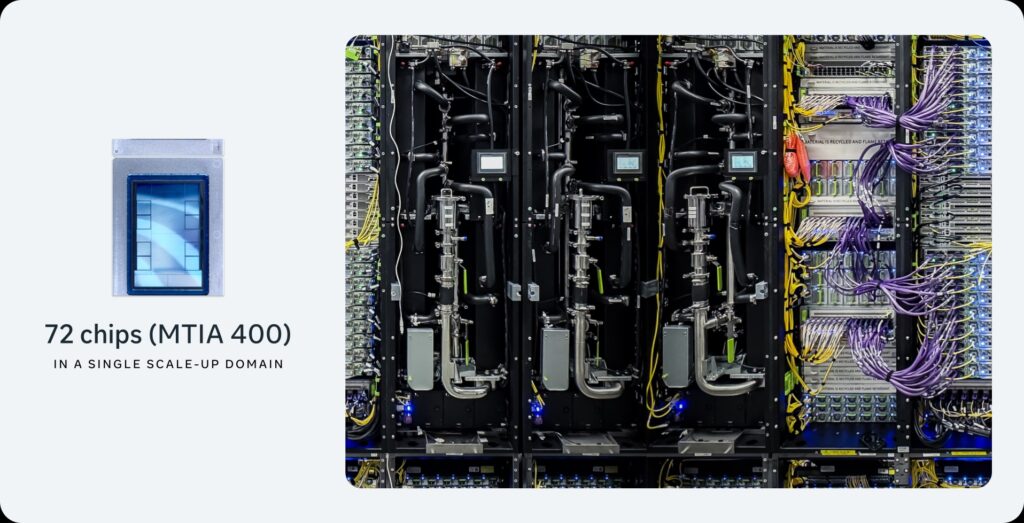

Lo más llamativo del anuncio no es solo el número de generaciones, sino el enfoque. Meta sostiene que desde MTIA 300 hasta MTIA 500 el ancho de banda de HBM aumenta 4,5 veces y la capacidad de cálculo se multiplica por 25, todo ello en menos de dos años. Según su hoja de ruta, MTIA 300 ya está en producción para entrenamiento de modelos de ranking y recomendación; MTIA 400 ha completado pruebas en laboratorio y va camino del despliegue en centros de datos; MTIA 450 entrará en despliegue masivo a principios de 2027; y MTIA 500 llegará más adelante ese mismo año.

La inferencia como nuevo campo de batalla

El argumento técnico de Meta gira alrededor de una idea muy concreta: en inferencia generativa, el cuello de botella ya no está siempre en la misma parte del sistema que en el entrenamiento. La empresa insiste en que el ancho de banda de la memoria HBM es uno de los factores más decisivos para el rendimiento en inferencia, especialmente en fases como el decode. Por eso afirma que MTIA 450 duplica el ancho de banda HBM respecto a MTIA 400 y que MTIA 500 vuelve a aumentarlo en otro 50 %, además de elevar capacidad y rendimiento con formatos de baja precisión orientados a inferencia.

La consecuencia estratégica es relevante. Durante años, las GPUs han sido el estándar casi universal para entrenar y servir modelos. Pero los hiperescalares empiezan a asumir que usar siempre el mismo tipo de hardware para todo no es necesariamente la opción más eficiente, sobre todo cuando la inferencia se convierte en la mayor parte del consumo total de cómputo. Ahí es donde Meta, Google, AWS y Microsoft parecen estar convergiendo: chips propios para cargas previsibles y de gran volumen, mientras las GPUs siguen dominando el entrenamiento frontier y los usos más generalistas.

Google ya lo verbalizó de forma bastante explícita con Ironwood, al describirlo como su séptima generación de TPU y la primera pensada específicamente para inferencia, con 192 GB de HBM3E, 7,37 TB/s de ancho de banda y escalado hasta 9.216 aceleradores. AWS, por su parte, presenta Trainium3 con 144 GB de HBM3E y 4,9 TB/s por chip, además de sistemas UltraServer con hasta 144 chips conectados. Microsoft, en enero de 2026, situó Maia 200 como un acelerador para inferencia fabricado en 3 nm, con 216 GB de HBM3E, 7 TB/s de ancho de banda y una mejora del 30 % en rendimiento por dólar frente a sistemas previos de su propia flota.

Menos dependencia de Nvidia, pero no ruptura

Eso no significa que Nvidia pierda mañana su posición central. De hecho, ni siquiera Meta plantea algo parecido. La propia compañía insiste en que seguirá usando un portfolio diverso de silicio interno y externo, y el mercado sigue reconociendo que el entrenamiento de modelos frontier y buena parte de la infraestructura de gran escala continúan muy ligados a las plataformas GPU de Nvidia. Lo que sí cambia es la fotografía del equilibrio interno dentro de cada hiperescalar: si el entrenamiento sigue en gran medida bajo dominio de GPU, la inferencia empieza a migrar a aceleradores especializados donde el coste operativo puede afinarse mejor.

Hay otro detalle importante en el caso de Meta: la velocidad. La compañía dice haber construido una capacidad para lanzar una nueva generación de chip aproximadamente cada seis meses, apoyándose en una arquitectura modular de chiplets y en la reutilización del mismo chasis, rack e infraestructura de red entre varias generaciones. Esa compatibilidad física permitiría insertar nuevos chips sin rediseñar por completo el entorno de despliegue, algo clave si de verdad quiere acortar ciclos frente a los procesos de uno o dos años que suelen dominar el sector.

También hay una apuesta fuerte por el software abierto y por la adopción sin fricción. Meta sitúa a PyTorch, vLLM, Triton y el ecosistema OCP como base nativa de MTIA. Eso es relevante porque la guerra del silicio no se decide solo en el chip: también depende de lo fácil que resulte portar modelos, kernels y flujos de inferencia entre plataformas. Cuanto más interoperable sea el stack, más creíble será para los hiperescalares la idea de desenganchar parte de su volumen de trabajo del ecosistema CUDA.

Broadcom gana peso en la trastienda

En toda esta carrera hay un actor que cada vez aparece más en segundo plano pero con un papel decisivo: Broadcom. Meta la menciona como socio estrecho en el desarrollo de MTIA, y OpenAI anunció en octubre de 2025 una colaboración con Broadcom para desplegar 10 GW de aceleradores de IA personalizados. Aunque cada programa tenga sus particularidades, ese tipo de alianzas refleja hasta qué punto el diseño de silicio a medida se ha convertido en una prioridad estratégica y en una inversión solo al alcance de compañías con una enorme escala de capital y despliegue.

La conclusión, por tanto, no es que Nvidia haya perdido el control del mercado, sino que la industria ya está trabajando activamente para no depender de ella en todos los casos de uso. Meta, con esta nueva familia MTIA, se alinea con una lógica que ya comparten otros gigantes: entrenar donde tiene sentido entrenar con GPUs, pero servir inferencia masiva con silicio propio cuando la economía del sistema lo justifica. Si la inferencia acaba siendo el gran motor del consumo de IA en los próximos años, esa decisión puede tener mucho más peso del que parece hoy.

Preguntas frecuentes

¿Qué ha anunciado exactamente Meta con MTIA?

Meta ha detallado cuatro generaciones de aceleradores propios —MTIA 300, 400, 450 y 500— con despliegues en producción o previstos entre 2026 y 2027, centrados cada vez más en cargas de inferencia de IA.

¿Por qué Meta insiste tanto en el ancho de banda HBM?

Porque, según la compañía, el ancho de banda de la memoria HBM es uno de los factores más importantes para el rendimiento de inferencia generativa, especialmente en el decode. Por eso aumenta de forma fuerte entre MTIA 400, 450 y 500.

¿Esto significa que Nvidia deja de ser importante para los hiperescalares?

No. El movimiento apunta más a una segmentación de cargas: chips propios para inferencia a gran escala y GPUs todavía muy dominantes en entrenamiento y otros usos generalistas.

¿Qué otros hiperescalares están siguiendo esta estrategia?

Google con Ironwood TPU, AWS con Trainium3 e Inferentia, y Microsoft con Maia 200 también están reforzando sus programas de silicio propio orientados a IA e inferencia.

vía: ai.meta.com