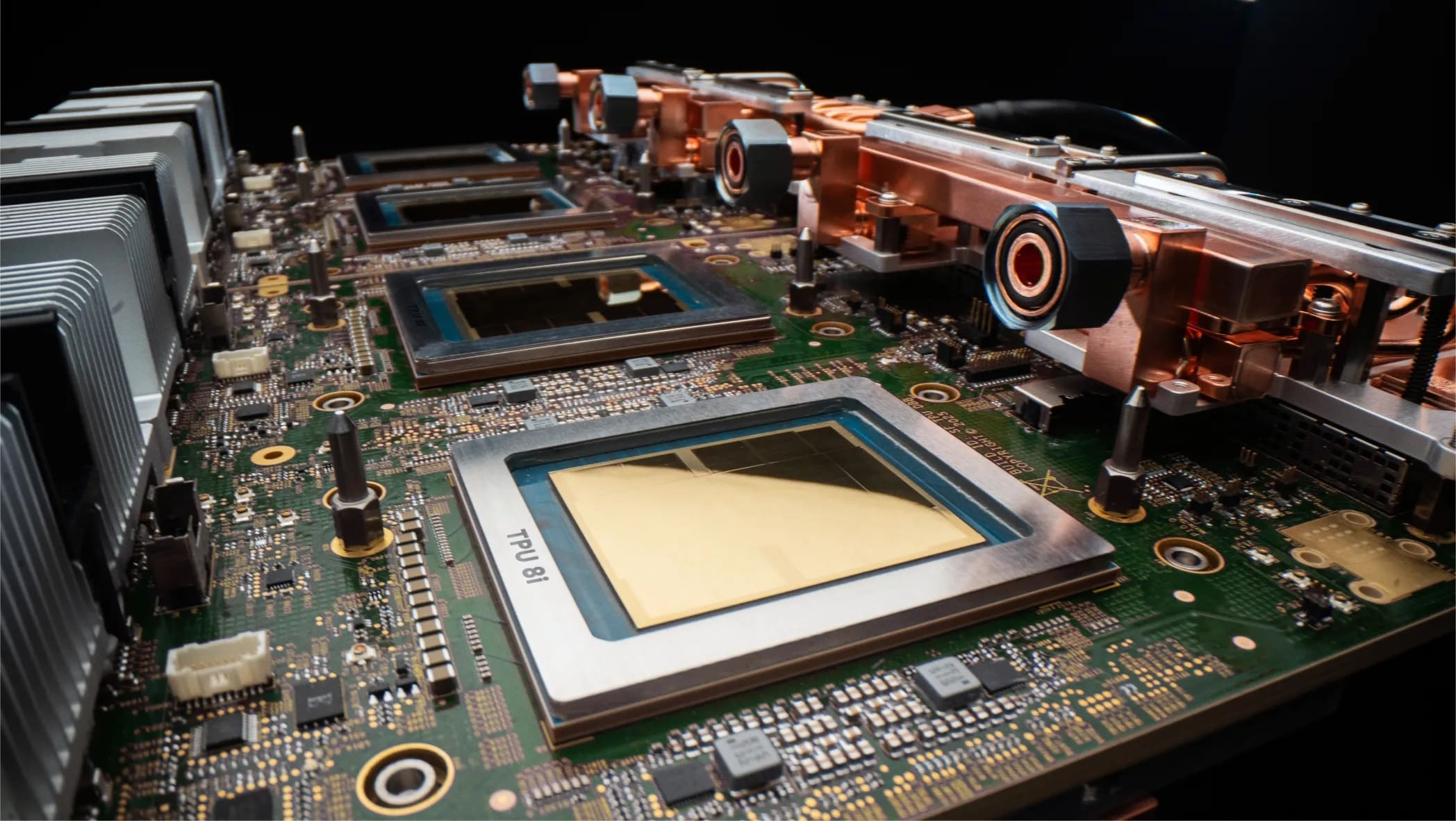

Google ha presentado la octava generación de sus Tensor Processing Units (TPU) y, por primera vez, ha dividido claramente su estrategia en dos chips distintos: TPU 8t, orientado al entrenamiento de modelos, y TPU 8i, diseñado para inferencia de baja latencia. La compañía los sitúa como su respuesta a una nueva etapa de la Inteligencia Artificial, marcada por agentes que ya no solo responden preguntas, sino que razonan, encadenan pasos, aprenden de sus acciones y ejecutan flujos complejos en tiempo real.

El mensaje de Google es claro: la IA agéntica ya no encaja bien en una infraestructura genérica. Por eso ha optado por dos arquitecturas “purpose-built”, es decir, especializadas desde el diseño para cargas muy diferentes. TPU 8t se centra en reducir el ciclo de desarrollo de grandes modelos, mientras que TPU 8i apunta a servir inferencia a gran escala con más eficiencia y menos latencia. Ambos chips estarán disponibles de forma general más adelante este año dentro de Google Cloud y formarán parte de su plataforma AI Hypercomputer.

No se trata solo de una actualización de catálogo. Google intenta reforzar una idea que lleva años repitiendo: que el futuro de la IA no depende únicamente del chip, sino de la integración entre silicio, red, almacenamiento, software, refrigeración y centros de datos. En esa línea, TPU 8t y TPU 8i correrán por primera vez sobre los procesadores Axion, los CPU Arm propios de Google, y mantendrán la apuesta por la refrigeración líquida y la optimización energética a escala de sistema.

Dos TPU para dos problemas distintos

La decisión de separar entrenamiento e inferencia responde a un cambio profundo en el mercado. Hace unos años, gran parte del esfuerzo se concentraba en entrenar modelos fundacionales cada vez más grandes. Ahora, además, hay que servir esos modelos en producción, atender millones de consultas, mantener contextos largos y coordinar agentes especializados que colaboran entre sí. Google sostiene que estas cargas tienen necesidades tan distintas que ya no compensa tratarlas con el mismo tipo de hardware.

TPU 8t es la pieza más orientada a entrenamiento masivo. Google asegura que un único superpod puede escalar hasta 9.600 chips, con dos petabytes de memoria HBM compartida y el doble de ancho de banda entre chips que la generación anterior. La compañía cifra su capacidad en 121 exaflops de cómputo y afirma que el sistema ofrece casi tres veces más rendimiento por pod que la generación previa. También añade acceso a almacenamiento 10 veces más rápido y un objetivo de más del 97 % de goodput, es decir, tiempo de cómputo realmente útil y no desperdiciado en fallos, esperas o reinicios.

TPU 8i, por su parte, está pensado para inferencia, post-entrenamiento y razonamiento. Aquí Google ha priorizado la memoria y la latencia. Cada chip integra 288 GB de HBM y 384 MB de SRAM on-chip, tres veces más que en la generación anterior, y se apoya en una nueva topología de interconexión llamada Boardfly. Esa arquitectura permite conectar hasta 1.152 chips en un pod y reducir el diámetro máximo de red de 16 a 7 saltos, algo clave para modelos Mixture of Experts (MoE) y cargas donde la coordinación entre agentes y expertos especializados puede convertirse en cuello de botella. Google asegura que TPU 8i ofrece una mejora de hasta un 80 % en rendimiento por dólar frente a Ironwood.

Una carrera que ya no se gana solo con más FLOPS

Más allá de las cifras, el anuncio deja una lectura bastante clara: la batalla del hardware para IA se está desplazando desde el chip aislado hacia el sistema completo. Google insiste en que ha diseñado TPU 8t y TPU 8i junto a Google DeepMind, con especificaciones derivadas de las necesidades reales de los modelos actuales. La topología Boardfly, por ejemplo, se ha pensado para las exigencias de comunicación de los modelos de razonamiento; la SRAM de TPU 8i, para alojar mejor el KV cache en producción; y la red Virgo, para las demandas de paralelismo de entrenamientos de modelos con billones de parámetros.

Google también intenta convertir la eficiencia energética en parte del argumento comercial. Según la compañía, TPU 8t y TPU 8i entregan hasta dos veces más rendimiento por vatio que Ironwood, apoyados además en una cuarta generación de refrigeración líquida. A eso suma integración entre conectividad y cómputo en el mismo chip y una optimización global que, según la empresa, ha permitido a sus centros de datos ofrecer seis veces más potencia de cómputo por unidad de electricidad que hace cinco años.

Ese enfoque no es casual. La IA está chocando ya con límites muy físicos: energía, refrigeración, densidad y coste operativo. En ese contexto, vender solo más potencia de cálculo ya no basta. Google quiere transmitir que su ventaja está en controlar toda la pila, desde el CPU host hasta la red, pasando por el software y el diseño del centro de datos.

Tabla comparativa: así se reparten TPU 8t y TPU 8i

| Característica | TPU 8t | TPU 8i |

|---|---|---|

| Enfoque principal | Entrenamiento a gran escala | Inferencia, serving y razonamiento |

| Escala máxima por sistema | 9.600 chips por superpod | 1.152 chips por pod |

| Memoria HBM por chip | 216 GB | 288 GB |

| SRAM on-chip | 128 MB | 384 MB |

| Topología de red | 3D torus | Boardfly |

| Rendimiento destacado | 121 exaflops por superpod | +80 % rendimiento por dólar frente a Ironwood |

| Mejora clave | ~3x más rendimiento por pod | Menor latencia y mejor eficiencia en inferencia |

Datos de Google Cloud y Google Blog.

Un mensaje también para Nvidia

Aunque Google no plantea el anuncio como un ataque frontal a Nvidia, el trasfondo competitivo es evidente. TechCrunch y otros medios estadounidenses destacan que esta octava generación de TPU refuerza la posición de Google Cloud en una carrera donde Nvidia sigue dominando gran parte del mercado de aceleradores para IA. La diferencia es que Google lleva años desplegando TPU en sus propios servicios, incluidos modelos como Gemini, y ahora quiere convertir esa experiencia interna en una propuesta más agresiva para clientes cloud.

Eso sí, Google no está vendiendo un mundo cerrado. La compañía remarca que ambos sistemas soportan de forma nativa JAX, PyTorch, SGLang y vLLM, además de acceso bare metal, para reducir la fricción a la hora de desplegar modelos y cargas ya existentes. En paralelo, insiste en que TPU 8t y TPU 8i no son solo chips, sino piezas de una oferta más amplia donde también entran almacenamiento, red, software y modelos de consumo flexibles dentro de AI Hypercomputer.

Preguntas frecuentes

¿Qué ha presentado exactamente Google?

Google ha anunciado su octava generación de TPU con dos chips diferenciados: TPU 8t para entrenamiento de modelos y TPU 8i para inferencia, serving y cargas de razonamiento.

¿Cuál es la principal diferencia entre TPU 8t y TPU 8i?

TPU 8t está optimizado para entrenamiento masivo y escala hasta 9.600 chips por superpod, mientras TPU 8i prioriza memoria, latencia y eficiencia en inferencia con hasta 1.152 chips por pod.

¿Cuándo estarán disponibles?

Google ha indicado que ambos chips estarán disponibles de forma general más adelante este año en Google Cloud.

¿Por qué Google habla de la “era de los agentes”?

Porque, según la compañía, los nuevos modelos ya no solo responden, sino que ejecutan flujos multietapa, razonan, colaboran entre sí y trabajan con contextos largos, lo que exige una infraestructura distinta para entrenamiento e inferencia.

vía: blog.google