Un crecimiento exponencial de los intentos de fraude con deepfakes

En los últimos tres años, los intentos de fraude con deepfakes han aumentado en un 2137%, representando el 6.5% del total de fraudes detectados en el sector financiero. Así lo revela el informe The Battle Against AI-Driven Identity Fraud de Signicat, que alerta sobre los nuevos desafíos en seguridad derivados de los avances en inteligencia artificial (IA).

El estudio, basado en encuestas a más de 1200 expertos en fraude de entidades financieras en siete países europeos, señala que el suplantación de identidad mediante deepfakes es ahora una de las principales formas de fraude digital, superando métodos tradicionales como el phishing y el fraude en pagos con tarjeta.

Dos tipos de ataques con deepfakes

El desarrollo de la tecnología deepfake ha permitido a los ciberdelincuentes emplear dos tipos principales de ataques:

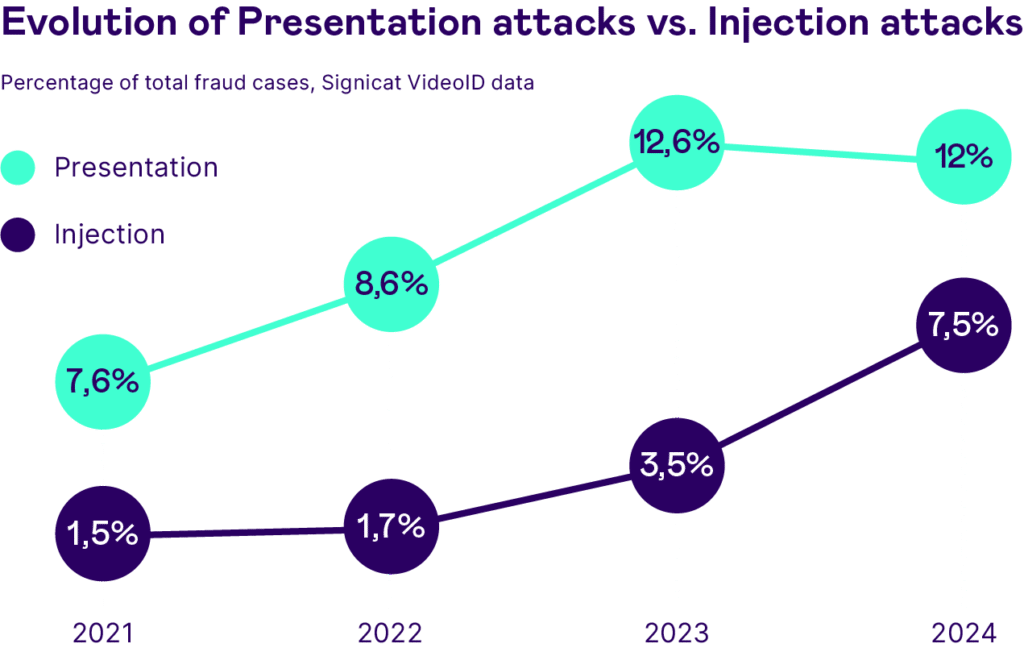

- Ataques de presentación: incluyen el uso de máscaras, maquillaje o la proyección de un deepfake en tiempo real para suplantar a una persona. Se utilizan en fraudes como la toma de control de cuentas o solicitudes de préstamos fraudulentas.

- Ataques de inyección: implican la introducción de videos pregrabados o datos alterados en los sistemas de verificación, afectando procesos de onboarding, autenticación KYC y validación de identidad en bancos y fintechs.

Una amenaza creciente en el fraude financiero

Los deepfakes han pasado de ser una tecnología emergente a un método sofisticado de fraude. Según el informe, el 42.5% de los intentos de fraude en el sector financiero ya están impulsados por IA. En solo tres años, el fraude con deepfakes ha pasado de ser un fenómeno marginal a convertirse en la forma más común de fraude de identidad digital.

Deficiencias en los sistemas de detección

A pesar del aumento de ataques con IA, solo el 22% de las instituciones financieras han implementado herramientas avanzadas de prevención de fraudes basadas en IA. Este retraso deja expuestos a muchos actores del sector a técnicas que los sistemas tradicionales de detección no pueden identificar con precisión.

Pinar Alpay, Chief Product & Marketing Officer en Signicat, advierte: «Hace tres años, los ataques con deepfakes representaban solo el 0.1% de los fraudes detectados. Hoy en día, suponen 1 de cada 15 casos, lo que evidencia una evolución alarmante de las técnicas empleadas por los ciberdelincuentes. Para protegerse, las empresas deben combinar evaluación temprana de riesgos, verificación de identidad robusta y autenticación basada en biometría facial».

El futuro de la lucha contra el fraude con IA

Para mitigar esta creciente amenaza, los expertos recomiendan adoptar un enfoque de seguridad multicapa, que combine:

- Sistemas de detección basados en IA para identificar patrones sospechosos.

- Biometría avanzada para validar la identidad de los usuarios.

- Monitoreo continuo y herramientas de análisis en tiempo real.

- Educación y concienciación para clientes y empleados sobre los riesgos de fraude digital.

El informe de Signicat subraya la urgencia de que las instituciones financieras modernicen sus sistemas de prevención de fraudes para hacer frente a una amenaza que evoluciona a un ritmo sin precedentes. Con la inteligencia artificial impulsando el fraude a una escala industrial, la industria financiera se enfrenta a un desafío crítico que requiere medidas inmediatas y estrategias innovadoras para garantizar la seguridad digital.

Fuente: Significat