La inteligencia artificial ha cambiado nuestra forma de trabajar, comunicarnos y hasta de aprender. Pero detrás de cada avance tecnológico late un debate cada vez más candente: ¿qué ocurre con los datos de los usuarios?. Ahora es Anthropic, la empresa creadora de Claude AI, quien se encuentra en el centro de la polémica tras anunciar un cambio en sus políticas de privacidad y términos de servicio.

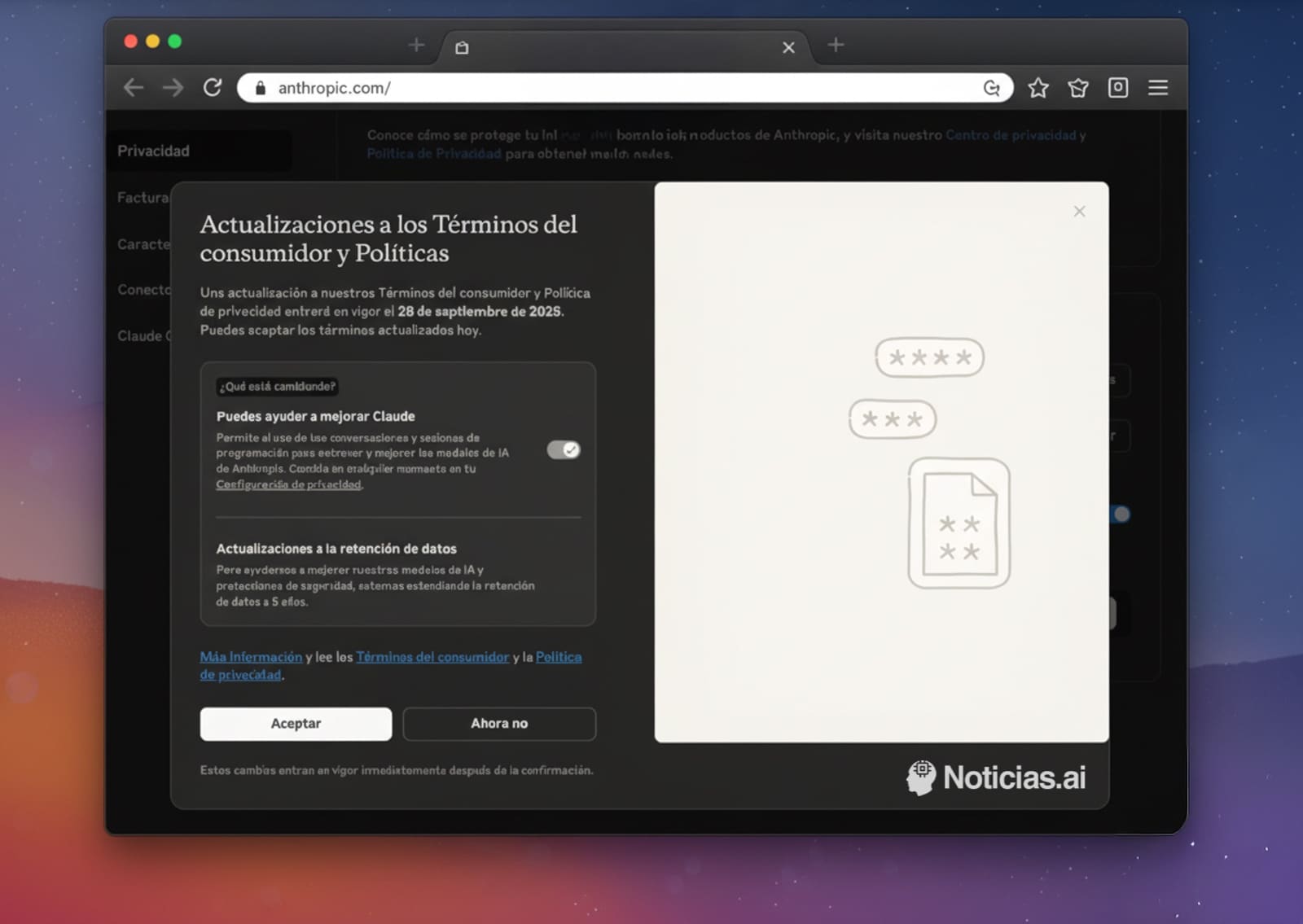

A partir del 28 de septiembre de 2025, todas las conversaciones con Claude podrán ser utilizadas para entrenar sus modelos de IA. Y lo serán por defecto, salvo que los usuarios desactiven manualmente la opción en los ajustes de privacidad.

De la promesa de privacidad al giro de estrategia

Hasta ahora, Anthropic se había diferenciado de otras grandes compañías como OpenAI o Google por prometer que Claude AI no utilizaba las interacciones de sus usuarios como materia prima de entrenamiento. Esa promesa se ha roto.

La empresa argumenta que el cambio busca “reforzar las defensas” contra abusos, fraudes y generación de contenido dañino, al tiempo que mejora la calidad y seguridad de los modelos. Pero la forma de implementarlo —un sistema opt-out en el que el usuario debe excluirse manualmente— despierta recelos.

Cómo funciona la exclusión voluntaria

El nuevo proceso es sencillo pero poco visible. Los usuarios deben entrar en la página de ajustes de privacidad y desmarcar la casilla “You can help improve Claude”, que aparece activada por defecto.

Quien no lo haga, verá cómo sus datos quedan registrados y disponibles para Anthropic durante un periodo de hasta cinco años. Este plazo de retención, inusualmente largo, ha sido uno de los aspectos más criticados por especialistas en privacidad digital.

A quién afectan los cambios

La nueva política se aplica a los planes Claude Free, Pro y Max. Solo quedan fuera los servicios empresariales y bajo contrato comercial, como Claude for Work, Claude Gov, Claude for Education o las integraciones vía API en plataformas de terceros, entre ellas Amazon Bedrock y Google Cloud Vertex AI.

En la práctica, millones de usuarios individuales y profesionales se verán afectados, salvo que opten expresamente por excluirse.

¿Un paso atrás en la protección de datos?

El movimiento de Anthropic recuerda a lo sucedido con otras tecnológicas que introdujeron cambios similares bajo el paraguas de la seguridad. Google y Microsoft han sido acusadas de “colar” funciones de IA en sus servicios con un enfoque parecido, en el que el consentimiento activo brilla por su ausencia.

El problema, según expertos en derecho digital, no es que las empresas mejoren sus modelos, sino que lo hagan a costa de la privacidad y autonomía de los usuarios. “Los sistemas opt-out se basan en la inacción del usuario medio, que no lee la letra pequeña o no tiene conocimientos técnicos suficientes para cambiar la configuración”, explica un consultor de protección de datos europeo.

Además, el plazo de cinco años de retención abre otro frente. “Mantener datos durante tanto tiempo incrementa el riesgo de filtraciones o usos indebidos, incluso aunque se apliquen procesos de anonimización”, añade el especialista.

¿Qué dice Anthropic?

La compañía asegura que no vende los datos a terceros y que emplea herramientas automáticas para filtrar u ofuscar información sensible. “Nuestro objetivo es reforzar la seguridad y la utilidad de Claude”, defienden en sus comunicados.

No obstante, el argumento no convence a todo el mundo. En un contexto de creciente desconfianza hacia las grandes tecnológicas, el gesto se interpreta como un paso atrás en la construcción de una IA ética y transparente.

El contraste con otros actores

El debate no llega en solitario. Mientras Anthropic introduce cambios que muchos perciben como una cesión en la privacidad, Vivaldi, el navegador alternativo, anunciaba recientemente que no añadirá funciones de IA generativa en su software. Según su CEO, Jon von Tetzchner, hacerlo sería “convertir la exploración activa de la web en un consumo pasivo”.

La comparación es inevitable: algunas compañías refuerzan su compromiso con la privacidad, mientras otras deciden monetizar la información de sus usuarios como combustible de la IA.

El trasfondo legal: un campo minado

Este cambio de rumbo llega en plena efervescencia regulatoria. En la Unión Europea, la entrada en vigor de la Ley de Inteligencia Artificial y el ya veterano RGPD obligan a las empresas a justificar el uso de datos personales y garantizar el consentimiento informado.

En Estados Unidos, aunque no existe un marco federal tan estricto, la presión de demandas colectivas contra compañías como OpenAI, Meta o la propia Anthropic apunta a un futuro donde los tribunales podrían sentar jurisprudencia clave.

Si se confirma que la empresa utilizó libros o contenidos sin licencia en el pasado —como ya se ha denunciado en otros casos—, el nuevo movimiento podría sumar más munición para los críticos.

¿Innovación o riesgo innecesario?

El dilema es claro: la inteligencia artificial necesita datos para mejorar, pero esos datos pertenecen a las personas que los generan. Cada mensaje, cada conversación y cada documento compartido con un chatbot forma parte de la vida digital de un usuario.

Para algunos, la decisión de Anthropic supone un paso lógico en la carrera por desarrollar modelos más potentes. Para otros, es una renuncia peligrosa a la privacidad individual.

Lo que está claro es que la batalla por el control de los datos marcará la evolución de la IA en los próximos años. Y lo que hoy es opt-out podría convertirse mañana en una obligación sin escapatoria.

Preguntas frecuentes (FAQ)

1. ¿Puedo evitar que Claude use mis datos para entrenar sus modelos?

Sí. Debes acceder a los ajustes de privacidad y desactivar manualmente la opción que viene activada por defecto.

2. ¿Durante cuánto tiempo guarda Anthropic los datos de los usuarios?

Hasta cinco años, según la nueva política de privacidad.

3. ¿Qué planes de Claude están afectados por este cambio?

Todos los planes individuales: Free, Pro y Max. Los planes empresariales o integraciones vía API quedan excluidos.

4. ¿Qué riesgos implica aceptar la nueva política?

Tus conversaciones podrán ser almacenadas durante un largo periodo y usadas para entrenar la IA. Aunque Anthropic asegura anonimizar la información, existe el riesgo de filtraciones o usos indebidos.