IBM y Google Cloud se alían para llevar agentes de IA a producción empresarial

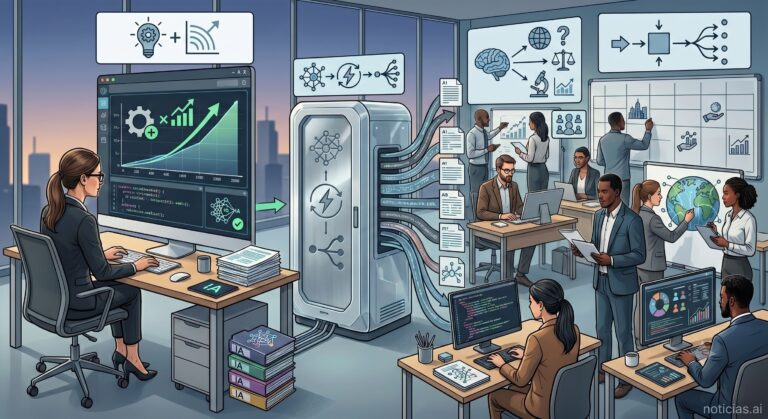

IBM y Google Cloud han anunciado una alianza estratégica para acelerar el despliegue de inteligencia artificial en grandes organizaciones y modernizar sistemas críticos. El acuerdo incluye la creación de una nueva Google Cloud Practice dentro de IBM Consulting, con miles de consultores certificados y equipos de ingeniería desplegados cerca de los clientes para ayudarles a pasar de los pilotos de IA a entornos productivos. La colaboración combina IBM Consulting Advantage, la plataforma de entrega con inteligencia artificial de IBM Consulting, con Gemini Enterprise Agent Platform, además de capacidades de datos, ciberseguridad y gobierno de Google Cloud. La propuesta se dirige a sectores donde la adopción de IA no depende solo de tener buenos modelos, sino de integrarlos con sistemas heredados,