La industria de la inteligencia artificial lleva meses hablando de modelos más grandes, más contexto y más potencia de cálculo. Pero en la práctica, uno de los problemas más serios no está solo en entrenar esos sistemas, sino en mantenerlos funcionando de forma eficiente cuando ya están en producción. Google Research ha puesto ahora el foco en ese punto con TurboQuant, una técnica de compresión presentada el 24 de marzo de 2026 con la que busca reducir uno de los grandes cuellos de botella de los LLM: la memoria que consume la caché clave-valor, conocida como KV cache.

La propuesta llega en un momento en el que la presión sobre la infraestructura es cada vez mayor. Cuanto más largo es el contexto que puede manejar un modelo, más memoria necesita reservar para conservar información ya procesada y reutilizarla durante la inferencia. Esa “memoria rápida” permite responder sin recalcularlo todo desde cero, pero dispara el coste y limita la escalabilidad. Google plantea que TurboQuant puede atacar ese problema sin obligar a sacrificar rendimiento útil, algo especialmente relevante en asistentes conversacionales, sistemas RAG, buscadores semánticos y bases de datos vectoriales.

Menos memoria, menos coste y más margen para escalar

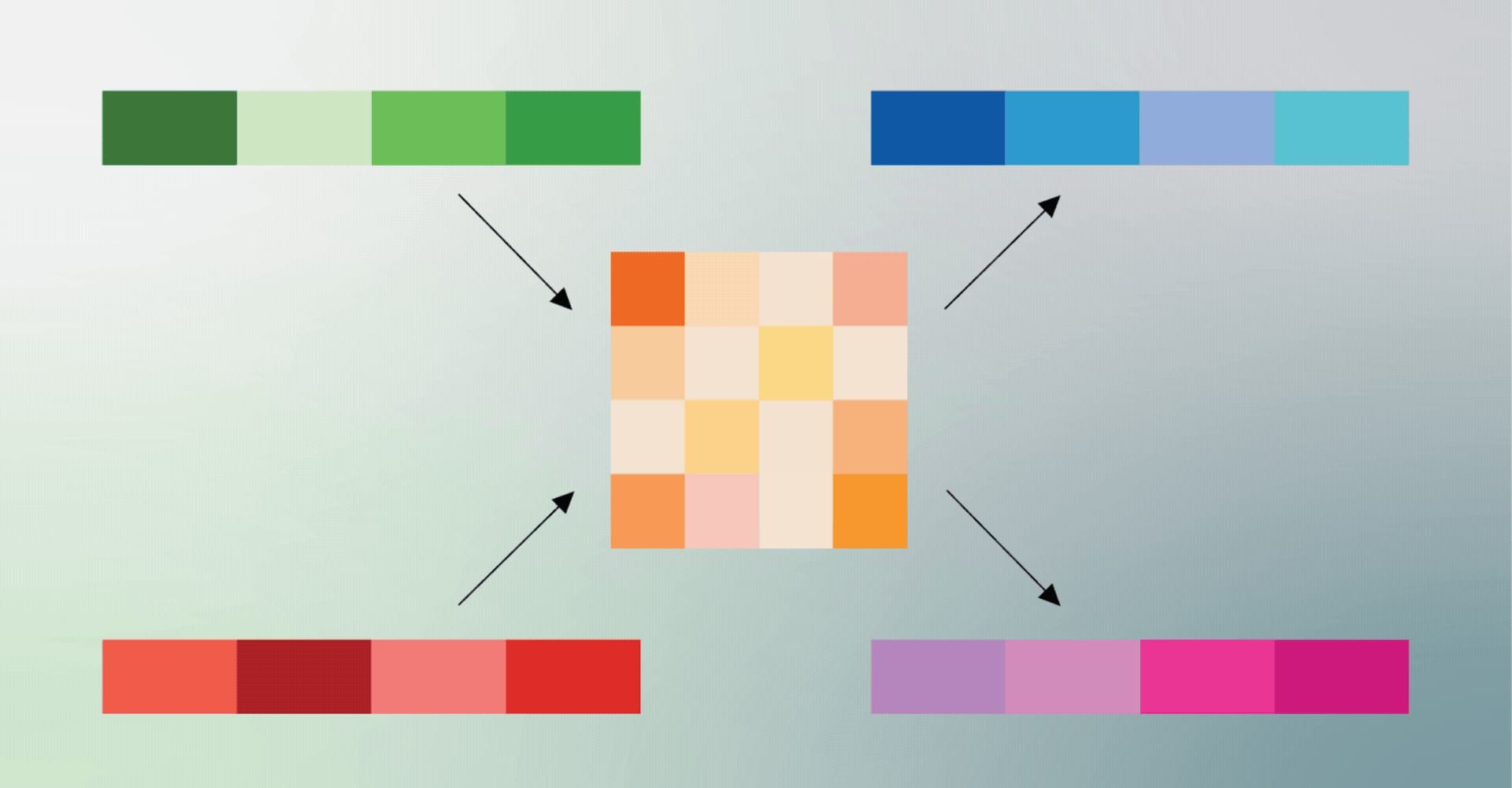

El núcleo técnico del anuncio gira en torno a la cuantización vectorial, una técnica clásica de compresión que reduce el tamaño de vectores de alta dimensión. Esos vectores son la base con la que los modelos representan significado, relaciones semánticas y características de los datos. El problema, según Google, es que muchos métodos tradicionales de cuantización introducen un sobrecoste de memoria porque necesitan almacenar constantes adicionales para cada pequeño bloque comprimido. TurboQuant se presenta precisamente como una forma de reducir ese peaje oculto.

Para lograrlo, Google combina dos piezas. La primera es PolarQuant, una técnica que transforma los vectores para hacer su compresión más eficiente y reducir la necesidad de normalizaciones costosas. La segunda es QJL, siglas de Quantized Johnson-Lindenstrauss, que actúa sobre el pequeño error residual con una corrección de 1 bit. Según la explicación oficial, el efecto conjunto permite comprimir agresivamente la información sin introducir sesgos que distorsionen el cálculo de atención del modelo. PolarQuant, además, figura en la programación oficial de AISTATS 2026, donde está previsto que se presente el 4 de mayo.

Lo relevante para un medio tecnológico no es solo el elegante enfoque matemático, sino lo que implica a nivel de arquitectura. Si una técnica así reduce de verdad la presión sobre la memoria, el impacto potencial va más allá de un benchmark: más usuarios concurrentes por GPU, menos dependencia de configuraciones con memoria extrema, mejor margen para ampliar ventana de contexto y una posible reducción del coste por inferencia. En un mercado donde la eficiencia de hardware se ha vuelto casi tan importante como la calidad del modelo, ese tipo de optimización puede acabar siendo tan estratégica como un nuevo lanzamiento de producto.

Qué enseñan las pruebas y qué conviene matizar

Google asegura haber evaluado TurboQuant, PolarQuant y QJL en benchmarks de contexto largo como LongBench, Needle In A Haystack, ZeroSCROLLS, RULER y L-Eval, usando modelos como Gemma y Mistral. En su publicación, la compañía sostiene que TurboQuant logra resultados perfectos en tareas tipo “aguja en un pajar” mientras reduce el tamaño de la memoria KV al menos 6 veces. También afirma que la técnica puede cuantizar esa memoria hasta 3 bits sin necesidad de entrenamiento o ajuste fino y con un impacto despreciable en el tiempo de ejecución.

En aceleradores NVIDIA H100, Google añade otra cifra que ayuda a entender por qué el sector está mirando este trabajo con interés: una versión de 4 bits de TurboQuant alcanzó hasta 8 veces más rendimiento que claves no cuantizadas de 32 bits en el cálculo de attention logits. Si ese comportamiento se mantiene fuera del laboratorio, la mejora no sería solo económica, sino también operativa: más velocidad en inferencia y mejor aprovechamiento de recursos caros y escasos.

Ahora bien, también conviene leer el trabajo con el matiz que exige cualquier innovación de este tipo. En el post divulgativo, Google habla de compresión a 3 bits sin pérdida de precisión en sus pruebas. Pero en la ficha técnica de OpenReview para ICLR 2026, el resumen del paper formula el resultado de manera algo más conservadora: señala “neutralidad absoluta de calidad” en 3,5 bits por canal y una degradación solo marginal en 2,5 bits por canal. No invalida la aportación, pero sí recuerda que el rendimiento puede depender del escenario concreto, del criterio de medida y del tipo de carga utilizada en la evaluación.

Ese detalle es importante porque la historia de la IA está llena de avances que brillan en entornos controlados y después encuentran fricciones en producción: kernels no optimizados, problemas de integración, compatibilidad irregular con motores de serving o diferencias notables entre modelos. En este caso, Google Research sitúa TurboQuant como una contribución algorítmica con base teórica sólida, y OpenReview lo recoge como póster aceptado en ICLR 2026. Es una señal de interés académico y técnico, aunque todavía no equivale a una adopción inmediata y universal en todos los stacks de inferencia.

Más allá de Gemini: por qué puede afectar también a la búsqueda vectorial

Uno de los aspectos más interesantes del anuncio es que Google no limita TurboQuant al problema de la caché KV en modelos generativos. La compañía subraya que estas técnicas también son útiles para la búsqueda vectorial de alta dimensión, es decir, para sistemas que localizan resultados por proximidad semántica en lugar de hacerlo solo por coincidencia de palabras. Ese terreno es clave para la evolución del buscador, los asistentes basados en recuperación de contexto y buena parte del software empresarial que ya se está construyendo sobre embeddings.

En ese sentido, TurboQuant encaja con una tendencia cada vez más visible: la siguiente gran ventaja competitiva en IA no dependerá únicamente del modelo más grande, sino de quién consiga ejecutar mejor, más rápido y con menos memoria. Google quiere situar esta investigación en ese debate, y no solo como una mejora interna para Gemini. Si la compresión extrema de vectores consigue pasar del paper a los motores de inferencia y a la infraestructura de búsqueda, el efecto puede sentirse en costes, latencia y densidad de despliegue. En una industria dominada por la escasez de memoria de alto ancho de banda y por el precio de las GPU, eso no es un detalle técnico menor, sino una variable estratégica de primer nivel.

Preguntas frecuentes

¿Qué es TurboQuant de Google?

Es una técnica de compresión vectorial presentada por Google Research para reducir el uso de memoria en modelos de IA y en sistemas de búsqueda vectorial, con especial foco en aliviar el cuello de botella de la caché KV durante la inferencia.

¿Por qué la caché KV es tan importante en los LLM?

Porque almacena información ya procesada que el modelo reutiliza al generar respuestas. Eso acelera la inferencia, pero también incrementa mucho el consumo de memoria cuando el contexto es largo o hay muchas peticiones simultáneas.

¿TurboQuant ya está desplegado en productos comerciales de Google?

En las fuentes oficiales consultadas, Google describe la técnica como una aportación de investigación y la vincula a su posible utilidad en sistemas como Gemini, pero no detalla un calendario público de despliegue comercial general.

¿Qué aporta TurboQuant a la búsqueda semántica y a las bases de datos vectoriales?

Según Google, permite construir y consultar índices vectoriales con mucha menos memoria, poco preprocesado y alta precisión, algo relevante para buscadores, sistemas RAG y aplicaciones empresariales apoyadas en embeddings.