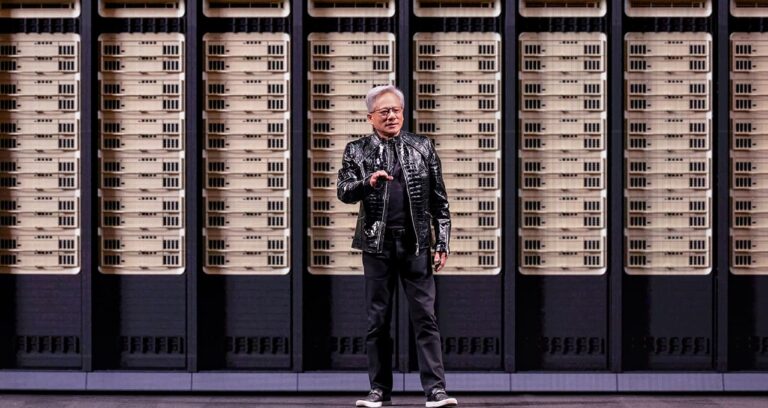

NVIDIA llega a GTC 2026 con la inferencia en el centro y dudas sobre la GPU única

NVIDIA arranca hoy GTC 2026 en San José con una presión distinta a la de otros años. La conferencia se celebra del 16 al 19 de marzo y la keynote de Jensen Huang está fijada para este lunes, en un evento donde la propia compañía promete anuncios sobre Inteligencia Artificial, computación acelerada y robótica. Pero esta vez el foco no está solo en lanzar más potencia bruta, sino en demostrar que sabe adaptarse a una nueva fase del mercado: la de la inferencia, los agentes de IA y la infraestructura a escala de fábrica. La gran pregunta que sobrevuela GTC 2026 es si NVIDIA empezará a matizar de verdad su vieja idea de que una GPU puede resolver prácticamente cualquier