NVIDIA ha aprovechado GTC 2026 para dejar claro que su siguiente gran apuesta ya no gira alrededor de una sola GPU superpotente, sino de una plataforma completa pensada para cubrir todas las fases de la IA moderna. Bajo el nombre de Vera Rubin, la compañía ha presentado un bloque de siete chips y cinco tipos de rack que, según su anuncio oficial, ya están en producción y se combinan como un único “superordenador” orientado a preentrenamiento, postentrenamiento, test-time scaling e inferencia agéntica en tiempo real.

La novedad no está solo en la potencia, sino en el cambio de enfoque. Durante años, NVIDIA vendió la idea de que una misma familia de GPU podía cubrir prácticamente cualquier necesidad relevante en IA. Vera Rubin sugiere una evolución mucho más ambiciosa y también más pragmática: CPU específicas para entornos de agentes y reinforcement learning, GPU para entrenamiento y contexto, LPUs de Groq para inferencia de baja latencia, racks de almacenamiento diseñados para memoria contextual y una capa de red Ethernet e InfiniBand integrada desde el origen. Es, en la práctica, una admisión de que la era de la IA agéntica ya no se resuelve solo con más FLOPS en una GPU.

De chip suelto a plataforma de racks y PODs

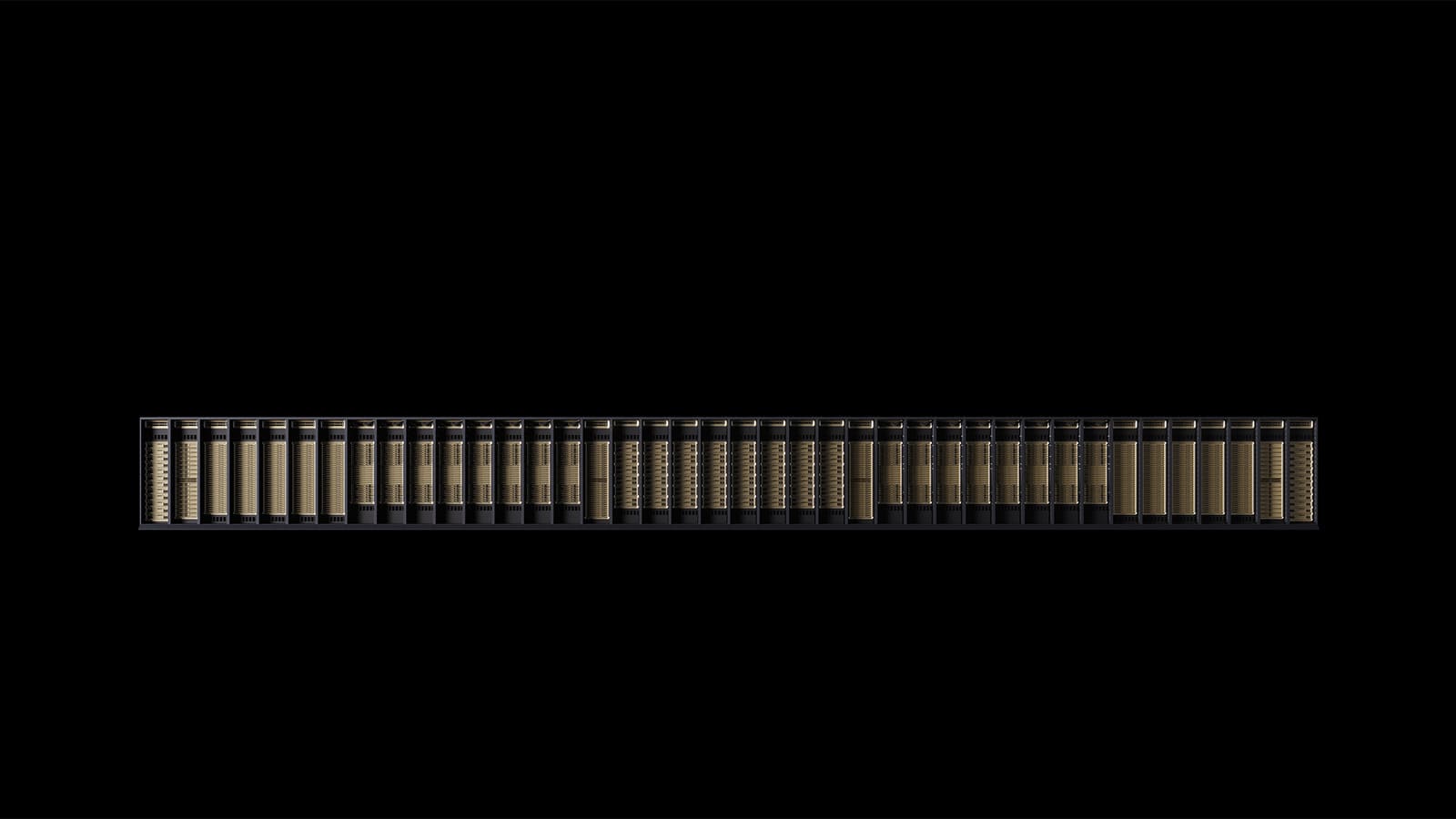

NVIDIA describe Vera Rubin como un salto desde el servidor aislado al sistema de rack y, de ahí, al POD completo de fábrica de IA. Esa visión se materializa en varios bloques. El más visible es Vera Rubin NVL72, un rack con 72 GPU Rubin y 36 CPU Vera conectadas mediante NVLink 6, SuperNIC ConnectX-9 y DPUs BlueField-4. La compañía afirma que esta configuración permite entrenar grandes modelos mixture-of-experts con una cuarta parte de las GPU que exigiría Blackwell y lograr hasta 10 veces más throughput de inferencia por vatio con una décima parte del coste por token. Son cifras oficiales de NVIDIA, no mediciones independientes, pero sirven para entender la escala de la promesa.

El segundo elemento relevante es el Vera CPU Rack. NVIDIA lo presenta como una infraestructura densa y refrigerada por líquido con 256 CPU Vera, pensada para alojar a gran escala los entornos de ejecución que usan los agentes de IA y los sistemas de reinforcement learning para probar, validar y orquestar resultados. Es una pista bastante clara del tipo de mercado al que apunta la compañía: no solo modelos que responden a prompts, sino sistemas que iteran, prueban rutas, ejecutan herramientas y necesitan una base CPU mucho más visible que en el ciclo anterior.

Groq entra de lleno en el corazón de Rubin

Quizá el anuncio más simbólico es la integración de NVIDIA Groq 3 LPX, el nuevo rack de inferencia con 256 procesadores LPU, 128 GB de SRAM en chip y 640 TB/s de ancho de banda scale-up. NVIDIA asegura que, desplegado junto a Vera Rubin NVL72, este bloque permite acelerar el decode al hacer que GPU y LPU calculen conjuntamente cada capa del modelo en cada token de salida. La compañía llega a prometer hasta 35 veces más throughput de inferencia por megavatio y hasta 10 veces más oportunidad de ingresos para modelos del orden del billón de parámetros. Esa parte del discurso debe leerse como posicionamiento de producto, pero marca un giro muy claro: NVIDIA ya no solo quiere vender GPU, quiere dominar también la inferencia especializada de muy baja latencia.

Ese matiz es especialmente importante en 2026. La inferencia agéntica exige contextos largos, respuestas rápidas y mucha más eficiencia energética que el entrenamiento clásico. Ahí encaja la absorción tecnológica de Groq y también la idea de que Rubin no sea una plataforma uniforme, sino configurable por fase de trabajo. En otras palabras, NVIDIA está diseñando un stack donde distintas piezas hacen cosas distintas y cooperan dentro de la misma fábrica de IA. Es probablemente la señal más fuerte hasta ahora de que la compañía ha dejado atrás la visión de “una GPU para todo”.

Almacenamiento y red ya son parte del diseño, no accesorios

La plataforma también incorpora BlueField-4 STX, un rack de almacenamiento que NVIDIA define como infraestructura “AI-native” para extender la memoria de contexto a escala de POD. La compañía lo vincula al nuevo framework DOCA Memos y sostiene que esta capa puede aumentar hasta cinco veces el throughput de inferencia al acelerar el manejo del KV cache de los grandes modelos. A eso se suma Spectrum-6 SPX Ethernet, que se ofrece como columna vertebral del tráfico este-oeste entre racks y que podrá configurarse tanto con Spectrum-X Ethernet como con Quantum-X800 InfiniBand. NVIDIA también subraya el uso de óptica co-packaged para mejorar eficiencia energética y resiliencia frente a transceptores enchufables clásicos.

Todo esto deja una lectura bastante evidente para un medio tecnológico: la batalla ya no está solo en el acelerador principal. La memoria contextual, el almacenamiento del KV cache, la red interna del POD y la gestión de energía están entrando en el mismo plano estratégico que antes ocupaba exclusivamente la GPU. NVIDIA intenta capturar todo ese valor en un solo diseño de referencia, hasta el punto de presentar también DSX Max-Q y DSX Flex como capas para exprimir mejor el presupuesto eléctrico y volver las fábricas de IA más flexibles respecto a la red. Según la compañía, DSX Max-Q permitiría desplegar un 30 % más de infraestructura de IA dentro de un centro de datos con potencia fija, y DSX Flex ayudaría a convertir estas instalaciones en activos “grid-flexible”.

Disponibilidad, ecosistema y lo que falta por demostrar

NVIDIA afirma que los productos basados en Vera Rubin estarán disponibles a través de socios desde la segunda mitad de este año. Entre los proveedores cloud citados están AWS, Google Cloud, Microsoft Azure y Oracle Cloud Infrastructure, además de Cloud Partners como CoreWeave, Crusoe, Lambda, Nebius, Nscale y Together AI. También aparecen fabricantes como Cisco, Dell, HPE, Lenovo, Supermicro, ASUS, Foxconn, Gigabyte, Inventec, Pegatron, QCT, Wistron y Wiwynn. Y, en paralelo, laboratorios y desarrolladores de frontera como Anthropic, Meta, Mistral AI y OpenAI figuran como futuros usuarios de la plataforma.

Eso no significa que todo vaya a desplegarse al mismo tiempo ni con la misma madurez. La parte más prudente del análisis está ahí: hoy lo que existe es un anuncio oficial de plataforma con disponibilidad prevista para la segunda mitad de 2026 y con un ecosistema muy amplio ya alineado. Lo que todavía falta por ver es el rendimiento real fuera de las demos, la adopción efectiva de los racks con LPUs, el coste real de operación frente a Blackwell y, sobre todo, si el mercado acepta esta transición desde la GPU como producto central a la fábrica de IA como unidad económica completa. Aun así, GTC 2026 deja una conclusión difícil de discutir: Vera Rubin no es simplemente la siguiente GPU de NVIDIA. Es la primera plataforma donde la compañía muestra abiertamente cómo imagina la infraestructura de la IA agéntica a escala industrial.

Preguntas frecuentes

¿Qué es exactamente NVIDIA Vera Rubin?

Es la nueva plataforma de infraestructura de IA presentada por NVIDIA en GTC 2026. Integra siete chips —entre ellos Vera CPU, Rubin GPU, NVLink 6, ConnectX-9, BlueField-4, Spectrum-6 y Groq 3 LPU— y varios tipos de rack para cubrir entrenamiento, postentrenamiento, test-time scaling e inferencia agéntica.

¿Qué cambia frente a generaciones anteriores como Blackwell?

La principal diferencia es que Vera Rubin se plantea como una arquitectura de fábrica de IA mucho más heterogénea. Ya no gira solo en torno a una GPU, sino a racks especializados para GPU, CPU, inferencia con LPU, almacenamiento contextual y red de alta velocidad, todos diseñados para funcionar como un único sistema.

¿Qué papel juega Groq dentro de Vera Rubin?

NVIDIA ha integrado Groq 3 LPX como rack de inferencia de baja latencia. Según la compañía, sus LPUs trabajarán junto a las GPU Rubin para acelerar especialmente la fase de decode en modelos de gran tamaño y contexto largo.

¿Cuándo estarán disponibles los sistemas Vera Rubin?

NVIDIA indica que los productos basados en Vera Rubin llegarán a través de socios durante la segunda mitad de 2026. Entre los socios anunciados figuran grandes nubes públicas, fabricantes de servidores y laboratorios de IA de primer nivel.