NVIDIA lleva meses presentando Vera Rubin como la siguiente gran plataforma para la era de la IA agéntica, y oficialmente mantiene el rumbo: la compañía asegura que Vera Rubin NVL72 ya está en plena producción y que los sistemas basados en esta generación empezarán a llegar de la mano de sus socios en la segunda mitad de 2026. La empresa también ha explicado que la nueva arquitectura se apoya en un ecosistema global de más de 80 socios y en una cadena de suministro diversificada para llevar sus sistemas rack-scale al mercado.

Sin embargo, bajo esa hoja de ruta pública empieza a asomar una realidad menos limpia y bastante más reveladora sobre cómo se construye hoy la infraestructura de IA. Un informe reciente de DIGITIMES, apoyado en fuentes de la cadena de suministro de componentes pasivos, sostiene que el diseño de la compute tray de Vera Rubin todavía no estaría completamente cerrado, a pesar de que la plataforma apunta a producción en el tercer trimestre. Según ese mismo reporte, las revisiones responden a una estrategia más agresiva de diversificación de proveedores y a la voluntad de eliminar dependencias de fuente única en piezas críticas. Es decir, NVIDIA no solo estaría afinando un diseño técnico: también estaría rediseñando cómo quiere fabricar y abastecer su siguiente generación de sistemas.

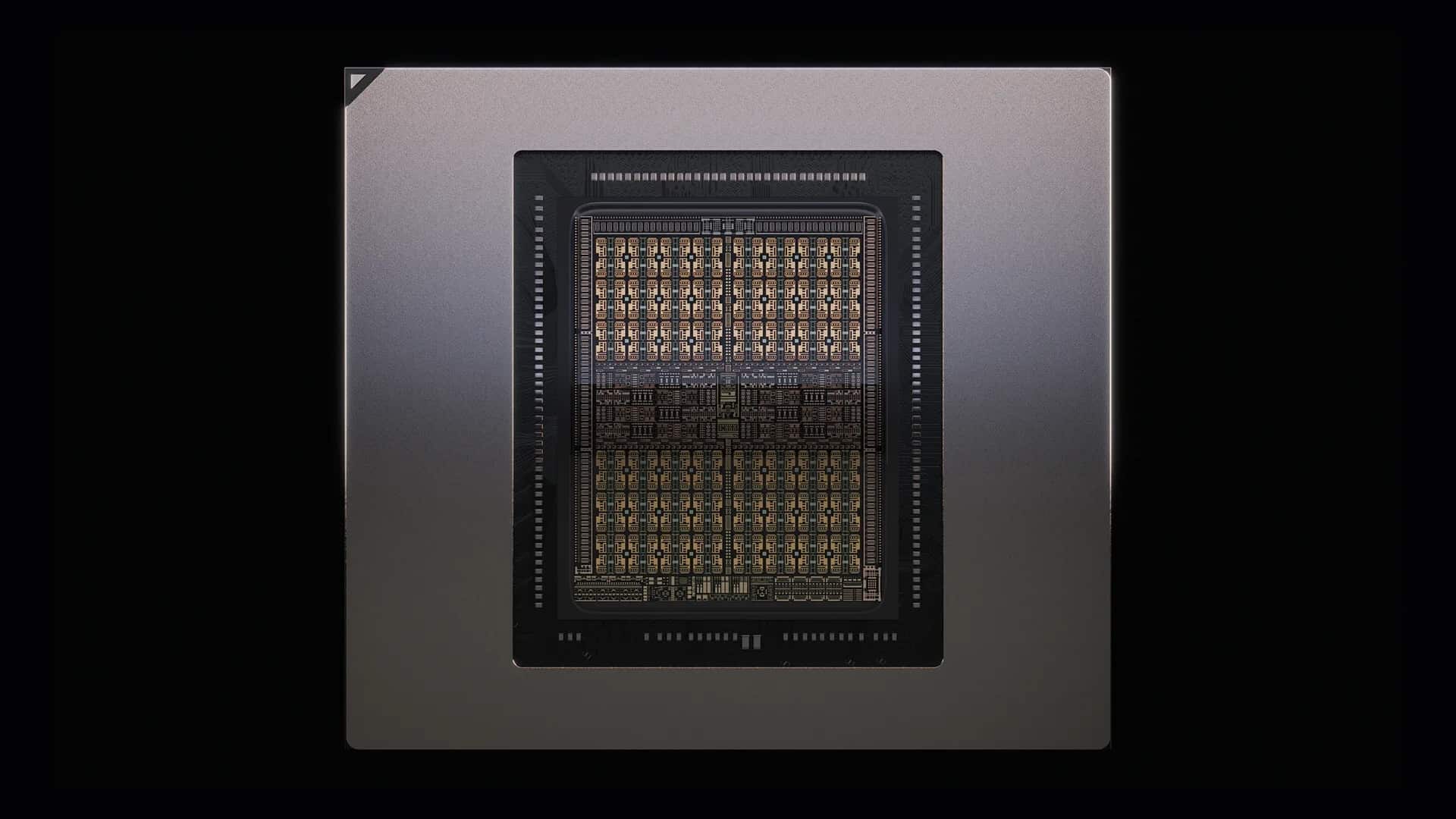

Ese matiz importa más de lo que parece. Vera Rubin NVL72 no es un servidor cualquiera, sino una plataforma de enorme complejidad. NVIDIA detalla que cada rack integrará 72 GPU Rubin, 36 CPU Vera, 18 compute trays y 9 bandejas de conmutación NVLink, con alrededor de 1,3 millones de componentes en total. La propia compañía presume de que las compute trays de Vera Rubin han sido completamente rediseñadas frente a Blackwell, con una arquitectura interna pensada para acelerar el ensamblaje y simplificar mantenimiento y servicio. Cuando un sistema de ese tamaño cambia aún elementos de su BOM en la fase previa al despliegue masivo, no se trata de un simple ajuste cosmético: afecta a plazos, validación, rendimiento eléctrico y capacidad real de escalar sin sobresaltos.

El problema ya no es solo diseñar el mejor rack

La lectura más interesante de esta posible revisión no está únicamente en el riesgo de un retraso puntual, sino en el cambio de prioridades que sugiere. Durante años, la conversación sobre los grandes sistemas de IA se ha centrado en GPU, memoria HBM o interconexión. Pero a medida que el mercado madura, la resiliencia de la cadena de suministro se convierte en un requisito casi tan importante como el rendimiento bruto. NVIDIA lo reconoce de forma implícita cuando insiste en su red global de socios y en la integración entre cómputo, red, almacenamiento, energía y refrigeración para maximizar la disponibilidad y acelerar el tiempo hasta producción.

En ese contexto encaja el otro dato llamativo del reporte asiático: Panasonic SP-CAP, un tipo de condensador de polímero de aluminio con fuerte presencia en aplicaciones exigentes, no habría sido finalmente adoptado en la compute tray de Vera Rubin. Panasonic sí presenta públicamente su familia SP-CAP como adecuada para cargas constantes y elevadas en AI servers, switches, routers y estaciones base, e incluso recomienda sus series de larga vida para este tipo de entornos. Pero precisamente esa especialización no resuelve el problema que ahora parece preocupar más a NVIDIA: la concentración del suministro. Si una pieza concreta obliga a depender demasiado de un proveedor o de un grupo reducido de fuentes, la ganancia técnica puede no compensar el riesgo industrial.

La alternativa que, según esas informaciones, gana peso son los MLCC de alta capacidad, un componente mucho menos vistoso para el gran público, pero cada vez más estratégico en la electrónica de potencia para IA. Aquí sí hay señales públicas sólidas de que el mercado está tensándose. Samsung Electro-Mechanics afirma que los servidores de IA utilizan entre 10 y 15 veces más MLCC que los servidores de propósito general, y destaca que la demanda ya se está desplazando hacia piezas de ultra alta capacitancia y alto voltaje. Murata, por su parte, ha lanzado este año una guía técnica específica para optimizar el suministro eléctrico en servidores de IA y ha insistido en que la estabilidad de la alimentación es ya un reto de primer orden en centros de datos de nueva generación.

Los condensadores también entran en la guerra de la IA

Lo que hasta hace poco parecía una cuestión de ingeniería secundaria empieza a convertirse en una variable económica y estratégica. Murata reconoció en su conferencia de resultados del tercer trimestre fiscal de 2026 que la demanda para AI servers es “muy vigorosa”, que el soporte al cliente pesa ya más que el precio en este segmento y que la empresa opera con una utilización de capacidad del 90 % al 95 %. La compañía llegó a admitir que en 2026 la gran cuestión será cuánto podrá producir y hasta qué punto podrá responder a la demanda, e incluso respondió afirmativamente a la posibilidad de que la capacidad siga siendo insuficiente o que el suministro no llegue a tiempo.

Ese telón de fondo explica por qué un cambio de componente en Vera Rubin no debe leerse solo como una anécdota de fabricación. En plataformas de IA cada vez más densas, la electrónica de potencia se vuelve crítica y los MLCC pasan de ser una pieza invisible a convertirse en un elemento sensible del coste, del suministro y de la escalabilidad. DIGITIMES ya había advertido en diciembre de 2025 que los MLCC se estaban convirtiendo en uno de los principales contribuyentes al coste del BOM en servidores de IA, solo por detrás de GPU y memoria. Y TrendForce se ha hecho eco en 2026 de un endurecimiento del mercado, con subidas potenciales de precios y mayor presión sobre fabricantes como Murata o Samsung Electro-Mechanics.

No todo esto significa necesariamente que Vera Rubin vaya a sufrir un retraso amplio o visible en el mercado. NVIDIA sigue comunicando disponibilidad para la segunda mitad del año, y nada en su hoja de ruta pública sugiere, por ahora, un cambio oficial de calendario. Pero sí dibuja una realidad más incómoda: la próxima gran plataforma de IA no depende solo de chips avanzados y grandes anuncios, sino también de miles de decisiones discretas sobre quién suministra qué, con qué margen de maniobra y con qué capacidad de reaccionar si una pieza falla o se convierte en un cuello de botella.

En otras palabras, Vera Rubin no solo está poniendo a prueba la capacidad de NVIDIA para seguir escalando rendimiento. También está poniendo a prueba su habilidad para industrializar sistemas cada vez más complejos sin quedar atrapada por dependencias demasiado estrechas. Si el precio a pagar por esa resiliencia es revisar el diseño hasta el último momento, quizá el mercado acabe aceptándolo. En la era de la IA a escala gigavatio, diversificar proveedores ya no parece una cuestión de compras: empieza a ser parte del diseño del producto.

Preguntas frecuentes

¿Ha confirmado NVIDIA un retraso de Vera Rubin por cambios en la compute tray?

No. NVIDIA mantiene oficialmente que Vera Rubin NVL72 está en producción y que los productos basados en esta plataforma llegarán en la segunda mitad de 2026. Lo que existe por ahora son reportes de cadena de suministro que apuntan a revisiones de diseño y posibles ajustes en algunos envíos.

¿Por qué son tan importantes los MLCC en un servidor de IA?

Porque ayudan a estabilizar la alimentación eléctrica en sistemas con consumos muy altos y con una densidad extrema de cómputo. Samsung Electro-Mechanics asegura que los servidores de IA usan entre 10 y 15 veces más MLCC que un servidor convencional, y Murata está centrando parte de su estrategia técnica precisamente en ese problema de power delivery.

¿Qué tiene de especial Vera Rubin frente a generaciones anteriores?

NVIDIA lo presenta como un sistema rack-scale completamente rediseñado, con 72 GPU Rubin, 36 CPU Vera, 18 compute trays y 9 bandejas NVLink por rack, además de una arquitectura interna orientada a simplificar ensamblaje y servicio respecto a Blackwell.

¿La diversificación de proveedores puede afectar al calendario de una plataforma de IA?

Sí. Cambiar componentes o abrir el diseño a más de un proveedor puede mejorar la resiliencia a medio plazo, pero también obliga a validar piezas, ajustar especificaciones y revisar el BOM, algo que puede tensar plazos en la fase previa a la producción masiva. Eso es precisamente lo que apuntan los reportes sobre Vera Rubin.

vía: Jukan