NVIDIA ha puesto sobre la mesa en la Game Developers Conference de San Francisco una idea que lleva tiempo ganando peso en estudios grandes y distribuidos: sacar parte del desarrollo de videojuegos del puesto físico tradicional y moverlo a infraestructura centralizada en centro de datos. Su propuesta se articula alrededor de NVIDIA RTX PRO Server, una plataforma basada en las RTX PRO 6000 Blackwell Server Edition y en el software NVIDIA vGPU, con la que la compañía quiere virtualizar estaciones de trabajo, pruebas, flujos de IA y tareas de ingeniería sobre una misma base compartida.

La idea no es menor. El desarrollo de videojuegos actual combina mundos más grandes, cadenas de producción más complejas y equipos cada vez más repartidos entre oficinas, teletrabajo, socios externos y estudios en distintas regiones. En ese contexto, seguir dependiendo de hardware GPU fijo, atado a una mesa concreta, empieza a generar ineficiencias: estaciones infrautilizadas en un equipo mientras otro espera recursos, entornos de trabajo desalineados entre departamentos y más dificultad para reproducir errores cuando el hardware, los drivers y las herramientas no coinciden exactamente. NVIDIA plantea RTX PRO Server como respuesta a ese problema.

La compañía sostiene que este enfoque permitiría centralizar y virtualizar tareas de arte, desarrollo, investigación en IA y QA sobre una misma infraestructura GPU en el CPD, manteniendo una experiencia de clase workstation pero con más escalabilidad, mejor utilización de recursos y más consistencia operativa entre sedes. El argumento encaja con una tendencia más amplia del mercado: ya no se trata solo de comprar GPUs potentes, sino de organizarlas como recurso compartido y reasignable según la carga real del estudio.

De estaciones aisladas a una infraestructura GPU común

En el planteamiento de NVIDIA, el cambio principal es pasar de escalar “workstation por workstation” a hacerlo desde una infraestructura centralizada. Eso permitiría, por ejemplo, usar la misma capacidad GPU durante la noche para entrenamiento de modelos, simulación o automatización, y reasignarla durante el día a tareas interactivas de desarrollo y creación de contenido. Desde el punto de vista de la eficiencia, el mensaje es claro: menos capacidad ociosa y más elasticidad interna sin multiplicar el número de equipos físicos repartidos por cada departamento.

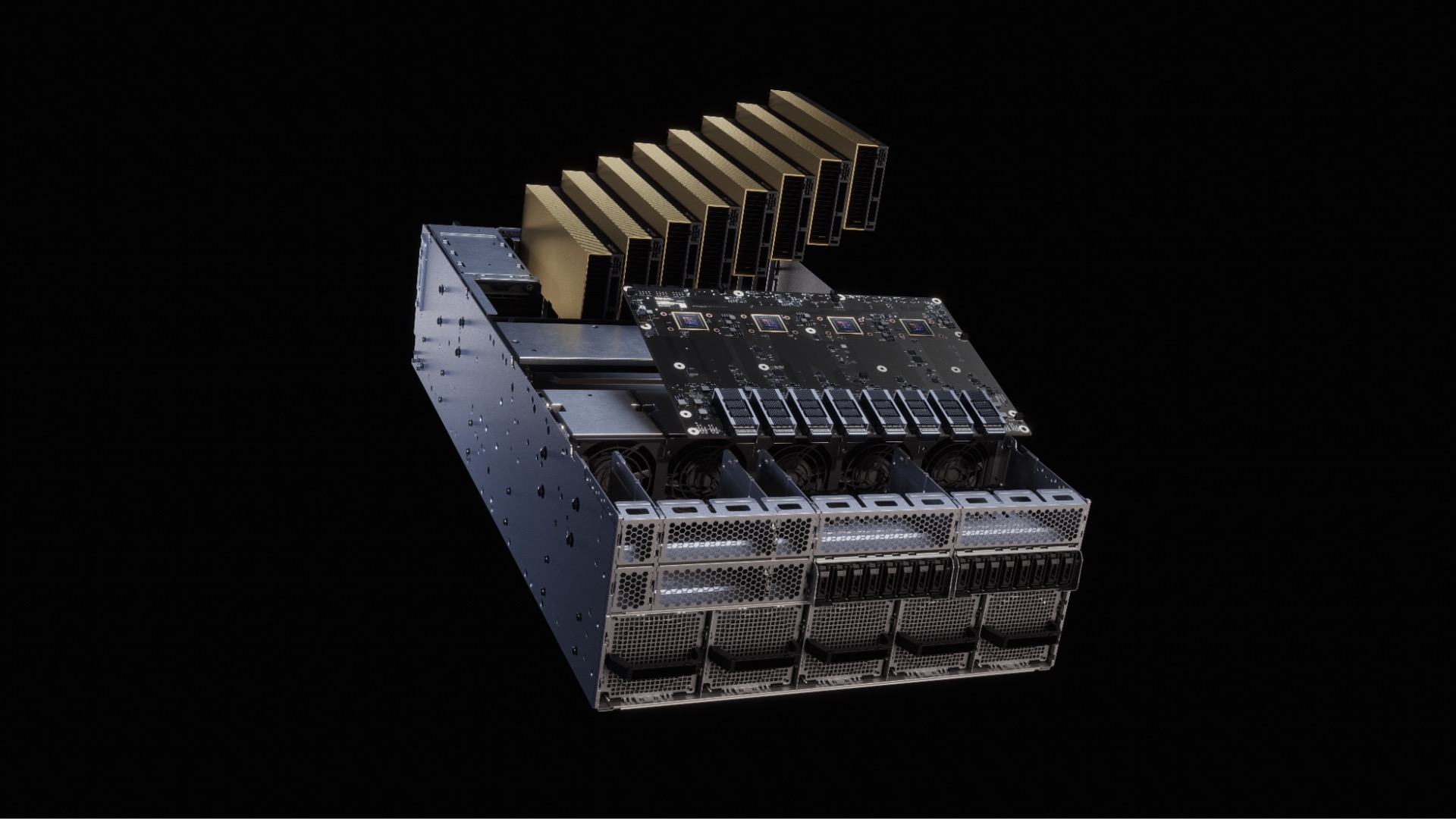

La pieza de hardware en la que se apoya esta visión es la RTX PRO 6000 Blackwell Server Edition, una GPU profesional de centro de datos con 96 GB de memoria GDDR7 con ECC, 24.064 CUDA cores, soporte para PCIe 5.0, hasta 4 PFLOPS FP4 para IA, y un consumo configurable de hasta 600 W, según la ficha oficial de NVIDIA. La compañía la presenta como una GPU capaz de acelerar tanto gráficos RTX como cargas de IA, renderizado, simulación y analítica avanzada dentro del mismo entorno.

Para estudios de videojuegos, esto abre un abanico interesante. Según el propio blog de NVIDIA, los artistas podrían trabajar con estaciones RTX virtuales para 3D y flujos de contenido generativo; los desarrolladores tendrían entornos consistentes para programación y desarrollo 3D; los investigadores en IA podrían reservar perfiles con más memoria para fine-tuning, inferencia y agentes; y los equipos de QA podrían escalar validación y pruebas de rendimiento usando la misma arquitectura Blackwell que también alimenta las GeForce RTX 50 Series.

IA, QA y desarrollo compartiendo el mismo backend

Uno de los puntos más interesantes del anuncio es que NVIDIA no vende RTX PRO Server solo como una plataforma de virtualización gráfica, sino como una infraestructura compartida para gráficos e IA. La compañía insiste en que la Inteligencia Artificial ya forma parte del trabajo diario en estudios, desde el apoyo a la programación hasta la creación de contenido, las pruebas y las operaciones en vivo. Eso obliga a muchas empresas a mantener pilas separadas: por un lado estaciones gráficas, por otro servidores o clusters dedicados a IA. La propuesta de NVIDIA intenta romper esa separación.

Aquí entra en juego la combinación de MIG y vGPU. NVIDIA explica que la tecnología Multi-Instance GPU permite particionar una GPU en instancias aisladas con memoria, caché y cómputo dedicados. En la ficha oficial de la RTX PRO 6000 Blackwell Server Edition, la empresa habla de hasta 4 particiones MIG de 24 GB por GPU. Sin embargo, en el contexto del desarrollo de videojuegos, NVIDIA añade que en configuraciones combinadas de MIG + vGPU, una sola RTX PRO 6000 Blackwell Server Edition puede llegar a soportar hasta 48 usuarios concurrentes, algo pensado para maximizar el uso manteniendo aislamiento de rendimiento.

Ese dato es llamativo, aunque conviene interpretarlo con prudencia. No significa que 48 usuarios vayan a disfrutar de la misma experiencia en cualquier carga, sino que la plataforma puede segmentarse y asignar capacidad según perfiles y necesidades muy distintas. En otras palabras, no es lo mismo una sesión ligera de revisión o tooling que una carga intensiva de render, compilación o simulación. Aun así, el mensaje estratégico es nítido: NVIDIA quiere que los estudios piensen la GPU como un recurso empresarial compartido y no como una caja fija bajo cada mesa.

Un enfoque empresarial para estudios más distribuidos

NVIDIA también subraya que RTX PRO Server está diseñado para operaciones de CPD de nivel empresarial. La compañía explica que los estudios pueden desplegar estaciones virtuales sobre hipervisores y plataformas de remote workstation compatibles con NVIDIA vGPU, encajando así en infraestructuras y prácticas IT ya existentes, en lugar de exigir despliegues aislados o entornos paralelos. Además, recuerda que grandes publishers ya utilizan vGPU para escalar infraestructura de desarrollo centralizada.

Ese detalle es relevante porque el valor de esta propuesta no se limita al rendimiento. También apunta a problemas muy concretos del desarrollo moderno: contratistas externos, estudios multisede, equipos híbridos, validación más rápida en QA y mayor capacidad para reproducir bugs bajo configuraciones homogéneas. En un momento en que los videojuegos combinan producción distribuida, presión presupuestaria y uso creciente de IA, la estandarización de entornos puede ser casi tan importante como la potencia bruta.

Aun así, la propuesta también tiene sus preguntas abiertas. NVIDIA ha presentado la visión y la base tecnológica, pero el valor real para cada estudio dependerá de factores como el coste total del despliegue, la latencia de acceso remoto, la gestión interna de perfiles y permisos, la integración con herramientas ya existentes y la capacidad del equipo IT para operar esa infraestructura sin añadir demasiada complejidad. La promesa es atractiva; la ejecución será la que determine si esto se convierte en un nuevo estándar o en una solución reservada a estudios muy grandes.

Lo que sí parece claro es que NVIDIA está empujando una idea de fondo: el futuro del desarrollo de videojuegos no pasa solo por GPUs más rápidas en local, sino por GPU virtualization, IA compartida y estaciones de trabajo convertidas en servicio interno. Y en esa transición, RTX PRO Server quiere ser la plataforma que una artistas, programadores, investigadores y QA sobre una misma columna vertebral de Blackwell.

Preguntas frecuentes

¿Qué es NVIDIA RTX PRO Server?

Es una plataforma de infraestructura para centro de datos basada en GPUs RTX PRO 6000 Blackwell Server Edition y software NVIDIA vGPU, pensada para virtualizar estaciones de trabajo y ejecutar cargas de gráficos e IA en entornos empresariales.

¿Para qué quiere NVIDIA virtualizar el desarrollo de videojuegos?

La idea es centralizar recursos GPU para artistas, desarrolladores, equipos de QA e investigadores en IA, mejorando la utilización del hardware, la consistencia entre equipos y la escalabilidad en estudios distribuidos.

¿Qué GPU usa RTX PRO Server?

NVIDIA lo apoya en la RTX PRO 6000 Blackwell Server Edition, una GPU con 96 GB GDDR7 con ECC, hasta 24.064 CUDA cores y soporte para gráficos RTX, IA, renderizado y simulación.

¿Cuántos usuarios puede soportar una RTX PRO 6000 Blackwell Server Edition?

Según NVIDIA, en configuraciones combinadas de MIG y vGPU, una sola GPU puede soportar hasta 48 usuarios concurrentes, aunque el rendimiento dependerá del tipo de carga asignada a cada perfil.

vía: blogs.nvidia