NVIDIA ha presentado en GTC 2026 un nuevo plano de referencia abierto para uno de los grandes cuellos de botella de la inteligencia artificial física: los datos. La compañía ha anunciado la Physical AI Data Factory Blueprint, una arquitectura pensada para automatizar la generación, ampliación, evaluación y preparación de datos con los que entrenar robots, agentes de visión artificial y sistemas de conducción autónoma a gran escala. La idea de fondo es sencilla de entender: sin datos abundantes, variados y bien validados, no hay robot fiable ni vehículo autónomo que pueda madurar de verdad.

La relevancia del anuncio está en que NVIDIA no lo plantea como una herramienta aislada, sino como una cadena completa de trabajo que va desde el dato bruto hasta el conjunto final listo para entrenamiento. En esa cadena entran la curación de datos reales y sintéticos, la generación de escenarios raros o difíciles de capturar en el mundo real, la validación automática de resultados y la orquestación de todo el proceso sobre infraestructura cloud o híbrida. También importa otro detalle: el blueprint completo no está todavía publicado en GitHub, pero NVIDIA ha señalado que espera liberarlo en abril, mientras que algunas piezas clave ya son públicas.

De la simulación al dato listo para entrenar

El problema que intenta resolver NVIDIA es muy concreto. En robótica y conducción autónoma no basta con tener modelos potentes: hace falta entrenarlos con enormes volúmenes de datos que incluyan no solo situaciones normales, sino también casos raros, fallos, condiciones meteorológicas adversas, cambios de iluminación o interacciones poco frecuentes. Esos llamados escenarios de “larga cola” son caros, lentos y en ocasiones peligrosos de capturar en el mundo real, por lo que la generación sintética y la simulación se han convertido en piezas centrales del desarrollo moderno.

Según la propia NVIDIA, su nuevo blueprint se apoya en varios componentes ya conocidos del ecosistema Cosmos. Cosmos Curator se ocupa de procesar, refinar y anotar grandes conjuntos de datos reales y sintéticos; Cosmos Transfer amplía y diversifica esos datos para multiplicar escenarios; y Cosmos Evaluator, que ya está disponible en GitHub, sirve para puntuar, verificar y filtrar automáticamente la calidad física de los vídeos sintéticos generados. En su repositorio público, NVIDIA define Cosmos Evaluator como un sistema automatizado de evaluación para salidas sintéticas de vídeo, con comprobaciones sobre alucinaciones, correspondencia de obstáculos y verificación de atributos del entorno.

La pieza que une todo esto es OSMO, el orquestador abierto de NVIDIA para cargas de trabajo de IA física. La compañía lo describe como una plataforma de orquestación cloud-native que coordina clústeres de entrenamiento, simulación y entornos edge mediante flujos definidos en YAML. OSMO no sustituye a simuladores o frameworks de entrenamiento, sino que los organiza y coordina, y ahora además se integra con agentes de código como Claude Code, OpenAI Codex y Cursor para automatizar parte de la operación. En otras palabras, NVIDIA quiere que el desarrollador no tenga que dedicar tanto tiempo a pelear con la infraestructura y pueda centrarse en el modelo.

Azure y Nebius convierten el anuncio en algo más tangible

Uno de los aspectos más interesantes del anuncio es que Microsoft Azure y Nebius no aparecen solo como socios de escaparate. Microsoft ha presentado ya un Azure Physical AI Toolchain en GitHub, descrito en su propio repositorio como un framework open source y “production-ready” que integra servicios cloud de Azure con la pila de IA física de NVIDIA. El proyecto combina Azure Machine Learning, AKS, Azure Arc, almacenamiento, seguridad con Entra ID, simulación con Isaac Sim e Isaac Lab y orquestación con OSMO, con una orientación clara hacia entornos empresariales y despliegues serios, no simples demostraciones de escritorio.

Ese matiz es importante porque baja el discurso de GTC a un terreno más práctico. Microsoft no habla solo de simulación, sino de una cadena completa que incluye captura de datos en Jetson, conversión automática de datos, validación, entrenamiento, evaluación y despliegue de modelos en el edge. Incluso afirma que su guía rápida permite entrenar una política de pick-and-place en Isaac Lab sobre GPU en Azure, seguir métricas con MLflow y desplegar el modelo en un dispositivo Jetson mediante GitOps en menos de dos horas. Es una promesa ambiciosa, pero al menos llega acompañada de repositorio, arquitectura y documentación pública.

Nebius, por su parte, ha optado por presentar la propuesta como un servicio gestionado sobre su AI Cloud. La empresa asegura que ha integrado el blueprint de NVIDIA en su infraestructura global y que ya ofrece un entorno para generar datos sintéticos basados en física, orquestar flujos con OSMO y combinar esa capa con almacenamiento, etiquetado, ejecución serverless e inferencia gestionada. Nebius afirma además que algunos primeros usuarios ya están recortando ciclos de iteración de semanas a días, aunque esa parte debe leerse como una afirmación comercial de la propia compañía y no como una comparación independiente.

Por qué esta noticia importa más de lo que parece

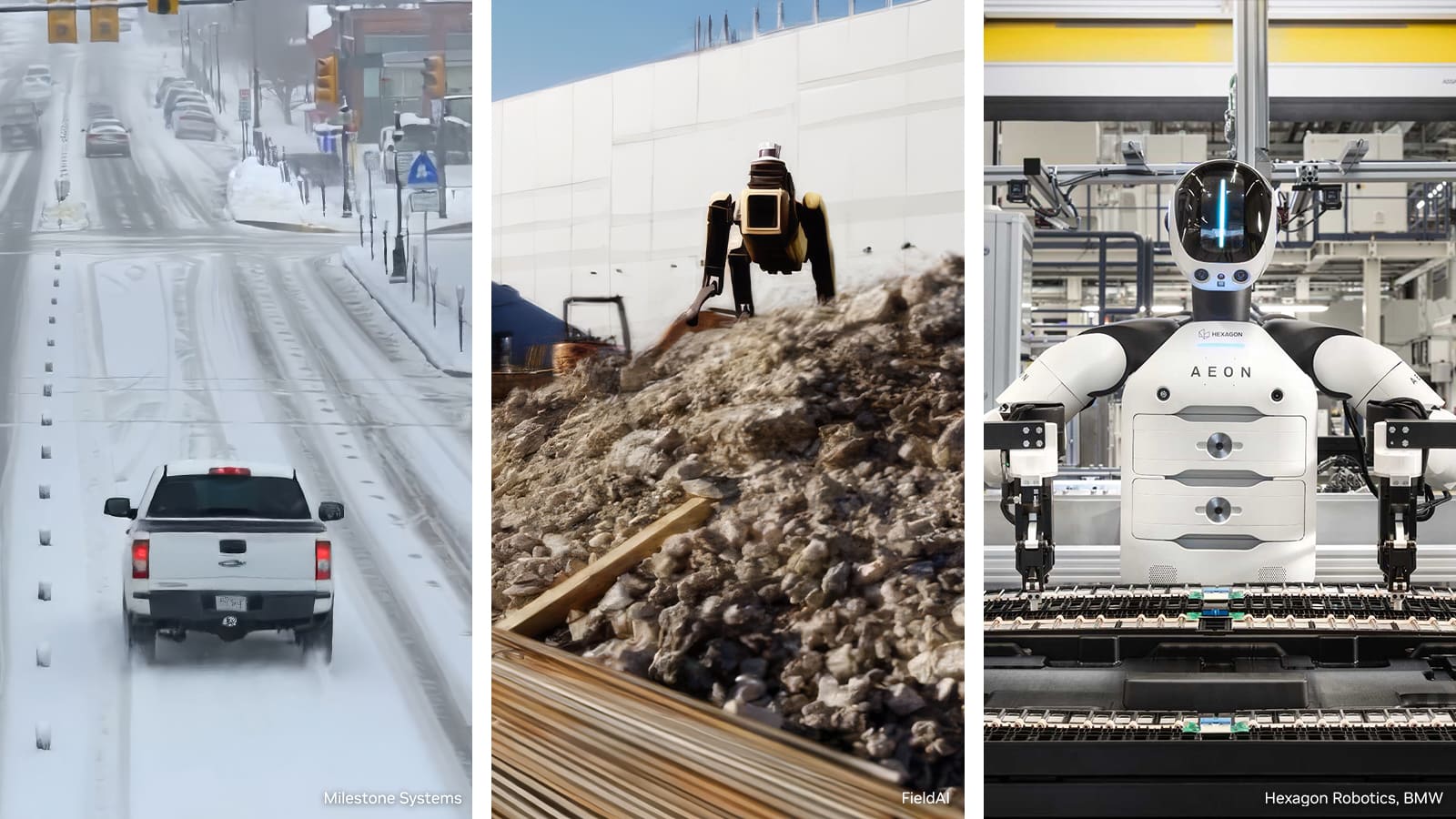

El anuncio encaja con una tendencia que NVIDIA lleva meses construyendo alrededor de la llamada “physical AI”. En enero ya presentó Alpamayo, una familia abierta de modelos y herramientas para conducción autónoma centrada en escenarios complejos y razonamiento sobre la larga cola de eventos de tráfico. Ahora la compañía explica que está usando este nuevo blueprint precisamente para entrenar y evaluar Alpamayo, mientras empresas como Skild AI lo aplican a robots generalistas y Uber lo usa para acelerar el desarrollo de vehículo autónomo. Eso convierte el plano de referencia en algo más que una pieza técnica: pasa a ser una infraestructura base para alimentar el siguiente ciclo de modelos físicos.

También hay una lectura industrial más amplia. En robótica y automoción, muchas empresas no fallan por falta de ideas, sino por la fragmentación entre simulación, entrenamiento, evaluación y despliegue. NVIDIA intenta cerrar esa brecha con una propuesta que mezcla modelos del mundo, simulación, generación sintética, evaluación automática y orquestación multiinfraestructura. No es un producto mágico ni una solución cerrada para todo el mundo, pero sí una señal clara de por dónde se está moviendo el mercado: menos herramientas aisladas y más tuberías completas de datos y validación listas para escalar.

Queda por ver cuánto tarda esta visión en traducirse en adopción real fuera de los socios anunciados y en qué medida el blueprint abierto logrará atraer a desarrolladores independientes, startups y fabricantes más allá del ecosistema de NVIDIA. Pero el mensaje de fondo ya está claro: en la IA física, la ventaja no dependerá solo del modelo ni del chip, sino de quién sea capaz de producir, depurar y validar datos mejores a una velocidad mucho mayor. Y ahí NVIDIA quiere convertir la computación acelerada en una auténtica fábrica de datos.

Preguntas frecuentes

¿Qué es exactamente NVIDIA Physical AI Data Factory Blueprint?

Es una arquitectura de referencia abierta anunciada por NVIDIA para automatizar la curación, generación sintética, ampliación, evaluación y preparación de datos destinados al entrenamiento de robots, agentes de visión artificial y vehículos autónomos.

¿Está ya disponible para descargar?

NVIDIA ha indicado que el blueprint completo se espera en GitHub en abril de 2026. Aun así, algunos de sus componentes ya son públicos, como Cosmos Evaluator, y parte del ecosistema ya puede probarse a través de repositorios y servicios asociados.

¿Qué papel tienen Microsoft Azure y Nebius en este proyecto?

Azure está integrando el blueprint en un toolchain abierto para IA física publicado en GitHub, mientras que Nebius lo ha incorporado a su AI Cloud como base para flujos gestionados de generación de datos, entrenamiento y despliegue.

¿Por qué son tan importantes los datos sintéticos en robótica y coche autónomo?

Porque permiten cubrir casos raros o peligrosos que son muy difíciles, caros o lentos de capturar en el mundo real. Eso resulta clave para entrenar modelos más robustos y para validar su comportamiento antes de llevarlos a producción.