La carrera de la Inteligencia Artificial en el centro de datos se suele contar en GPUs, en redes y en vatios por rack. Pero, en la práctica, muchos cuellos de botella se están desplazando a un componente menos “glamuroso” y mucho más determinante: la memoria. Micron ha querido poner cifras y producto sobre la mesa con un anuncio que apunta directamente al corazón del problema: la compañía ya está enviando muestras a clientes de SOCAMM2 de 256 GB, un módulo de LPDRAM (LPDDR5X adaptada a servidor) con el que busca acelerar arquitecturas de inferencia y cómputo general con un consumo sensiblemente menor que el de las RDIMM tradicionales.

El contexto es relevante: la combinación de entrenamiento, inferencia, agentes y cargas “clásicas” está empujando a los servidores a necesitar más capacidad, más eficiencia y más densidad. Las ventanas de contexto crecen, las cachés KV se vuelven persistentes y el coste energético deja de ser una variable secundaria. Micron sostiene que, a este nivel, la memoria ya no es un simple “acompañante” del cómputo, sino un límite del sistema que afecta rendimiento, escalabilidad y coste total de propiedad.

Qué es SOCAMM2 y por qué aparece ahora

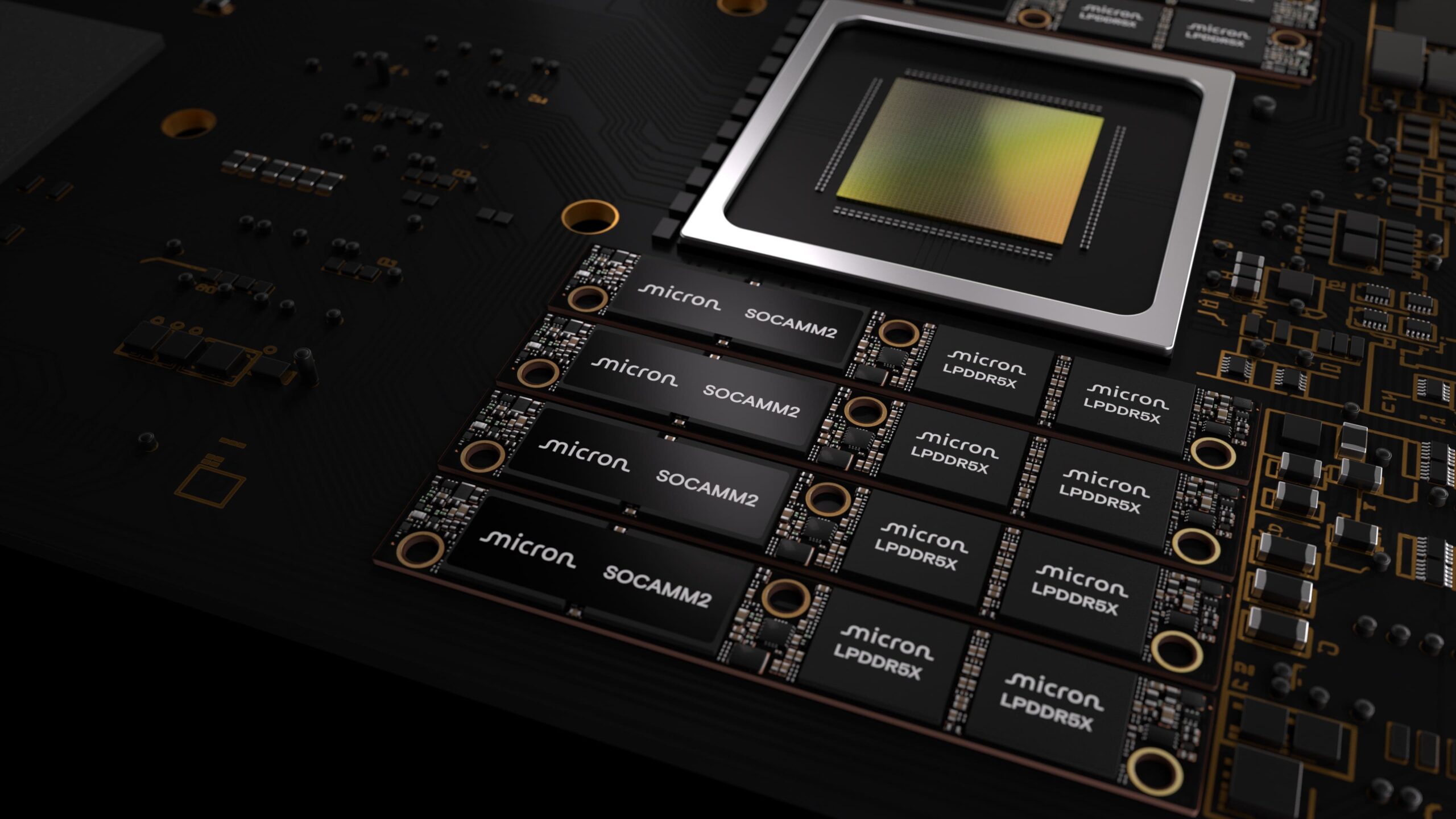

SOCAMM2 significa Small Outline Compression Attached Memory Module 2: un formato modular derivado de la familia CAMM2, orientado a ofrecer alta capacidad en un módulo compacto y “serviceable” (sustituible), con LPDDR5X como base tecnológica. La idea es aprovechar lo mejor de la memoria de bajo consumo —típica del mundo móvil—, pero llevándola a plataformas de servidor donde la densidad, el calor y los límites de potencia mandan.

En la industria, SOCAMM/SOCAMM2 lleva tiempo madurando como alternativa para ciertos diseños, especialmente ligados a plataformas de alto rendimiento y sistemas optimizados para Inteligencia Artificial. Analistas del sector han destacado que el form factor 14 × 90 mm apunta a reducir espacio respecto a RDIMM, y que el enfoque de LPDDR puede aportar ventajas claras en consumo.

El salto de Micron: 256 GB, dado monolítico de 32 Gb y foco en eficiencia

El movimiento de Micron tiene dos titulares técnicos potentes. El primero: el módulo SOCAMM2 de 256 GB se apoya en lo que la compañía describe como el primer dado monolítico LPDDR5X de 32 Gb de la industria, un punto importante porque la integración y el empaquetado son, a menudo, la diferencia entre un prototipo y un producto viable a escala.

El segundo: Micron asegura que este módulo consume aproximadamente un tercio de la energía y ocupa un tercio del espacio frente a RDIMMs equivalentes, con una comparación basada en su propio cálculo interno (SOCAMM2 de 128 GB frente a dos RDIMM DDR5 de 64 GB para igualar bus/capacidad). Es un matiz que conviene subrayar: es una referencia útil, pero depende de condiciones y configuraciones concretas.

Donde el anuncio intenta ser más disruptivo es en arquitectura: Micron afirma que con 256 GB por módulo se llega a 2 TB de LPDRAM por CPU en servidores de 8 canales, orientado a contextos grandes y a inferencia compleja.

El impacto prometido en inferencia: “time to first token” y caché KV

La métrica que Micron pone como bandera para el mundo LLM es el tiempo hasta el primer token (TTFT), que suele marcar la sensación de “respuesta inmediata” en escenarios de inferencia interactiva. Según sus pruebas internas, en arquitecturas de memoria unificada, usar 2 TB de LPDRAM por CPU para descargar caché KV puede mejorar el TTFT en más de 2,3 veces en inferencia de contexto largo, con un ejemplo basado en Llama 3 70B (FP16), contexto de 500K y 16 usuarios concurrentes (según condiciones descritas por la propia compañía).

Además, en aplicaciones CPU “stand-alone”, Micron habla de más de 3 veces mejor rendimiento por vatio frente a módulos de memoria convencionales para cargas HPC concretas (también con metodología interna).

Para los equipos de infraestructura, el punto clave no es solo “más rápido”, sino “más eficiente”: si parte de la inferencia puede sostenerse con menos vatios por GB y mejor densidad de rack, el diseño del centro de datos cambia. Y cambia especialmente en un momento en el que el suministro eléctrico y la refrigeración se han convertido en un freno real para escalar.

NVIDIA aparece en escena: co-diseño y validación de plataforma

Micron enmarca SOCAMM2 dentro de una colaboración con NVIDIA para co-diseñar memoria orientada a infraestructura avanzada de Inteligencia Artificial. En el anuncio, la compañía insiste en que el objetivo es optimizar “cada capa” del sistema, y recoge una valoración desde el lado de CPUs de centro de datos en NVIDIA sobre la relevancia de combinar gran capacidad con menor consumo respecto a la memoria tradicional.

Más allá de la cita, la lectura industrial es clara: para que SOCAMM2 se convierta en estándar de facto, no basta con que exista un módulo. Hace falta que encaje en plataformas reales, que el ecosistema lo soporte y que la estandarización reduzca fricción entre proveedores.

JEDEC y la batalla por el estándar: por qué esto puede acelerar la adopción

Micron también recalca su participación en la definición de la especificación SOCAMM2 en JEDEC, un punto que suele ser determinante para que un formato pase de “diseño interesante” a “opción industrial”. El movimiento hacia un marco común permitiría que más fabricantes y más integradores trabajen sobre la misma base, reduciendo dependencia de implementaciones propietarias.

En paralelo, otros grandes actores del mercado también han presentado su visión de SOCAMM2 como módulo LPDDR para centros de datos, lo que sugiere que la industria está empujando en una dirección parecida: más capacidad y más eficiencia, incluso si eso implica cambiar inercias frente a RDIMM DDR5.

Tabla resumen: qué promete el SOCAMM2 de 256 GB de Micron

| Punto clave | Qué anuncia Micron | Por qué importa en centro de datos |

|---|---|---|

| Capacidad por módulo | 256 GB SOCAMM2 | Más memoria “cerca” de CPU para inferencia y HPC |

| Dado base | LPDDR5X monolítico de 32 Gb | Densidad y empaquetado para escalar módulos |

| Capacidad por CPU (8 canales) | Hasta 2 TB de LPDRAM | Ventanas de contexto grandes y caché KV más holgada |

| Consumo y huella (comparativa) | ~1/3 energía y ~1/3 tamaño vs RDIMM equivalente (cálculo interno) | Mejora densidad de rack y presión térmica |

| Inferencia (TTFT) | >2,3× TTFT en contexto largo (pruebas internas) | Respuesta más rápida en LLM interactivos |

| Rendimiento por vatio (CPU/HPC) | >3× perf/W en casos internos | Menos coste energético por carga útil |

Lo que viene ahora: de las muestras al despliegue real

Micron habla, por el momento, de muestras a clientes. Ese matiz suele marcar el inicio del tramo más exigente: validación en plataforma, perfiles térmicos, compatibilidad con refrigeración líquida, capacidad de servicio en campo y, por supuesto, coste por GB en comparación con alternativas. La compañía defiende que el diseño modular facilita la “serviceability” y soporta arquitecturas de servidor más orientadas a eficiencia energética.

Si SOCAMM2 de 256 GB termina entrando en diseños comerciales a escala, el cambio no será solo un “módulo más grande”: puede consolidar una tendencia donde parte del centro de datos se rediseña alrededor de memoria de bajo consumo para sostener inferencia de gran contexto con límites de potencia más estrictos.

Preguntas frecuentes

¿Qué es un módulo SOCAMM2 y para qué sirve en servidores de Inteligencia Artificial?

SOCAMM2 es un formato modular de memoria LPDDR5X orientado a centros de datos. Busca ofrecer alta capacidad y menor consumo que RDIMM, útil para inferencia con grandes ventanas de contexto y cachés KV.

¿Por qué Micron insiste en “2 TB por CPU” y qué significa en la práctica?

Micron afirma que con 256 GB por módulo se pueden alcanzar 2 TB de LPDRAM en CPUs con 8 canales. Esto permite alojar más datos de contexto y reducir cuellos de botella de memoria en inferencia compleja.

¿SOCAMM2 sustituirá a las RDIMM DDR5 en todos los centros de datos?

No necesariamente. SOCAMM2 apunta a arquitecturas concretas donde el consumo y la densidad son críticos. RDIMM seguirá siendo dominante en muchos despliegues generalistas, pero SOCAMM2 puede ganar terreno en plataformas optimizadas para eficiencia.

¿Qué debería vigilar un equipo de sistemas antes de apostar por SOCAMM2?

Compatibilidad de plataforma (CPU/placa), disponibilidad real en volumen, perfiles térmicos, soporte del fabricante, y el coste total por GB (incluyendo impacto en rack, potencia y refrigeración).

vía: investors.micron