Una arquitectura modular para dotar de memoria de largo plazo a la inteligencia artificial generativa

En el dinámico panorama de la inteligencia artificial, el desarrollo de modelos de lenguaje de gran escala (LLMs) ha supuesto un hito sin precedentes. Sin embargo, una de sus limitaciones más evidentes sigue siendo su capacidad de recordar información más allá de una única conversación. En este contexto, la aparición de MemOS, un sistema operativo de memoria para LLMs, representa un cambio de paradigma hacia una inteligencia más contextual, persistente y personalizada.

¿Qué es MemOS y por qué importa?

Desarrollado por el equipo de MemTensor, MemOS es una plataforma de código abierto diseñada para integrarse con LLMs y dotarlos de memoria estructurada y dinámica. A diferencia de otras aproximaciones que simulan el recuerdo mediante ventanas de contexto o reenvío de información relevante, MemOS propone una solución modular y escalable, basada en una arquitectura denominada MemCube.

Este sistema permite almacenar, recuperar y gestionar memorias de múltiples tipos: texto, activaciones (KVCache) y parámetros de adaptación. La idea central es sencilla pero poderosa: llevar la persistencia cognitiva al corazón del modelo de IA, sin alterar su arquitectura base.

“MemOS es a los LLMs lo que un sistema operativo fue al ordenador personal: una interfaz entre capacidad bruta y uso inteligente”, explican sus creadores.

Comparativa de rendimiento: Memoria que razona

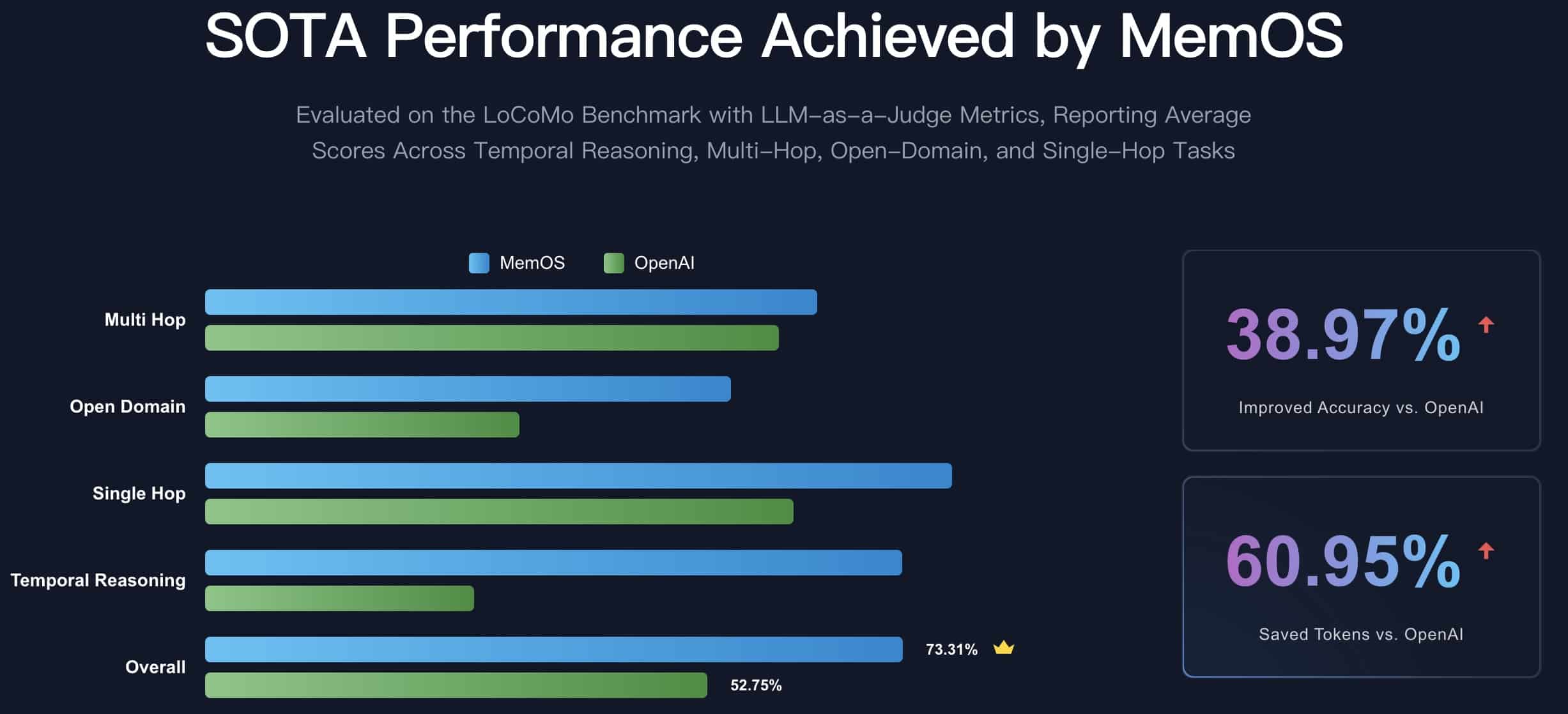

Los resultados de MemOS en el benchmark LOCOMO muestran mejoras notables respecto a las soluciones actuales de memoria contextual (como LangMem o Zep) y frente a la implementación estándar de OpenAI. Especialmente llamativas son las cifras en tareas de razonamiento temporal, donde MemOS mejora el rendimiento en más de un 159 %.

| Tarea | OpenAI | MemOS | Mejora |

|---|---|---|---|

| Media global | 0,5275 | 0,7331 | +38,98 % |

| Multi-hop reasoning | 0,6028 | 0,6430 | +6,67 % |

| Open domain QA | 0,3299 | 0,5521 | +67,35 % |

| Single-hop reasoning | 0,6183 | 0,7844 | +26,86 % |

| Razonamiento temporal | 0,2825 | 0,7321 | +159,15 % |

Este rendimiento coloca a MemOS entre las soluciones de vanguardia en memoria aumentada para LLMs, con aplicaciones directas en asistentes inteligentes, agentes autónomos y sistemas empresariales de alto contexto.

Arquitectura modular: MemCube y más allá

MemOS se basa en una arquitectura de módulos independientes pero interoperables:

- MemCube: la unidad básica de memoria, donde se almacenan datos de tipo textual, activación y paramétrico.

- MOS (Memory Operating System): la capa de orquestación que permite gestionar múltiples cubos de memoria, usuarios y contextos.

- APIs unificadas: acceso sencillo a funciones como añadir, buscar o filtrar memorias, con extensibilidad para nuevas fuentes de datos.

MemOS soporta integración con herramientas como Ollama, Hugging Face Transformers y servicios como OpenRouter, haciendo posible su uso tanto en cloud como en entornos locales o privados.

Casos de uso y evolución prevista

MemOS ha sido diseñado pensando en entornos de ejecución reales. Algunos casos ya en despliegue incluyen:

- Asistentes conversacionales con memoria personal (CRM, educación, salud).

- Agentes de IA que aprenden de interacciones previas (soporte técnico, IA legal).

- Sistemas de IA que requieren continuidad narrativa o histórica (storytelling, juegos, simulaciones).

Sus creadores ya trabajan en futuras versiones que incluyan:

- Memoria multimodal (texto, imagen, audio, vídeo).

- Memoria distribuida con almacenamiento seguro en la nube o blockchain.

- Agentes LLM multicuenta con perfiles persistentes diferenciados.

- Enlaces neuronales entre modelos mediante parametric memory compartida.

La primera piedra hacia una IA con sentido del tiempo

El concepto detrás de MemOS —una IA que recuerda y razona a lo largo del tiempo— abre la puerta a sistemas verdaderamente inteligentes, capaces de interactuar de manera progresiva y evolutiva con personas, tareas y contextos.

“MemOS es la memoria operativa de una IA verdaderamente útil. No solo responde: se acuerda de ti”, afirman sus desarrolladores.

La versión MemOS 1.0 «Stellar» ya está disponible como preview en GitHub (bajo licencia Apache 2.0). La comunidad está invitada a contribuir, probar e integrar esta tecnología en sus propios agentes conversacionales y sistemas cognitivos.