La idea del asistente personal de Inteligencia Artificial ya no se limita a una ventana de chat en la nube. MachinaOS, un proyecto open source publicado en GitHub, propone algo más ambicioso: una plataforma autoalojada para crear asistentes y “co-empleados” de IA capaces de ejecutar flujos, usar herramientas, recordar contexto, coordinarse entre sí y conectarse con servicios como correo, calendario, WhatsApp o dispositivos Android. El propio repositorio lo define como una mezcla entre n8n y OpenClaw, con más visibilidad sobre lo que hace el asistente y más control sobre sus capacidades.

El proyecto llega en un momento en el que cada vez más usuarios técnicos quieren reducir dependencia de asistentes cerrados y mover parte de esa inteligencia a infraestructura propia. Según la documentación oficial, MachinaOS puede ejecutarse en local, utilizar modelos de múltiples proveedores y apoyarse en memoria conversacional, llamadas a herramientas y modos de razonamiento. Eso lo sitúa más cerca de una plataforma de automatización con IA persistente que de un simple chatbot de escritorio.

Un panel visual para montar asistentes que trabajen de verdad

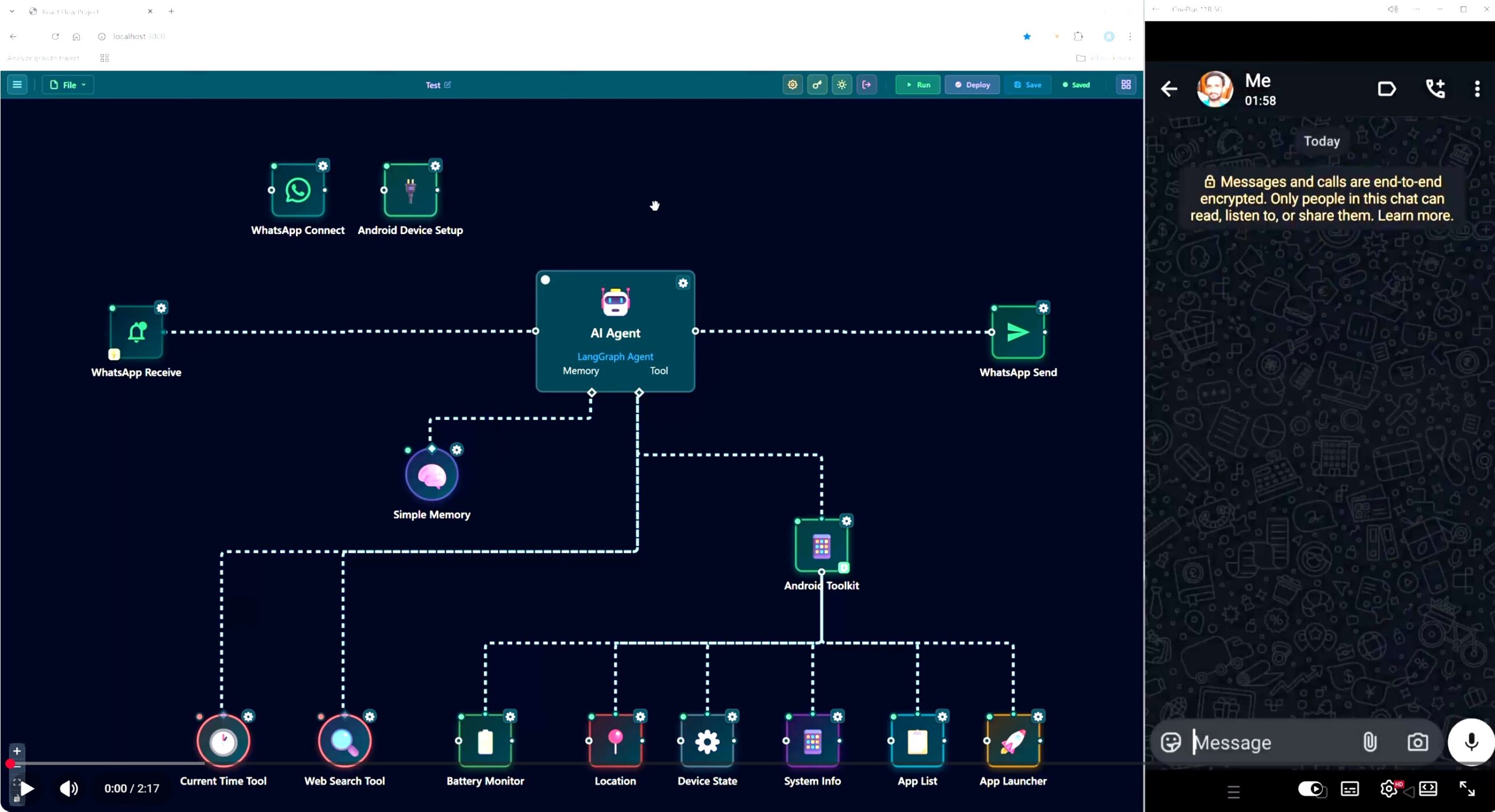

Uno de los principales atractivos de MachinaOS es que no se presenta como una herramienta exclusivamente para desarrolladores puros. La documentación oficial lo describe como una plataforma visual de automatización basada en nodos, construida con React Flow en el frontend y FastAPI en el backend, con ejecución en tiempo real mediante WebSocket. En la práctica, eso significa que el usuario puede diseñar workflows, encadenar servicios y observar cómo se ejecutan sin depender solo de scripts o código manual.

La propia documentación habla de 60 nodos y de una arquitectura orientada a automatizaciones reales: IA, skills, WhatsApp, Android, documentos, webhooks y programación de tareas. También indica que el despliegue recomendado usa Docker Compose con cuatro contenedores y un proxy inverso Nginx, además de Redis en producción o SQLite en desarrollo como capa de persistencia. Todo ello deja claro que MachinaOS no quiere ser solo una demo vistosa, sino una base real para operar asistentes persistentes en infraestructura propia.

Más que un chatbot: memoria, herramientas y equipos de agentes

El proyecto intenta diferenciarse por la amplitud de sus capacidades. En GitHub, MachinaOS asegura que permite crear asistentes que recuerdan conversaciones, usan herramientas y trabajan juntos. Su documentación concreta más: soporta varios proveedores de IA, agentes con tool calling, memoria conversacional simple y almacenamiento vectorial a largo plazo, además de un sistema de workflows y automatizaciones que recuerda bastante a la lógica de plataformas como n8n.

En ese contexto, una de las partes más llamativas es la construcción de equipos de agentes. El README describe un modelo con un “AI Employee” u orquestador que delega en agentes especializados —por ejemplo, de código, web o tareas— y expone herramientas delegate_to_* automáticamente. La documentación oficial también subraya la idea de agentes con skills y colaboración, aunque la parte más avanzada de multiagente sigue claramente en evolución. Aun así, la propuesta es clara: no solo conversar con una IA, sino organizar varias capacidades dentro de un mismo sistema.

Google Workspace, WhatsApp, Android y documentos

Donde MachinaOS intenta marcar distancias es en la conexión con el mundo real. El repositorio promete automatización de Google Workspace —correo, calendario, Drive, hojas de cálculo, tareas y contactos—, envío de mensajes por WhatsApp, Telegram y X, e incluso control de un móvil Android en aspectos como WiFi, Bluetooth, cámara, apps y estado del dispositivo. La documentación pública confirma varias de estas áreas, especialmente WhatsApp, Android, webhooks, HTTP y ejecución de código Python dentro de los workflows.

También se menciona el procesamiento documental y web: scraping, uso de actores de Apify, análisis de PDFs y búsqueda de archivos con IA. Aquí conviene introducir un matiz importante: el hecho de que un proyecto ofrezca estas capacidades no significa que todas estén igual de maduras o listas para producción intensiva. En repositorios jóvenes, es habitual que el README proyecte una visión amplia del producto mientras la documentación refleja mejor el estado operativo real. En el caso de MachinaOS, la documentación disponible sí confirma una base funcional sólida, pero también deja claro que sigue siendo una plataforma en construcción.

Instalación rápida, pero no del todo trivial

MachinaOS intenta rebajar la barrera de entrada con un arranque bastante directo. El repositorio indica como requisitos Node.js 22+ y Python 3.12+, y ofrece tres caminos principales: instalación global con npm install -g machinaos, un instalador de una sola línea para Linux/macOS o PowerShell, y despliegue para desarrolladores clonando el repositorio y ejecutando npm run build y npm run start. El acceso inicial se realiza desde http://localhost:3000.

Sin embargo, para un medio de administración de sistemas o para cualquier lector técnico conviene decirlo con claridad: aunque la promesa de arranque es sencilla, esto no es una aplicación “sin fricción” al estilo de un SaaS. Requiere dependencias modernas, entender mínimamente el entorno Node/Python y, si se quiere llevar a producción, asumir un despliegue más estructurado con Docker Compose, proxy y persistencia. Dicho de otro modo, es accesible para perfiles técnicos, pero todavía está lejos de ser una herramienta plug-and-play para cualquier usuario generalista.

Lo más interesante de MachinaOS no es lo que ya es, sino hacia dónde apunta

El proyecto todavía no transmite la sensación de producto completamente cerrado o maduro, pero sí refleja una tendencia muy clara: la del asistente personal autoalojado, persistente, ampliable y conectado a herramientas reales. Frente a los asistentes comerciales, MachinaOS apuesta por el control de infraestructura, la orquestación visual y la posibilidad de montar un entorno propio donde los datos, la memoria y la lógica de trabajo viven fuera de la nube de terceros. La documentación insiste precisamente en ese punto: está diseñado para self-hosting y para que los datos permanezcan en la infraestructura del usuario.

Eso no convierte automáticamente a MachinaOS en el “ejército de empleados artificiales” que algunos mensajes promocionales describen. Pero sí lo convierte en uno de los proyectos más interesantes de esta nueva ola de asistentes abiertos que quieren ir más allá del chat y entrar en la automatización operativa. Si consigue estabilizar su base técnica y madurar su modelo multiagente, podría convertirse en una pieza relevante dentro del ecosistema de IA personal y empresarial autoalojada.

Preguntas frecuentes

¿Qué es exactamente MachinaOS?

Es una plataforma open source para crear asistentes personales y agentes de IA con workflows visuales, memoria, herramientas y conexiones a servicios externos, diseñada para ejecutarse en infraestructura propia.

¿MachinaOS funciona solo con modelos en la nube?

No. El repositorio habla de múltiples proveedores y la documentación indica soporte para varios modelos y modos de IA, aunque la configuración exacta depende del entorno y de las integraciones que el usuario habilite.

¿Se puede usar para WhatsApp y Android?

Sí. La documentación oficial incluye apartados específicos para automatización con WhatsApp y control de dispositivos Android, además de otros servicios externos.

¿Es una herramienta ya lista para cualquier empresa?

Todavía con matices. El proyecto ofrece una base muy prometedora, pero sigue teniendo perfil de plataforma en crecimiento y exige cierto nivel técnico para instalarla, mantenerla y llevarla a producción.