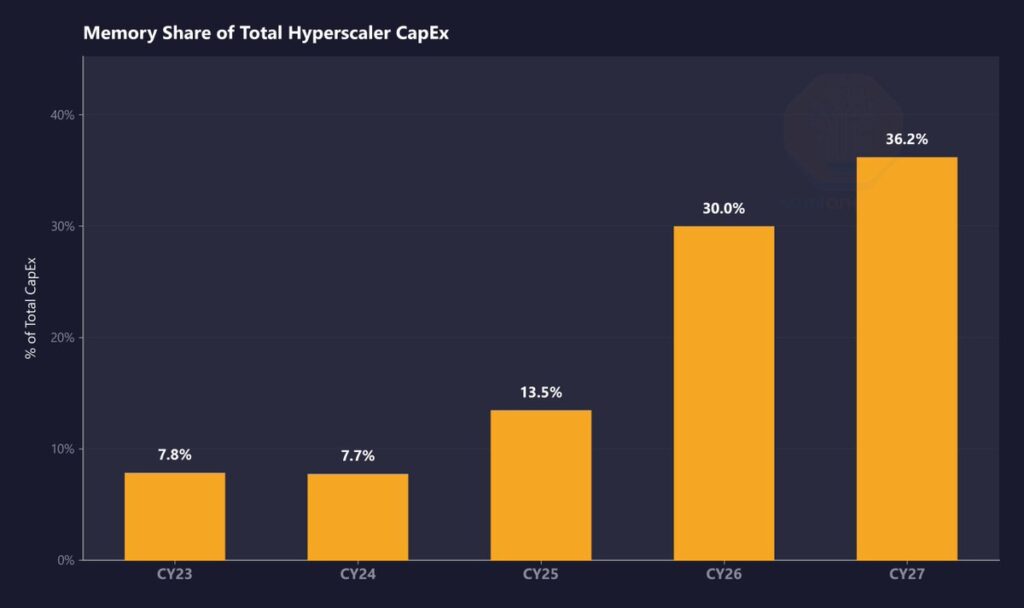

La siguiente gran tensión de la inteligencia artificial no parece estar solo en las GPU. Cada vez más analistas y fabricantes están poniendo el foco en la memoria, hasta el punto de que ya empieza a hablarse de una nueva fase del ciclo: la de una infraestructura de IA donde DRAM, LPDDR5 y HBM pesan cada vez más en el coste total de los sistemas y en el capex de los grandes operadores cloud. La tesis más agresiva la ha formulado SemiAnalysis, que estima que la memoria pasará de representar alrededor del 8 % del gasto total de los hiperescalares en 2023 y 2024 a cerca del 30 % en 2026, con más presión aún en 2027. Es una estimación de esa firma, no una guía oficial de los hyperscalers, pero refleja bien el cambio de escala que vive el mercado.

Ese giro no se apoya en una sola variable. Por un lado, el capex en centros de datos sigue acelerándose al calor de la IA. BloombergNEF sitúa la inversión de los grandes operadores cerca de 750.000 millones de dólares en 2026, mientras Dell’Oro proyecta que el capex global del sector podría alcanzar 1,7 billones de dólares en 2030. Por otro, una parte creciente de ese gasto ya no se la lleva solo el silicio lógico, sino la memoria que necesitan aceleradores, servidores y racks completos para sostener cargas de entrenamiento e inferencia cada vez más exigentes.

La señal más clara de esa presión viene del propio mercado de memoria. TrendForce prevé que los precios de contrato de DRAM convencional suban entre un 58 % y un 63 % trimestral en el segundo trimestre de 2026, después de un primer trimestre ya muy tensionado, y explica esa escalada por la reasignación de capacidad hacia aplicaciones ligadas a IA y servidores, junto con una oferta que sigue siendo ajustada. La firma también anticipa que la escasez persistirá durante 2026 y probablemente más allá, porque la nueva capacidad productiva no llegará con volumen suficiente hasta finales de 2027 o 2028.

HBM, el cuello de botella más visible

Si hay un segmento donde esa inflación de memoria se ve con más claridad es en HBM. Micron confirmó en sus resultados del primer trimestre fiscal de 2026 que ya tenía cerrado precio y volumen para toda su oferta de HBM de calendario 2026, incluida HBM4. La propia compañía explicó que su incremento de capex hasta unos 20.000 millones de dólares se destinaría en gran parte a reforzar la capacidad de HBM y de nodos avanzados de DRAM, pero aun así admitió que no podía satisfacer toda la demanda de sus clientes.

SK hynix se mueve en la misma dirección. En su perspectiva oficial para 2026, la compañía describe el momento actual como una “AI memory supercycle” impulsada por HBM3E y, en la siguiente fase, por HBM4. No da cifras equivalentes a las de SemiAnalysis sobre el peso exacto en capex, pero sí refuerza la idea de un mercado donde la memoria ya no es un componente más del BOM, sino uno de los centros de gravedad del negocio.

Esto tiene una consecuencia directa para el coste de los servidores de IA. A medida que el peso de HBM sube dentro del sistema, también lo hace la sensibilidad del conjunto a cualquier incremento de precio o a cualquier restricción de oferta. SemiAnalysis sostiene que esa presión ya está empezando a trasladarse a las guías de capex de 2026 y que el repricing de 2027 todavía no estaría plenamente reflejado en las estimaciones de mercado. De nuevo, es una lectura de esa firma y no un consenso oficial de la industria, pero encuentra apoyo indirecto en el hecho de que fabricantes como Micron ya hayan vendido por adelantado buena parte de su capacidad HBM.

DRAM y LPDDR5: menos llamativas, pero igual de críticas

La narrativa pública se ha centrado sobre todo en HBM porque es la memoria más estrechamente asociada a aceleradores de IA de gama alta. Sin embargo, la presión también se extiende a la DRAM generalista y a variantes como LPDDR5. TrendForce explica que los fabricantes siguen priorizando productos de mayor margen ligados a servidor y empresa, lo que aprieta más el mercado convencional. Eso ayuda a entender por qué algunos analistas están empezando a hablar de una memoria que “se come” una parte creciente del presupuesto cloud, no solo en los sistemas más punteros, sino en la infraestructura general que acompaña a la expansión de la IA.

La estimación de SemiAnalysis sobre LPDDR5 —con precios de contrato más de triplicados desde el primer trimestre de 2025 y referencias al mercado abierto por encima de 10 dólares por GB en 2026— debe leerse como una proyección de esa casa de análisis, no como un dato oficial verificado por fabricantes. Aun así, encaja con una tendencia más amplia: la memoria de mayor rendimiento y menor consumo está ganando peso en arquitecturas donde la eficiencia y la densidad son cada vez más importantes.

Nvidia amortigua parte del golpe; el resto del mercado, no tanto

Uno de los matices más interesantes del argumento de SemiAnalysis es que no todos los compradores están igual de expuestos. La firma sostiene que NVIDIA disfruta de condiciones preferentes de suministro de DRAM que le permiten amortiguar mejor la inflación de memoria dentro del coste total de sus servidores, mientras que otros actores estarían más expuestos. No es una afirmación respaldada por contratos públicos ni por declaraciones oficiales de NVIDIA o de sus proveedores, así que conviene tratarla como una interpretación de mercado. Pero sí apunta a una realidad plausible: en un entorno de oferta limitada, el poder de compra y la prioridad comercial importan tanto como la demanda técnica.

Eso también puede explicar por qué la presión se nota de forma distinta según el actor. Un proveedor con escala masiva, contratos multianuales y prioridad de suministro puede absorber mejor un ciclo inflacionista que una empresa con menos volumen o con menor capacidad de cerrar acuerdos preferentes. En ese sentido, la inflación de memoria no solo encarece servidores: también puede redistribuir ventaja competitiva dentro del propio mercado de aceleradores y sistemas de IA. Esa conclusión es una inferencia razonable a partir del comportamiento del mercado y del cierre anticipado de capacidad HBM, aunque no aparezca formulada así en una única fuente oficial.

El verdadero mensaje del ciclo

La lectura de fondo es clara: la memoria está dejando de ser una línea secundaria del BOM para convertirse en una de las palancas centrales del coste y de la planificación de infraestructura. La IA no solo necesita más compute, sino también más ancho de banda, más capacidad y más cercanía entre procesador y memoria. Y cuando esa demanda se encuentra con una oferta rígida, con nodos avanzados difíciles de ampliar y con HBM vendida por adelantado, el resultado es un mercado que tensiona capex, márgenes y estrategias de compra al mismo tiempo.

Si esta tendencia se mantiene, 2026 y 2027 pueden acabar siendo recordados no solo como los años del gran despliegue de centros de datos para IA, sino también como los años en que la memoria pasó de acompañar al silicio a dictar una parte creciente de las reglas del juego.

Memory is taking over Hyperscaler CapEx.

— SemiAnalysis (@SemiAnalysis_) April 3, 2026

In CY23 and CY24, memory was ~8% of total Hyperscaler spend. We estimate it hits 30% in CY26 and moves higher in CY27. That's a near-4x shift in just four years. (1/4) 🧵 pic.twitter.com/fUxpwUYfcO

Preguntas frecuentes

¿Por qué se habla tanto de HBM en la infraestructura de IA?

Porque HBM ofrece un ancho de banda muy superior al de la DRAM convencional y es clave para alimentar aceleradores de IA de altas prestaciones. Micron ya ha confirmado que tenía comprometida toda su oferta HBM de calendario 2026, lo que ilustra hasta qué punto la demanda está tensionada.

¿Está realmente subiendo tanto la DRAM en 2026?

TrendForce prevé para el segundo trimestre de 2026 una subida de 58 % a 63 % en precios de contrato de DRAM convencional, después de un primer trimestre ya muy alcista. No equivale exactamente a decir que el precio anual se duplicará en todos los segmentos, pero sí confirma una presión muy fuerte en el mercado.

¿Es oficial que la memoria va a representar el 30 % del capex de los hiperescalares?

No es una cifra oficial de los hyperscalers. Es una estimación de SemiAnalysis, que la ha difundido públicamente como parte de su análisis del ciclo de memoria e IA.

¿La escasez de memoria afecta solo a HBM?

No. HBM es el caso más visible, pero TrendForce también ve un mercado muy tensionado en DRAM convencional y NAND por la reasignación de capacidad hacia aplicaciones de mayor margen ligadas a IA y servidores.