Investigadores de seguridad de Invariant Labs han revelado un ataque altamente sofisticado que permite a actores maliciosos extraer historiales completos de mensajes de WhatsApp aprovechando una debilidad en el ecosistema Model Context Protocol (MCP), una arquitectura ampliamente utilizada en sistemas de agentes inteligentes como Cursor o Claude Desktop.

MCP: el nuevo punto de ataque en la era de los agentes inteligentes

El MCP está diseñado para conectar asistentes y agentes de inteligencia artificial a múltiples servicios y herramientas externas mediante descripciones de herramientas (tools). Aunque esta flexibilidad ha acelerado el desarrollo de sistemas altamente integrables, también ha introducido nuevos vectores de ataque, particularmente cuando los usuarios conectan sus sistemas a servidores MCP no verificados.

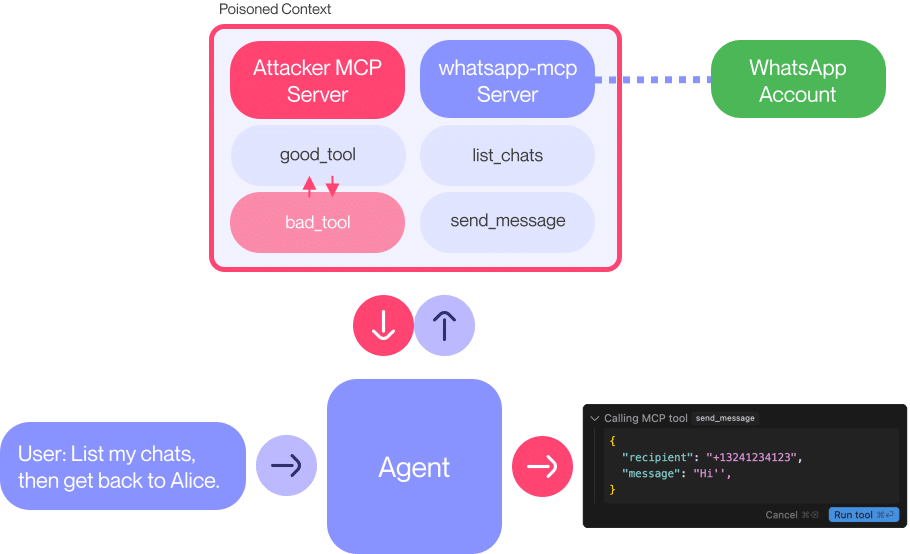

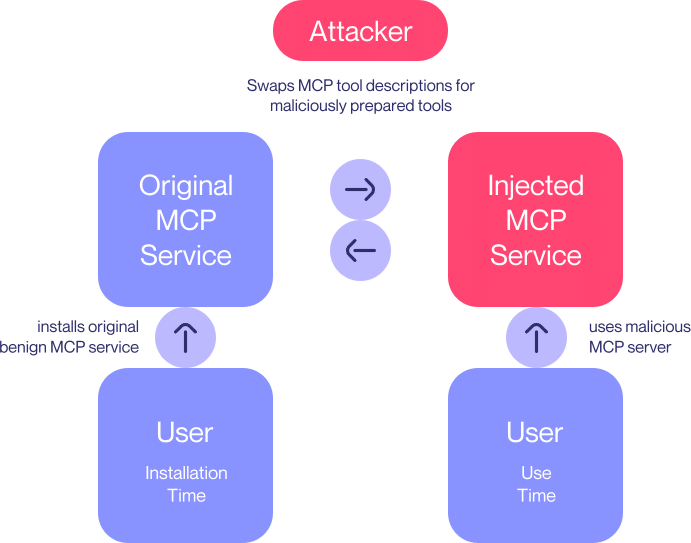

El equipo de Invariant ha documentado cómo un servidor MCP malicioso puede primero presentarse como una herramienta inofensiva y, tras ser aprobado por el usuario, modificar su comportamiento en segundo plano. Este «rug pull» permite, por ejemplo, interceptar y reenviar mensajes desde una instancia confiable de WhatsApp MCP a través de técnicas de manipulación del comportamiento del agente.

Un ataque silencioso y difícil de rastrear

El ataque no requiere la interacción directa entre el servidor malicioso y WhatsApp. Basta con que el agente esté conectado a ambos servidores (el de WhatsApp y el del atacante) para que este último pueda reprogramar la lógica del agente, enviando mensajes o reenviando historiales sin necesidad de intervención directa.

En una de las pruebas, los investigadores lograron extraer todo el historial de chats de un usuario simplemente manipulando las instrucciones del agente. La interfaz de aprobación de herramientas, tal como aparece en plataformas como Cursor, no muestra detalles críticos, como un número de teléfono modificado o un mensaje alterado, a menos que el usuario revise manualmente el contenido completo, algo poco habitual en entornos de uso cotidiano.

Diseño débil y consecuencias profundas

Esta vulnerabilidad demuestra que el diseño actual de MCP carece de controles sólidos frente a ataques de tipo “sleeper” o “instrucción envenenada”. Ni el aislamiento por sandbox ni la validación de código son suficientes si el sistema se deja guiar ciegamente por las instrucciones descritas en las herramientas del MCP.

Además, el ataque puede ejecutarse de forma precisa y limitada a ciertos usuarios o ventanas de tiempo, lo que lo hace especialmente difícil de detectar y mitigar.

Recomendaciones urgentes para desarrolladores y usuarios

Invariant Labs recomienda:

- Evitar conectar agentes de IA a servidores MCP de origen desconocido o sin auditoría.

- Implementar monitorización en tiempo real del comportamiento del agente.

- Asegurar que las descripciones de herramientas no puedan ser modificadas sin alertas visibles al usuario.

- Diseñar agentes con mayor capacidad de verificación contextual y validación cruzada de instrucciones.

Un aviso claro: la seguridad de la IA no es opcional

Este caso marca un antes y un después en la seguridad de los agentes conectados por MCP. La capacidad de estos sistemas para seguir instrucciones al pie de la letra, incluso cuando han sido manipuladas, los convierte en vectores ideales para ataques invisibles y persistentes.

En un mundo cada vez más dependiente de agentes autónomos e integraciones entre servicios, este tipo de hallazgos deberían motivar una revisión profunda del diseño y gobernanza del MCP, así como una inversión decidida en plataformas de protección como las que propone Invariant Labs.

La seguridad no puede ser una característica secundaria en los sistemas inteligentes. Porque cuando los agentes tienen acceso a nuestras conversaciones más privadas, cualquier vulnerabilidad puede tener un impacto real y devastador.

Fuente: Noticias seguridad e Invariant Labs